python 中文分词:结巴分词

2023-09-27 14:25:21 时间

中文分词是中文文本处理的一个基础性工作,结巴分词利用进行中文分词。其基本实现原理有三点:

- 基于Trie树结构实现高效的词图扫描,生成句子中汉字所有可能成词情况所构成的有向无环图(DAG)

- 采用了动态规划查找最大概率路径, 找出基于词频的最大切分组合

- 对于未登录词,采用了基于汉字成词能力的HMM模型,使用了Viterbi算法

安装(Linux环境)

下载工具包,解压后进入目录下,运行:python setup.py install

模式

- 默认模式,试图将句子最精确地切开,适合文本分析

- 全模式,把句子中所有的可以成词的词语都扫描出来,适合搜索引擎

接口

- 组件只提供jieba.cut 方法用于分词

- cut方法接受两个输入参数:

- 第一个参数为需要分词的字符串

- cut_all参数用来控制分词模式

- 待分词的字符串可以是gbk字符串、utf-8字符串或者unicode

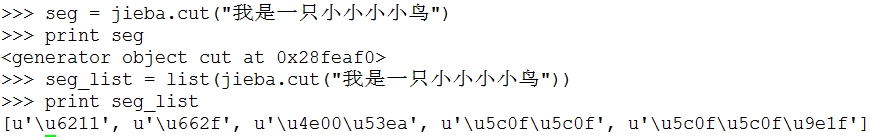

- jieba.cut返回的结构是一个可迭代的generator,可以使用for循环来获得分词后得到的每一个词语(unicode),也可以用list(jieba.cut(...))转化为list

实例

#! -*- coding:utf-8 -*- import jieba seg_list = jieba.cut("我来到北京清华大学", cut_all = True) print "Full Mode:", ' '.join(seg_list) seg_list = jieba.cut("我来到北京清华大学") print "Default Mode:", ' '.join(seg_list)

结果

实现原理

1. Trie树:参考http://www.cnblogs.com/kaituorensheng/p/3602155.html

相关文章

- Python unicode编码转中文

- Python 输出HTML实体字符(&#x***转html,html符号乱码,中文乱码)

- python中文注释

- 也谈 Python 的中文编码处理

- Python-OpenCV的函数imread()的图片名称参数是不能包含中文-汉字字符的

- Linux集群和自动化维3.2 选择Python的原因

- python -m json.tool中文乱码

- 基于Python 实现的车牌识别项目

- Python自动操作 GUI 神器——PyAutoGUI

- ubuntu 16.04下使用 python pip的安装问题。

- Python HTTP库requests中文页面乱码解决方案!

- 推荐Python、Django中文文档地址

- Python中文分词库——jieba

- Python教程之正则表达式实现拼音与中文提取并存储excel(教程含源码)

- Python 能力提升之这 9 个 Python 特性被严重低估了

- 自制基于HMM的python中文分词器

- python爬虫入门(四)利用多线程爬虫

- 4. python爬虫——数据解析技术使用教程和处理中文乱码的方法

- Python学习--- requests库中文编码问题

- python 中文转带音调的拼音

- 小学生python游戏编程arcade----可旋转的坦克的发射子弹

- python:连接Oracle数据库后控制台打印中文为??

- Kaggle竞赛入门(三):用Python处理过拟合和欠拟合,得到最佳模型

- (8)python代码规范,python软件目录规范

- 解决Python读取SQL Server中文乱码问题

- Python 愤怒的小鸟代码实现(1):物理引擎pymunk使用

- Python 模拟键盘 粘贴内容 解决无法粘贴中文汉字 淘宝快速增加分类信息