【大数据新手上路】“零基础”系列课程--日志服务(Log Service)采集 ECS 日志数据到 MaxCompute

随着公司业务的增多,云服务器 ECS 上的日志数据越来越多,存储开销越来越大,受限于日志的大小和格式,分析的速度非常缓慢,导致海量数据在沉睡,不知道发挥作用,如何能将这些数据进行归集、提炼和智能化的处理始终是一个困扰。通过日志服务投递日志数据到MaxCompute便可以让用户按照不同的场景和需求、以不同的方式复用数据,充分发挥日志数据的价值。

使用日志服务投递日志数据到MaxCompute具有如下优势:

使用非常简单。用户只需要完成2步配置即可以把日志服务Logstore的日志数据迁移到MaxCompute中。 避免重复收集工作。由于日志服务的日志收集过程已经完成不同机器上的日志集中化,无需重复在不同机器上收集一遍日志数据后再导入到MaxCompute。 充分复用日志服务内的日志分类管理工作。用户可让日志服务中不同类型的日志(存在不同Logstore中)、不同Project的日志自动投递到不同的MaxCompute表格,方便管理及分析MaxCompute内的日志数据。备注:大部分情况下日志数据在写入Logstore后的0.5~1个小时导入到MaxCompute,用户可以在控制台“投递任务管理”查看导入状态。导入成功后用户即可在MaxCompute内查看到相关日志数据。

下面介绍一个适用于中小企业用户,高效率低成本的日志采集存储方案:

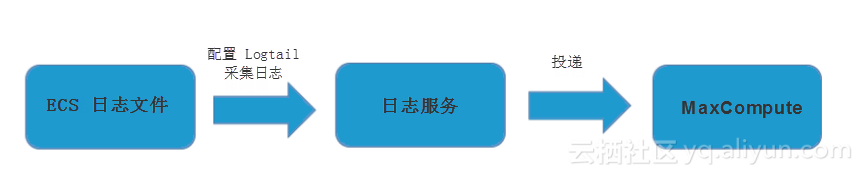

对于云服务器 ECS 上的日志,可以通过日志服务进行收集,然后投递至 MaxCompute 进行存储与分析,流程图如下:

ECS:云服务器 ECS 是一种简单高效、可以弹性伸缩的计算服务;

日志服务(Log Service):针对日志类数据的一站式服务,用户无需开发便可快速完成数据采集、消费、投递以及查询分析等功能;

MaxCompute:原名 ODPS,是由阿里云自主研发的一款服务,提供针对TB/PB级数据、实时性要求不高的分布式处理能力,它适用于海量数据的存储、计算,商业智能等领域。

实验目的和前期说明实验目的:

通过 Log Service 采集 ECS 日志并投递到 MaxCompute 上。

前期说明:

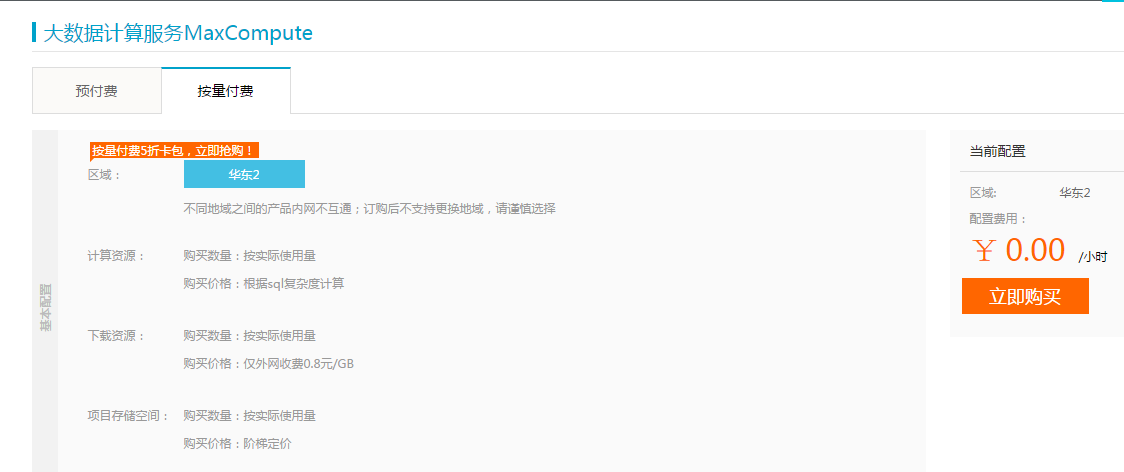

本实验在 Windows 环境下操作; (拥有 Linux 环境的用户在准备 ECS 日志数据时请参见:Linux 实例 进行操作) 用户拥有阿里云官网实名认证账号,并且创建好账号 Access Key ; 用户拥有一定的开发经验。 实验前的准备工作 开通MaxCompute阿里云实名认证账号访问 https://www.aliyun.com/product/odps ,开通 MaxCompute,选择按量付费进行购买 。

1 . 进入 云服务器 ECS 产品页,点击 立即购买;

2 . 根据自身需求对弹出框中的计费方式、地域、网络、实例、带宽、镜像、存储和购买量进行配置,更为详细的步骤说明请参见:创建 Windows 实例;

3 . 单击页面右侧下方的 立即购买,确认订单并付款 。

您可进入 云服务器管理控制台 单击实例 ID 或者 管理,进入 实例详情 页面查看实例的相关信息 。

连接 windows 实例并准备日志数据连接 Windows 实例

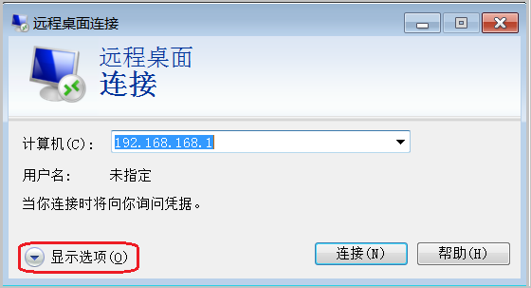

连接 Windows 实例的方式有三种:远程桌面连接、管理控制台连接和手机连接,本教程以远程桌面连接作为示例,具体操作如下:

注意:采用这种方式登录,请确保实例能访问公网 。如果在创建实例时没有购买带宽,则不能使用远程桌面连接 。如果您需要通过其他方式连接实例,请参见:连接 Windows 实例 进行操作 。

1 . 单击 开始 图标 远程桌面连接;

2 . 在 远程桌面连接 对话框中,输入实例的公网 IP 地址,单击 显示选项;

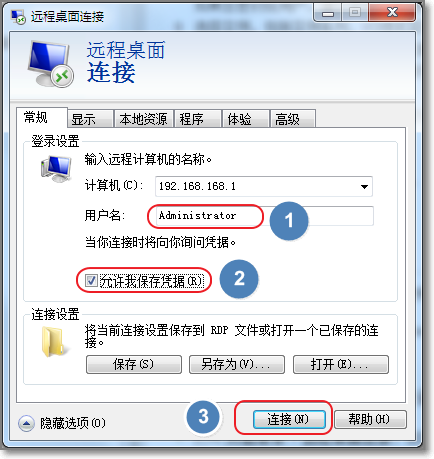

3 . 输入用户名,默认为 Administrator,如果您希望以后连接时不再手动输入密码,可以勾选 允许我保存凭据 。如果不需要再做其它设置,可以直接单击 连接按钮;

备注:如果您未设置或忘记实例的登录密码(不是管理终端的密码),请 重置密码 。

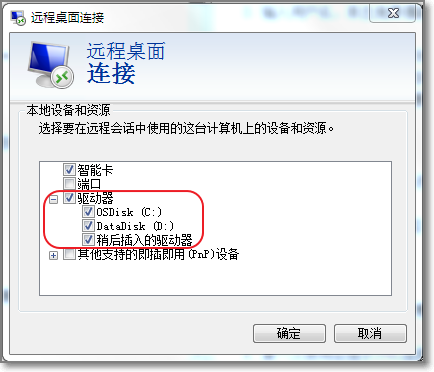

4 . 单击 本地资源 选项卡进行设置,选择 剪贴板 后,点击 详细信息,选择 驱动器,然后选择文件存放的盘符 。如下图所示:

备注:通过以上设置可以方便地将本地文件拷贝到实例中 。

准备离线日志文件

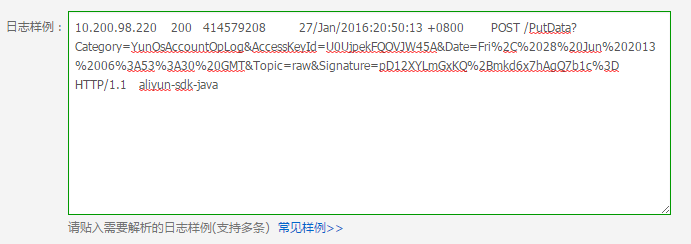

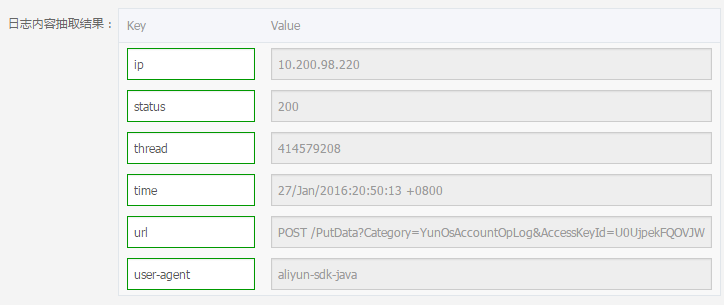

在 ECS 服务器中创建日志文件,举例一条数据如下:

ip:10.200.98.220 status:200 thread:414579208 time:27/Jan/2016:20:50:13 +0800 url:POST /PutData?Category=YunOsAccountOpLog AccessKeyId=U0UjpekFQOVJW45A Date=Fri%2C%2028%20Jun%202013%2006%3A53%3A30%20GMT Topic=raw Signature=pD12XYLmGxKQ%2Bmkd6x7hAgQ7b1c%3D HTTP/1.1 user-agent:aliyun-sdk-java

备注:

1 . 以上仅为数据示例,日志源数据见:logstore;

2 . 日志左侧的 ip、status、thread、time、url、user-agent 等是日志服务数据的字段名称,需在下方配置中用到。

开通日志服务使用注册成功的阿里云账号登录 日志服务产品页,单击 立即开通 。

准备密钥对

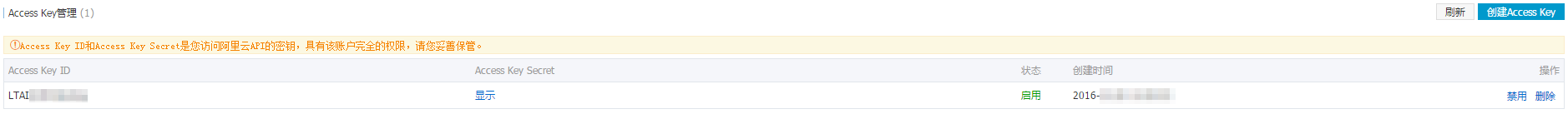

在 日志服务管理控制台,将鼠标移至页面右上角您的用户名上方,在显示的菜单中单击 accesskeys ,确认 Access Key 的状态为“启用”。如下图所示:

注意:Access Key 是 logtail 收集日志数据的必要条件,如果一旦没有启用,请参见: 创建密钥对 来进行创建 。

创建项目

注意:项目名称创建后不能修改 。

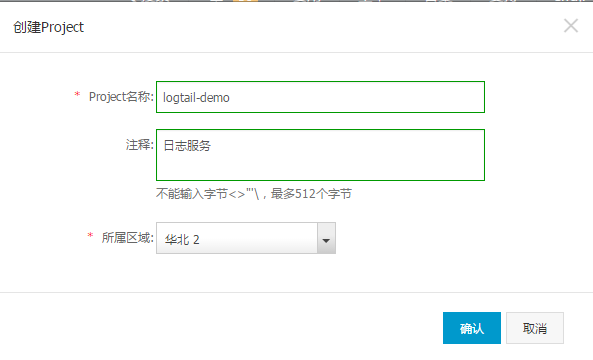

1 . 登录 日志服务管理控制台;

2 . 单击右上角的 创建 Project;

3 . 填写 Project 名称 和 所属地域,单击 确认 。

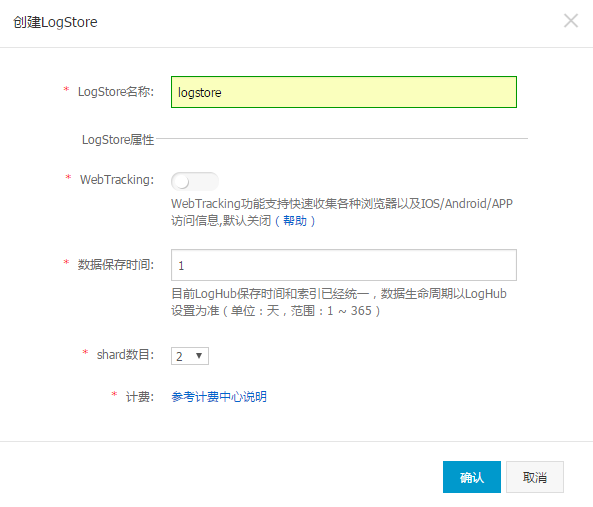

创建日志库

创建完项目后,系统会提示您创建日志库,单击 创建,配置如下图所示:

备注:您若想要了解日志库各项配置信息的详情,请参见:创建日志库。

安装 Logtail1 . 下载安装包

在云服务器 ECS 中下载 Logtail 安装包,下载地址:http://logtail-release.oss-cn-hangzhou.aliyuncs.com/win/logtail_installer.zip 。

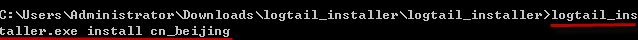

2 . 按机器网络环境和日志服务所在 Region 进行安装

解压缩 logtail.zip 到当前目录,以管理员身份运行 cmd 进入 logtail_installer 目录 ,输入安装命令 logtail_installer.exe install cn_beijing 进行安装,如下图所示:

备注:您需按照自己的机器网络环境和日志服务所在 Region 输入相应的安装命令 ,详情请参见:安装命令,此处以华北 2(北京)的 ECS 经典网络为例 。

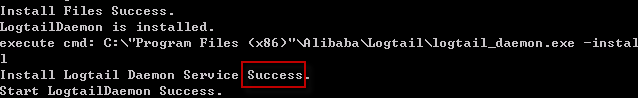

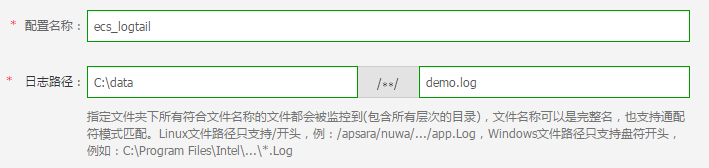

通过 Logtail 实时采集日志 创建 Logtail 配置创建完 logstore 后,系统会提示您创建 Logtail 配置收集日志数据,点击 创建 Logtail 配置;

选择数据源选择数据源,如下图所示:

注意:一个文件只能被一个配置收集 。

指定收集模式为分隔符模式

输入日志样例;

设置完成后,单击 下一步 。

应用到机器组勾选需要的机器组并单击 应用到机器组 。

如果您未创建机器组,需单击页面中的 创建机器组 进行创建,如图所示:

备注:云服务器的实例内网 IP 可到 云服务器 ECS 管理控制台 进行查看 。

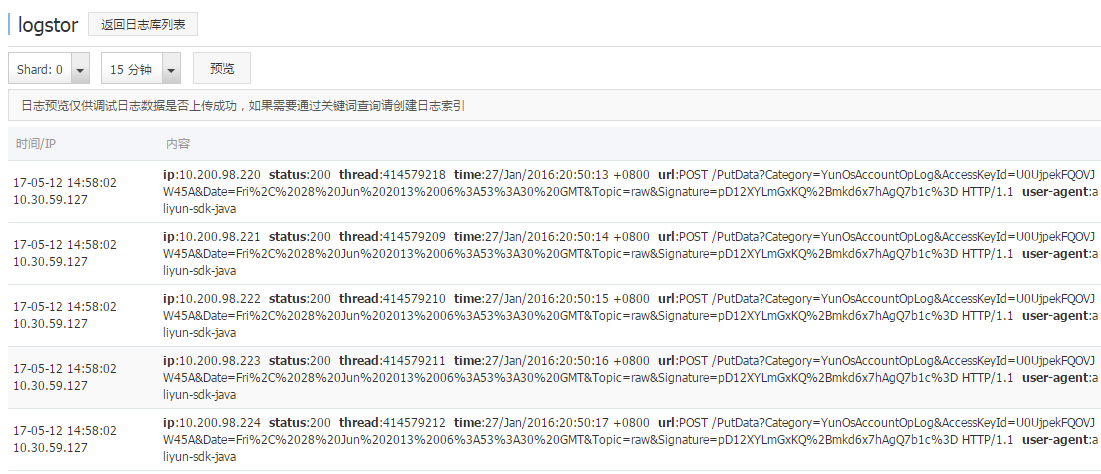

查看收集的日志完成上述配置后,日志服务即可收集日志 。您可在 LogStore 列表 页面,选择要查看的日志库并单击日志消费列下的 预览 进行查看,如下图所示:

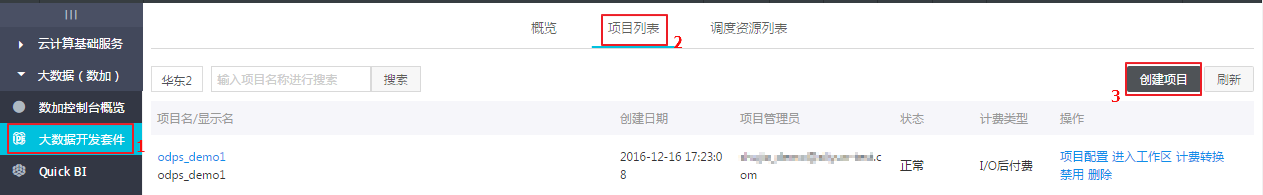

创建 MaxCompute 项目

1 . 导航至 产品- 大数据(数加)- MaxCompute 页面, 点击管理控制台;

2 . 创建项目 。进入控制台页面后导航至 大数据开发套件- 项目列表,点击 创建项目,如图所示:

在弹出框中选择 I/O 后付费的付费方式,输入项目名称:

创建完项目后,点击项目列表下对应项目操作栏中的 进入工作区,进入数据开发页面,如下图所示:

新建脚本文件 。点击上图中的“新建脚本”任务框,编辑建表语句,如下所示:

DROP TABLE IF EXISTS tmall; CREATE TABLE tmall ( log_source string, log_time bigint, log_topic string, time string, ip string, thread string, log_extract_others string PARTITIONED BY ( log_partition_time STRING , status string

点击运行,确认建表成功 。

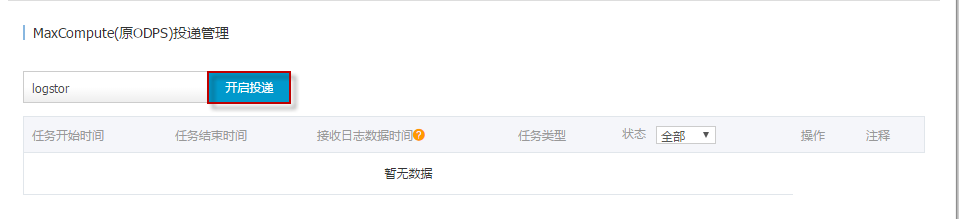

投递日志到 MaxCompute进入 LogStore 列表 页面,点击对应 LogStore 后的 ODPS,进入投递管理页面,点击 开启投递,如下图所示:

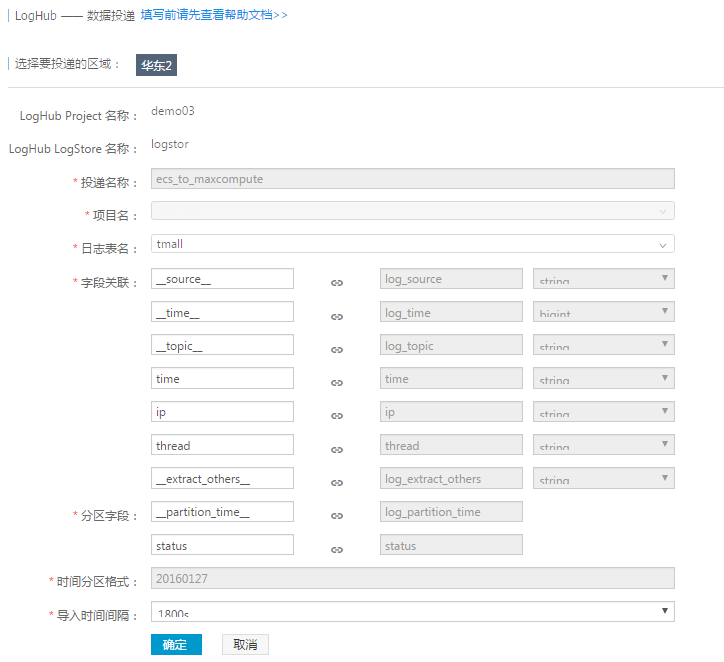

开启投递后跳转至 LogHub —— 数据投递 页面,在该页面需要配置投递大数据计算服务 MaxCompute(原 ODPS)的相关内容:

备注:__source__、__time__、__topic__、__extract_others__和__partition_time__是日志服务的系统保留字段,建议使用 。对于映射配置的限制详情请参见: 日志数据投递到 MaxCompute。

投递任务管理成功配置数据投递后点击 确定,可返回 MaxCompute (原 ODPS)投递管理 投递管理") 页面查看任务投递状态,如下图所示:

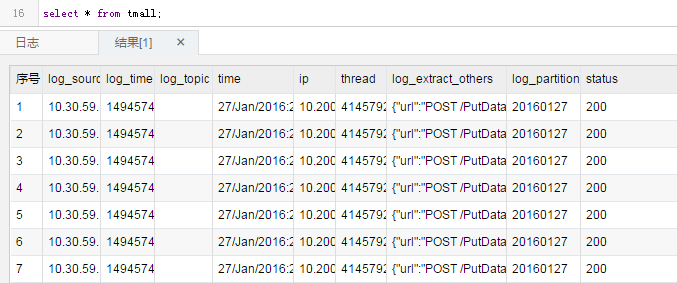

任务投递状态显示为 成功 后,可进入大数据开发套件管理控制台,查询 MaxCompute 表中是否有数据写入,如下图所示:

通过以上操作将云服务器 ECS 的日志成功投递到 MaxCompute 后,您还可以对日志数据进行分析与应用,详情请参见以下文章:

通过Alibaba Cloud Log Log4j Appender采集日志到阿里云日志服务 Log4j是Apache的一个开放源代码项目,通过使用Log4j,您可以控制日志信息输送的目的地是控制台、文件、GUI组件、甚至是套接口服务器、NT的事件记录器、UNIX Syslog守护进程等;您也可以控制每一条日志的输出格式;通过定义每一条日志信息的级别,您能够更加细致地控制日志的生成过程。

阿里云Kubernetes容器服务Istio实践之集成日志服务Log Service 阿里云Kubernetes容器服务已经提供了Istio与日志服务Log Service的集成能力,本文通过一个官方示例来重点介绍了Istio与基于阿里云日志服务的分布式追踪系统的整合能力。

日志服务(Log service)5月控制台更新指南 日志查询分析框全面增强 SLB日志分发支持国内Region,仪表盘优化 支持数据永久保存 图表属性相关开放国际站和日本站 可视化图形细节提升 部分已知bug修复 日志查询分析框全面增强 提升可视区域,支持换行编辑查询分析语句 关键字、操作符、函数高亮,查询分析语句更加易读 交互式编辑体验,关键字、200+内置函数以及字段索引自动提升,提升你的编辑体验 SLB日志分发支持国内Region,仪表盘优化 SLB日志分发功能目前已经支持所有的国内Region项目进行分发,优化了默认的字段索引以及仪表盘,欢迎试用。

日志服务(Log service)4月控制台更新指南 查询界面全新视图 支持查询页面以及仪表盘页面内嵌 支持OSS访问日志向导以及安骑士访问日志向导 时间选择器全面加强 部分细节优化和已知bug修复 一.查询界面全新视图 左侧标签页替换为资源树状结构,直接展示用户的日志库、快速查询和仪表盘列表。

MaxCompute(原ODPS)是一项面向分析的大数据计算服务,它以Serverless架构提供快速、全托管的在线数据仓库服务,消除传统数据平台在资源扩展性和弹性方面的限制,最小化用户运维投入,使您经济并高效的分析处理海量数据。

Python第四讲——使用IPython/Jupyter Notebook与日志服务玩转超大规模数据分析与可视化 立即下载

相关文章

- NET LOG日志的使用以及设置文件大小和数量限制

- Tomcat 中 catalina.out、catalina.log、localhost.log 和 access_log 的区别

- PostgreSQL SQL log duration time 源码分析

- ORACLE清理、截断监听日志文件(listener.log)

- adb查看手机app的log日志

- Maintaining Online Redo Log Files

- ERROR: Error in Log_event::read_log_event()

- mySQL Slow Query Log Rotation(慢查询日志轮循设置)

- matlab中log函数与rssi转距离

- Python 图像处理 OpenCV (13): Scharr 算子和 LOG 算子边缘检测技术

- log_output参数是指定日志的存储方式

- 日志输出:控制台和log文件输出日志

- [Javascript] Advanced Console Log Arguments

- Thread 1 cannot allocate new log 的处理办法

- Nginx日志过滤 使用ngx_log_if不记录特定日志

- 用代码读取指定SAP CRM One Order文档产生的application log-应用日志

- 日志服务接入方式之log producer library

- Atitit 得到mybatis 实际 sql 1.1. 使用mybatis工具提供的,只能出现问号一大堆不行1 1.2. 配置log 打印sql依然不行,里面有问号。。4 1.3. 配置p

- 如何将 winston log 库记录的日志写入 mongo DB 数据库

- 已解决Message: invalid argument: log type ‘performance‘ not found

- Linux kernel源码中关闭内核log

- MySQL 日志系统之 redo log 和 binlog(转)

- 【数据库管理】⑤归档日志Archive Log

- 【数据库管理】④重做日志Redo Log