【Transformer】14、Are Transformers More Robust Than CNNs?

14 are transformer more than Transformers

2023-09-14 09:13:56 时间

出处:NIPS 2021

一、背景

CNN 被广泛用于计算机视觉任务中,其成功的主要原因在于 “卷积” 这一操作,“卷积” 能够引入一定的归纳偏置,如平移不变性等。

最近,未使用卷积的 vision transformer 结构在计算机视觉领域也取得了很大的成功,ViT 主要使用自注意力机制,来实现特征提取。

二、动机

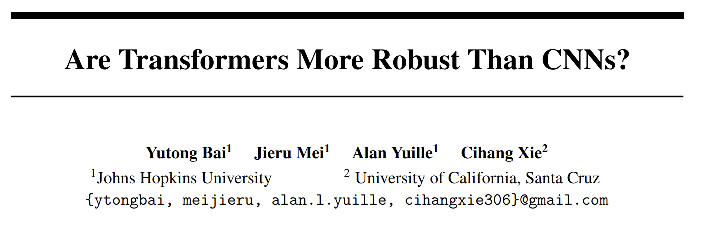

有一些学者提出,Transformer 比 CNN 更加鲁棒,但作者认为他们的结论仅仅来源于现有的实验,两者并没有被放到相同的体量下来对比。比如使用 ResNet 50(约25M 参数)和 ViT-B(约86M参数)进行对比,而且训练数据集、epoch数、数据增强方法都有不同。所以作者认为谁更鲁棒的问题仍然是一个开放的问题。

所以,作者在本文中对 Transformer 和 CNN 进行了一次公平的对比

DeiT-S (22M, 76.8% top1 acc) VS. ResNet 50 (25M, 76.9% top1 acc)

三、方法

作者主要从两方面进行性能对比:

-

对抗鲁棒性

它们是通过向图像添加人类察觉不到的扰动或小、大小的 patch 来制作的,这会导致深度学习网络产生错误的预测,

-

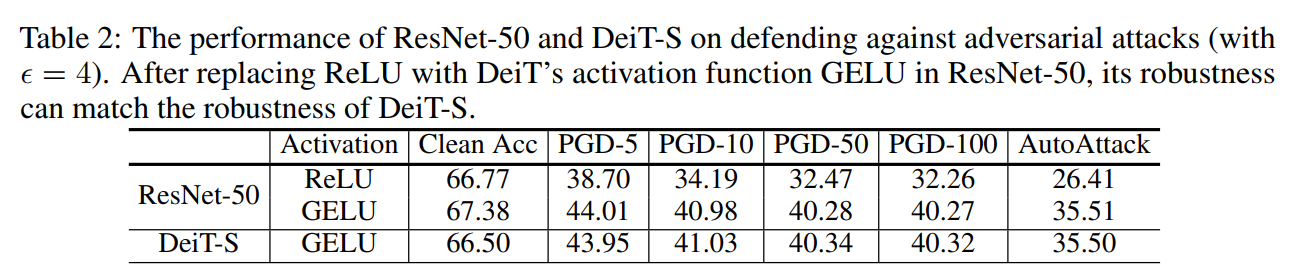

分布外样本的鲁棒性

对网络使用和训练数据不同分布的测试数据进行测试

四、结论

Transformer 在 对抗鲁棒性上没有 CNN 表现好

Transformer 模型能够更好的对训练数据分布外的数据进行预测

相关文章

- 14-spring学习-变量操作

- thinkphp6: 使用前后端分离的验证码(thinkphp 6.0.9/php 8.0.14/vue 3.2.26)

- 12其他控件-14蚂蚁线-antline

- 今年是SAP进入中国25周年,我从2007年毕业进入SAP成都研究院,也马上就待满14年了。

- Angular 14 inject 函数使用过程中的一些注意事项

- 成功解决xgboost.core.XGBoostError: b‘[14:48:08] 0 feature is supplied. Are you using raw Booster inter

- 成功解决xgboost.core.XGBoostError: b‘[14:48:08] 0 feature is supplied. Are you using raw Booster inter

- 数学建模学习(14):最全非线性规划模型详细讲解

- 剑指 Offer 14- I. 剪绳子-力扣双百代码

- 14- I. 剪绳子☆☆☆(动态规划)

- C经典之14-双向链表存储1-10---ShinePans

- 谷歌技术面试要点(Google面试)(14年5月20日交大专场)

- 年度总结(14)

- AI学习之路(14): 张量的平方计算

- RFSoC应用笔记 - RF数据转换器 -14- RFSoC自动增益控制与NCO跳频功能

- 【C++】算法集锦(14):贪心算法