算法工程师面试之归一化操作

前言

- 文章来源:CSDN@LawsonAbs

- 本文参考《NNDL》

- 其实更应该考虑:在什么时候使用这个归一化操作,比如我们要融入外部知识到当前向量后,是直接做加和操作,还是执行什么操作?

1. 归一化是什么?

2. 为什么要归一化?

可以从如下两个方向来说明:

- 梯度更新

- 参数选择

3. 主流的归一化方法

3.1 线性函数归一化

比较简单,相当于使用一个映射函数:

x

=

x

−

x

m

i

n

x

m

a

x

−

x

m

i

n

x = \frac{x-x_{min}}{x_{max}-x_{min}}

x=xmax−xminx−xmin

3.2 零均值归一化

得到样本的均值

μ

\mu

μ,方差

σ

2

\sigma^2

σ2,然后更新表示:

x

=

x

−

μ

σ

x = \frac{x-\mu}{\sigma}

x=σx−μ

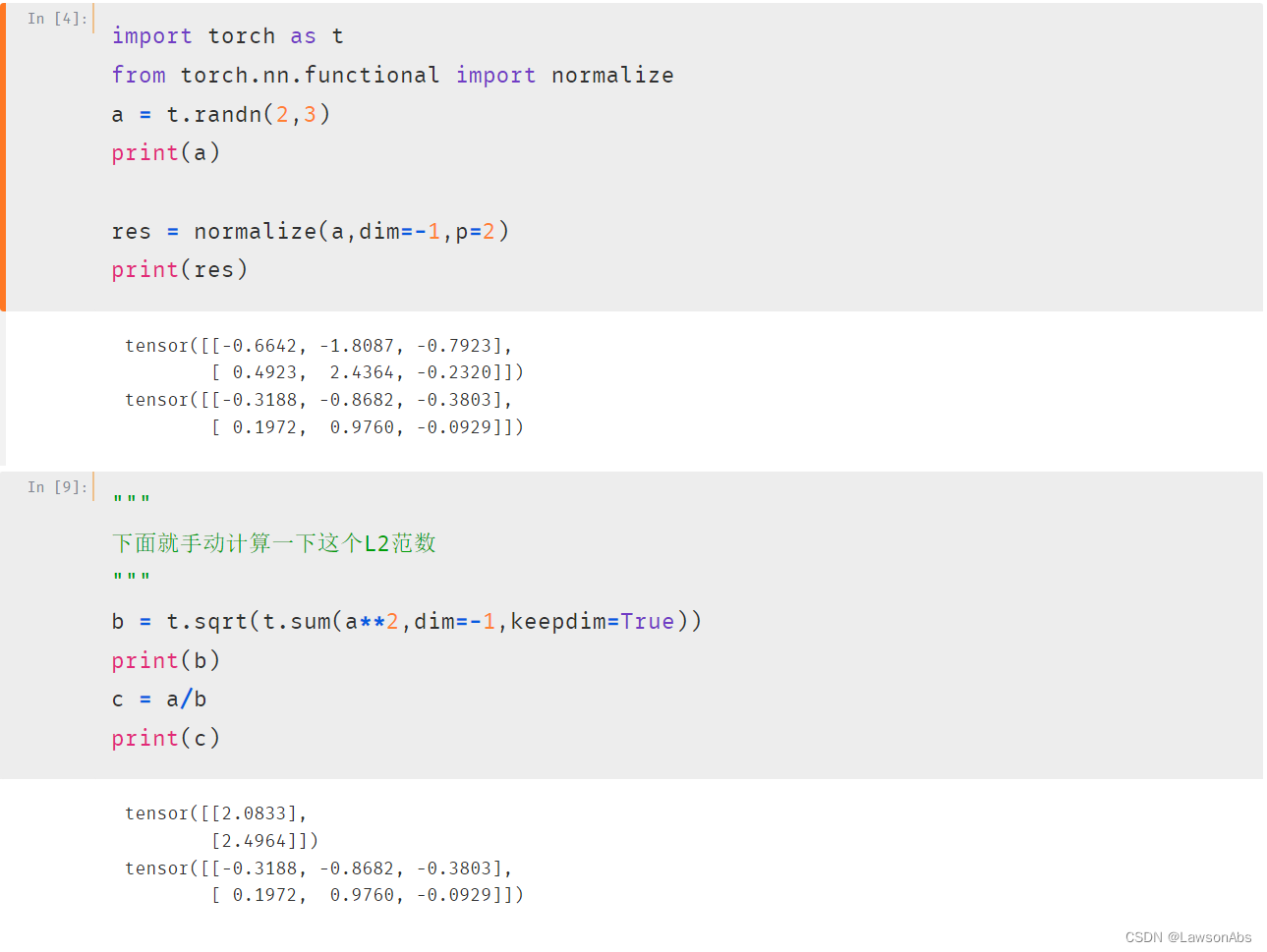

torch.nn.functional.normalize()

这个直接就是根据范数来归一化。具体示例如下:

3.4 batch normalization

批量归一化:指的是将一个batch中的数据按照各个特征维度进行归一化。【从特征维度出发】

缺点:一个batch中的样本数要足够,否则就很能体现出有时候。

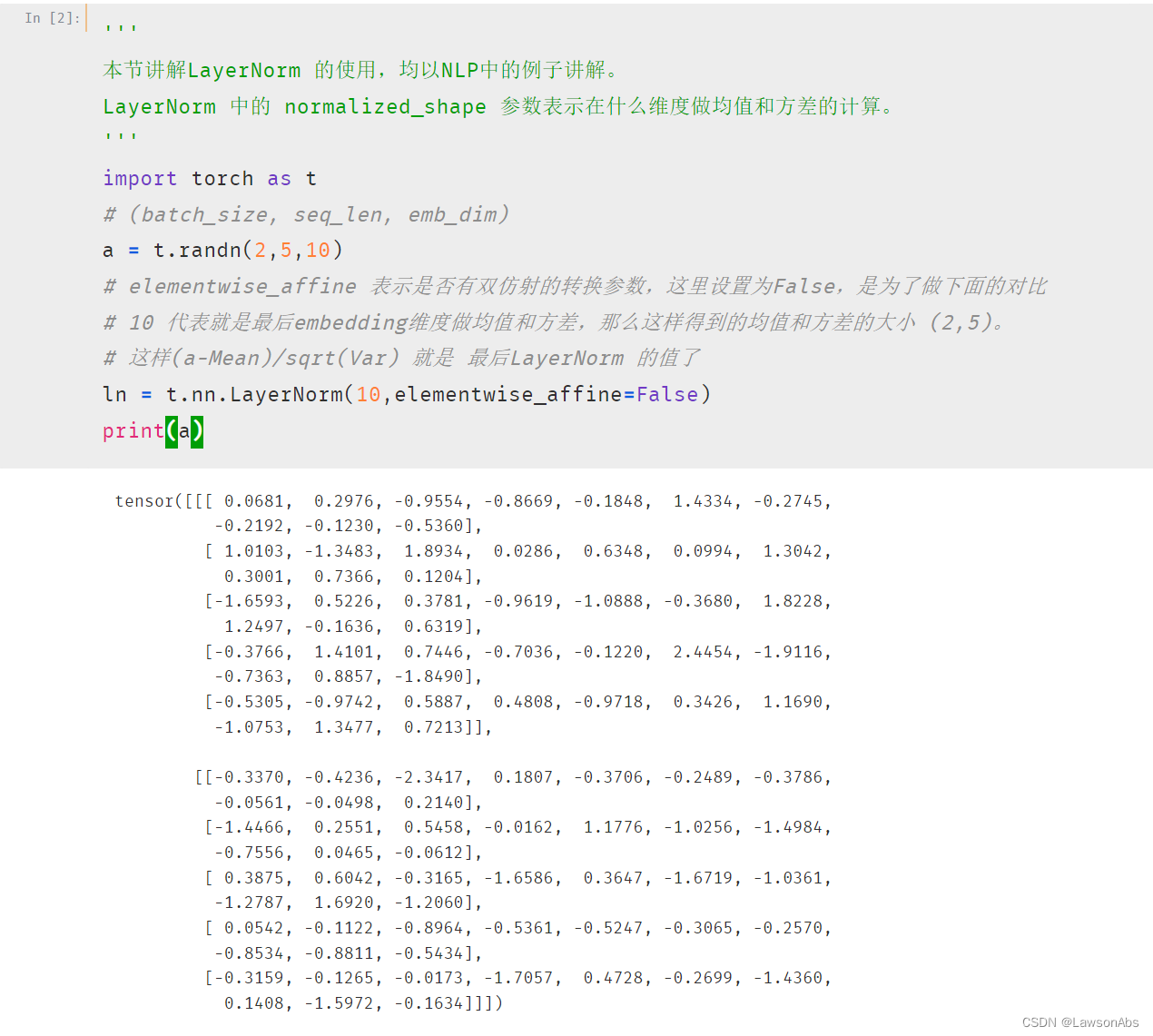

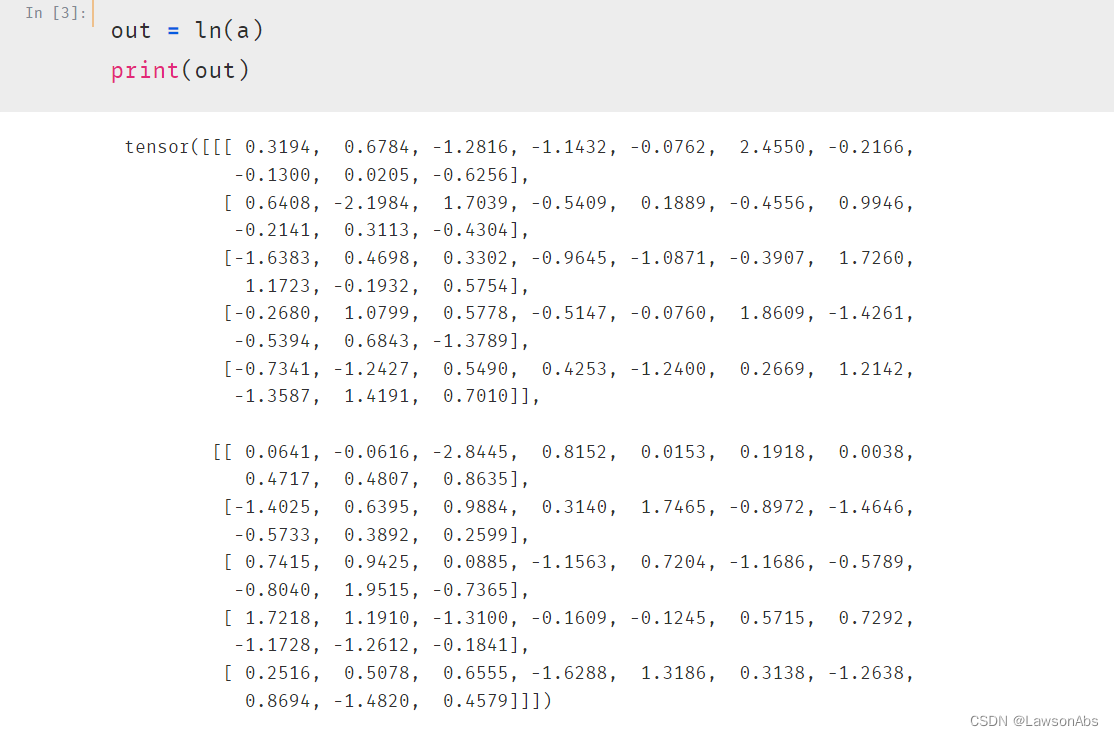

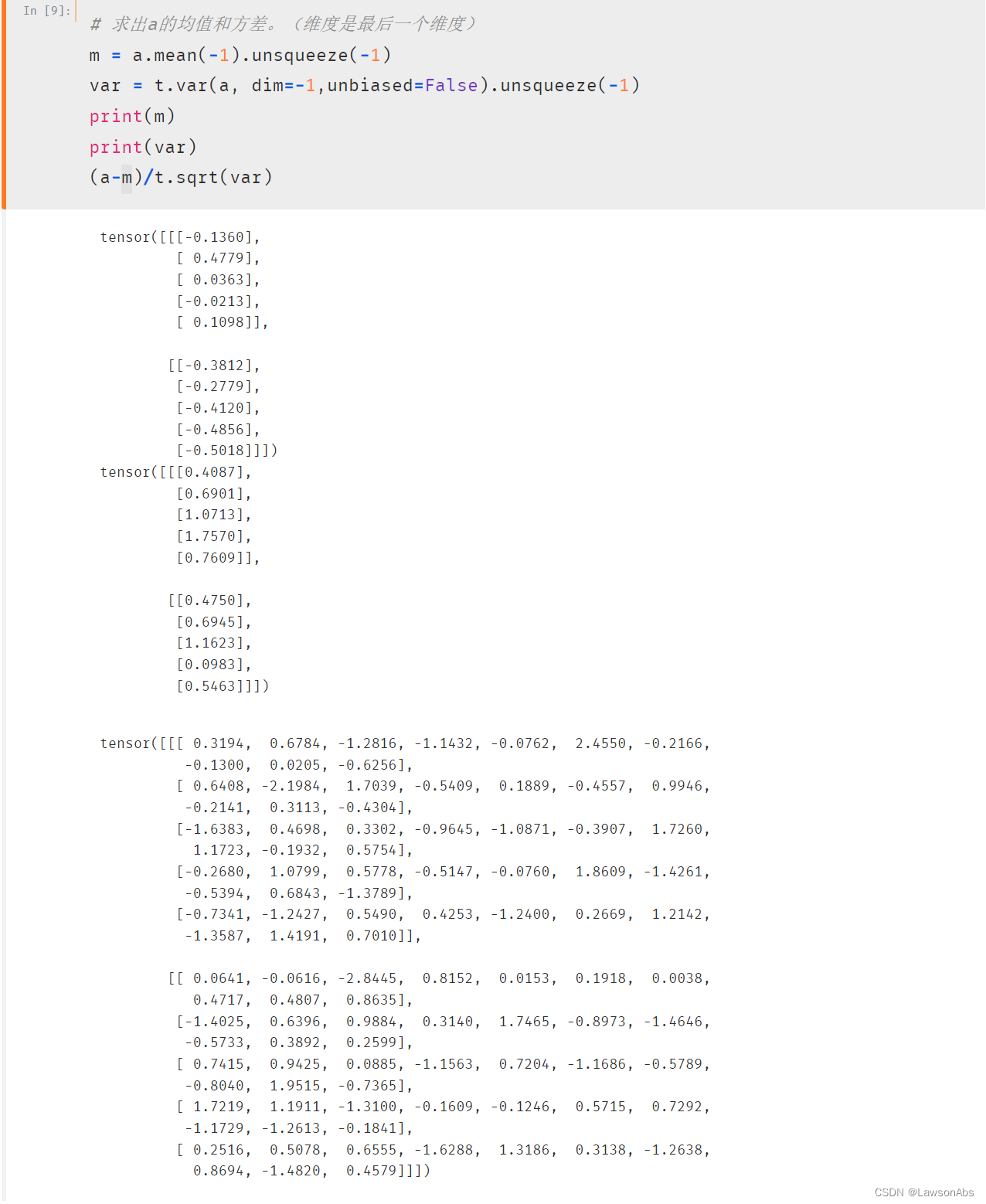

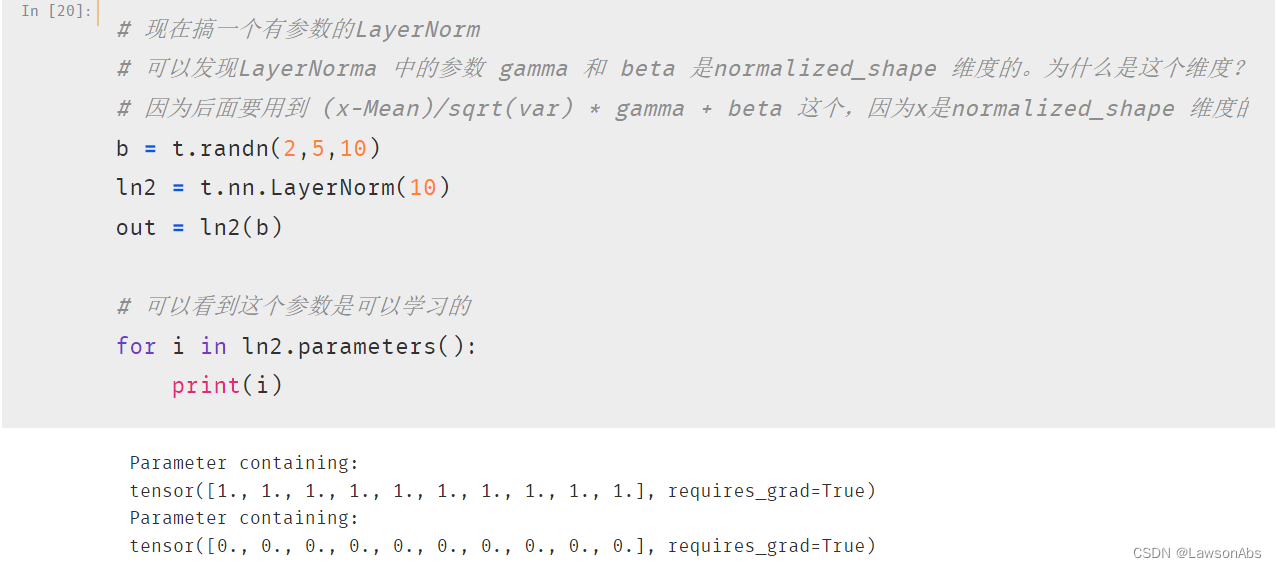

3.5 layer normalization

层归一化:指的是将同条样本的各个特征数据求均值,然后除以标准差。【从样本维度出发】

具体示例如下:

相关文章

- 全栈数据工程师养成攻略:Python 基本语法

- 算法工程师<数学题/智力题>

- 来自Google资深工程师的API设计最佳实践

- DayDayUp:计算机技术与软件专业技术资格证书之《系统集成项目管理工程师》课程讲解之项目管理知识最全架构图、计算题四大题型、案例分析常考题型分析与经验技巧总结

- Interview之AI:深度学习算法工程师面试之常见专业知识考点(参数初始化策略(Lecun、Xavier/Glorot、Kaiming、基于BN的随机的参数初始化)、图像算法基础(ROI)

- DayDayUp之Job:牛客网—算法工程师—剑指offer之66道在线编程(解决思路及其代码)——1~20

- Interview:人工智能岗位—校招真题—算法工程师(计算机视觉方向)选择题——C++语言、sql语言编程相关习题的部分笔记

- 全干工程师神器 - Jmeter 02 - Jmeter关于录制与简单实战

- 用我的亲身经历告诉你创业公司应该招什么样的算法工程师

- ChatGPT上线了!我在2023年1月2日这一天用上了它!百问百答!我只能说(真NB)算法工程师可以不用百度/Google了!

- Java开发工程师高质量代码必备:枚举类

- 【软件测试技术谈】月薪10K、15K、20K的软件测试工程师分别需要掌握哪些技术?

- 软件测试工程师,如何工资过万?(经验之谈)

- 【数据挖掘】2022年2023届秋招知能科技公司机器学习算法工程师 笔试题

- 算法工程师面试之Batch Normalization和 Layer Normalization

- 算法工程师面试之朴素贝叶斯

- 算法工程师面试之集束算法(beam search)

- 算法工程师面试之BPE算法

- 算法工程师面试之fastText算法