迁移学习《Cluster-Guided Semi-Supervised Domain Adaptation for Imbalanced Medical Image Classification》

论文信息

论文标题:Cluster-Guided Semi-Supervised Domain Adaptation for Imbalanced Medical Image Classification

论文作者:S. Harada, Ryoma Bise, Kengo Araki

论文来源:ArXiv 2 March 2023

论文地址:download

论文代码:download

视屏讲解:click

1 摘要

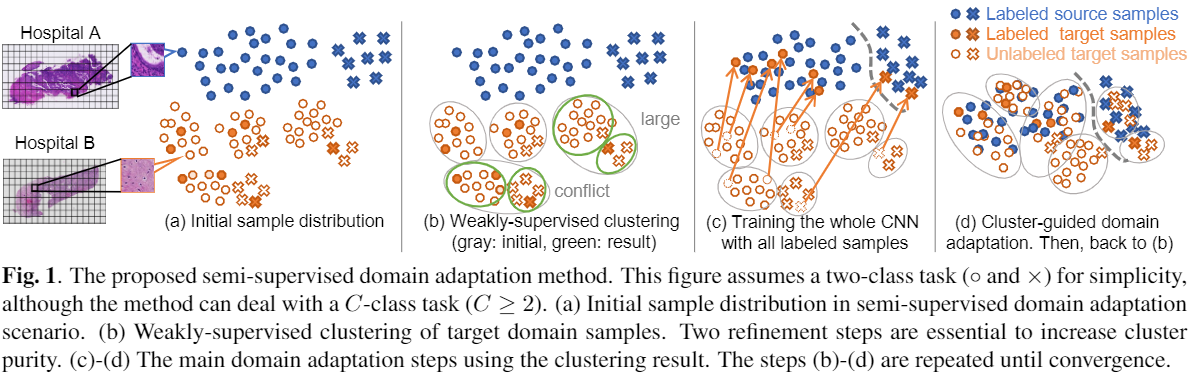

一种半监督域自适应方法,对医学图像分类任务中常见的类不平衡情况具有鲁棒性。 为了稳健性,提出了一种弱监督聚类流水线来获得高纯度聚类,并在表示学习中利用这些聚类进行域适应。

2 方法

2.1 问题定义

Consider that we have a set of $m^{s}$ labeled source samples, $\mathcal{D}^{s}=\left\{\left(x_{i}^{s}, y_{i}^{s}\right)\right\}_{i=1}^{m^{s}}$ , where $x_{i}^{s}$ is the $i$-th image sample in the source domain and $y_{i}^{s} \in\{1, \ldots, C\}$ is its class label. In the target domain, we have a set of $m^{t}$ labeled samples, $\mathcal{D}^{t}=\left\{\left(x_{i}^{t}, y_{i}^{t}\right)\right\}_{i=1}^{m^{t}}$ , and a set of $m^{u}$ unlabeled target samples, $\mathcal{D}^{u}=\left\{x_{i}^{u}\right\}_{i=1}^{m^{m}}$ . Then we consider the problem of improving the classification performance using not only $\mathcal{D}^{s}$ but also $\left\{\mathcal{D}^{t}, \mathcal{D}^{u}\right\}$ , after adapting $\left\{\mathcal{D}^{t}, \mathcal{D}^{u}\right\}$ to $\mathcal{D}^{s}$ . Since we have the labeled samples $\mathcal{D}^{t}$ in the target domain, this problem is called semi-supervised domain adaptation.

2.2 模型概念图

2.3 方法简介

2.3.1 弱监督聚类

通过软约束聚类优化聚类

第一个聚类优化步骤旨在将每个冲突的聚类(即具有来自不同类别标签的样本的聚类)划分为几个不冲突的聚类。约束聚类引入了两种类型的约束,称为 必须链接 和 不能链接。 必须链接 给应该分组到同一个集群的样本,而不能链接给不应该在同一分组的样本。

本文使用 k-means 初始化聚类,如果同一簇存在不同带标签的样本则不能将 链接附加到它们,反之可以。链接附加后,再次执行聚类,同时满足链接的约束。 应用此步骤后,集群中标记的目标样本始终属于一个类。

通过基于比例的分裂进行聚类细化

第二个聚类细化步骤旨在根据类比例 $\left(p_{1}, \ldots, p_{C}\right)$ 将聚类拆分为更小的聚类,即通过带标签目标样本的比例计算整体的比例。

$\bar{c}_{i}$ 表示第 $i$ 个簇中标记样本的类别,$u_{i}$ 是第 $i$ 个簇中未标记样本的数量。 如果 $m^{u} p_{\bar{c}_{i}} \leq u_{i}$ ,认为集群对于类 $\bar{c}_{i}$ 来说太大了,因此通过 k-means (k = 2) 将其分成两个较小的集群。 因此,即使是小类,也可以期待高纯度的簇。

2.3.2 集群引导域适应

使用上述谨慎步骤给出的聚类结果,我们现在执行聚类引导的域自适应,如 Figs.(c) 和 Figs.(d) 所示。 CNN 模型 $f$ 针对两个目标进行训练。 一种是通过交叉熵损失对所有标记样本 $\mathcal{D}^{s} \cup \mathcal{D}^{t}$ 进行分类,使源样本和标记目标样本靠得更近,如 $Fig. \mathrm{c}$ 所示。 另一种是引导未标记样本 $x_{j}^{u}$ 重新训练后更接近属于同一簇的标记样本 $\boldsymbol{x}_{i}^{t}$(即 $\boldsymbol{x}_{i}^{t}$ 比属于 a 的 $x_{l}^{u}$ 更接近属于同一簇的 $\boldsymbol{x}_{j}^{u}$ 不同的集群)。 更具体地说,我们通过以下目标训练模型:

$\begin{array}{l}\mathcal{L}_{\mathrm{clu}}\left(\boldsymbol{x}_{i}^{t}, \boldsymbol{x}_{j}^{u}, \boldsymbol{x}_{l}^{u}\right)= \max \left\{\left\|\boldsymbol{f}\left(\boldsymbol{x}_{i}^{t}\right)-\boldsymbol{f}\left(\boldsymbol{x}_{j}^{u}\right)\right\|_{2}^{2}-\left\|\boldsymbol{f}\left(\boldsymbol{x}_{i}^{t}\right)-\boldsymbol{f}\left(\boldsymbol{x}_{l}^{u}\right)\right\|_{2}^{2}+\varepsilon, 0\right\}\end{array}$

其中 $f(x)$ 表示样本 $x$ 的特征向量,$\varepsilon \in \Re^{+}$ 是边距。 如 $Fig.1(d)$ 所示,通过使用这种损失训练 $f$ 以及标记样本 $x_{i}^{t}$ 的引导,将未标记样本逐渐映射到源域的相应类。 请注意,在此框架中,我们没有为未标记样本提供任何伪标签——未标记样本被用作未标记样本,以帮助使用 $Eq. (1)$ 中标记样本进行表示学习。

3 实验

可视化

4 总结

略

相关文章

- 将同构迁移学习应用于脑机接口,解决训练数据不足的问题

- Flask 学习-15.flask-migrate数据迁移

- 【硬核书】迁移学习多智能体强化学习系统

- 将django迁移到腾讯云函数计算

- NeurIPS2022 | UNC 提出高效迁移学习法「LST」,GPU内存可节约69%(含源码)

- 谷歌MIRec:头部尾部双赢的迁移学习框架

- 积木式深度学习的正确玩法!新加坡国立大学发布全新迁移学习范式DeRy,把知识迁移玩成活字印刷|NeurIPS 2022

- NIPS'22「牛津+剑桥」利用迁移学习在异构空间中估计干预效果

- Oracle分区表迁移:实现精准的性能优化(oracle分区表迁移)

- 至12cOracle 11g迁移至12c的挑战与步骤(oracle11g迁移)

- 之间的数据迁移使用Oracle实现两个库之间的数据迁移(oracle两个库)

- 深度学习实践:如何使用Tensorflow实现快速风格迁移?

- 如何进行 MySQL 数据库迁移到 MSSQL 的操作指南(mysql迁移mssql)

- SQL Server中表的迁移:精确性与可维护性(sqlserver迁移表)

- 如何实现SQL Server数据库的迁移(sqlserver据迁移)

- Linux端口转发:UDP无缝迁移(linux端口映射udp)

- 大数据环境下Redis实现海量数据迁移(数据库海量数据迁移redis)

- 导入另一个表Oracle从一个表导入另一个表快速有效的数据迁移方式(oracle从一个表数据)

- 大规模数据迁移Redis 的智能方案(redis 转移)

- 为什么吴恩达认为未来属于迁移学习?

- 一句命令完成MySQL的数据迁移(轻量级数据)