Openstack入门篇(十二)之neutron服务(计算节点)的部署与测试

2023-09-27 14:29:14 时间

-

1.Neutron组件安装

[root@linux-node2 ~]# yum install -y openstack-neutron-linuxbridge ebtables ipset

-

2.配置通用组件

编辑/etc/neutron/neutron.conf 文件并完成如下操作: [root@linux-node2 ~]# vim /etc/neutron/neutron.conf 在[DEFAULT]部分,配置RabbitMQ消息队列访问权限: [DEFAULT] ... transport_url = rabbit://openstack:openstack@192.168.56.11 在 “[DEFAULT]” 和 “[keystone_authtoken]” 部分,配置认证服务访问: [DEFAULT] ... auth_strategy = keystone [keystone_authtoken] ... auth_uri = http://192.168.56.11:5000 auth_url = http://192.168.56.11:35357 memcached_servers = 192.168.56.11:11211 auth_type = password project_domain_name = default user_domain_name = default project_name = service username = neutron password = neutron 在 [oslo_concurrency] 部分,配置锁路径: [oslo_concurrency] ... lock_path = /var/lib/neutron/tmp 查看所有配置项: [root@linux-node2 ~]# grep "^[a-z]" /etc/neutron/neutron.conf auth_strategy = keystone transport_url = rabbit://openstack:openstack@192.168.56.11 auth_uri = http://192.168.56.11:5000 auth_url = http://192.168.56.11:35357 memcached_servers = 192.168.56.11:11211 auth_type = password project_domain_name = default user_domain_name = default project_name = service username = neutron password = neutron lock_path = /var/lib/neutron/tmp

-

3.配置linuxbridge代理

控制节点的/etc/neutron/plugins/ml2/linuxbridge_agent.ini配置文件和计算节点是一样的,可以使用scp拷贝过去

[root@linux-node1 ~]# scp /etc/neutron/plugins/ml2/linuxbridge_agent.ini root@192.168.56.12:/etc/neutron/plugins/ml2/

-

4.配置计算服务来使用网络服务

编辑/etc/nova/nova.conf文件并完成下面的操作: 在[neutron] 部分,配置访问参数: [neutron] ... url = http://192.168.56.11:9696 auth_url = http://192.168.56.11:35357 auth_type = password project_domain_name = default user_domain_name = default region_name = RegionOne project_name = service username = neutron password = neutron

-

5.完成安装

重启计算服务: [root@linux-node2 ~]# systemctl restart openstack-nova-compute.service 启动Linuxbridge代理并配置它开机自启动: [root@linux-node2 ~]# systemctl enable neutron-linuxbridge-agent.service [root@linux-node2 ~]# systemctl start neutron-linuxbridge-agent.service

-

6.在node1上查看是否成功启用

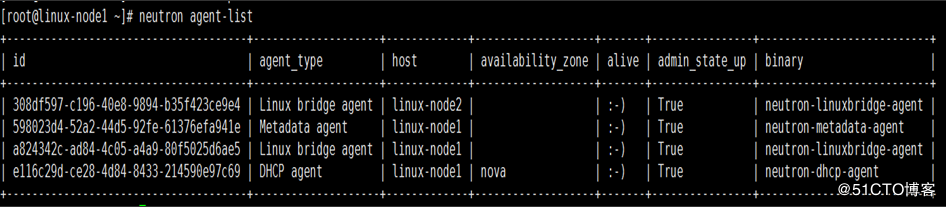

[root@linux-node1 ~]# neutron agent-list

[root@linux-node1 ~]# nova service-list

这两个出来的结果正常,才可以正常创建虚拟机

-

7.底层网络变化

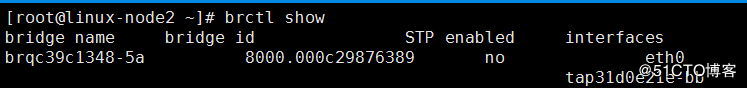

使用brctl show查看

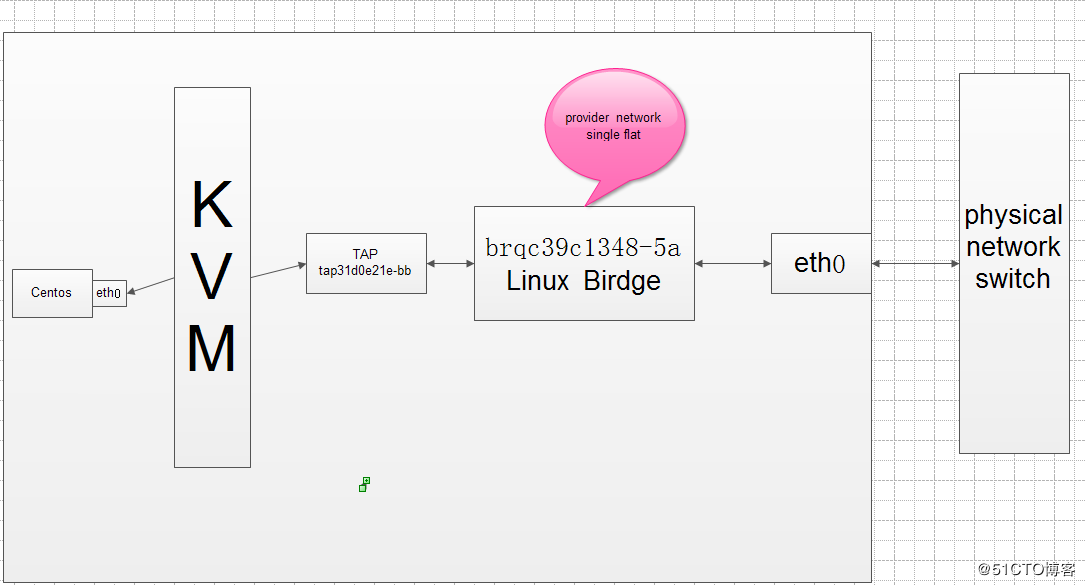

此时node2上的虚拟机网络结构如下:

linux-node2作为计算节点,对应的tap设备为:tap31d0e21e-bb,并且连接到bridge

相关文章

- Spark的Driver节点和Executor节点

- java 删除链表的倒数第n个节点

- vue中diff算法处理新旧节点的流程

- html:通过getElementById(id)方法访问节点实现下拉列表的选择

- C#操作XML,如何获取指定节点值?

- CentOS7 下 Hadoop 单节点(伪分布式)部署

- 【云原生】CKA 第⼆题:设置节点不可⽤

- leetcode1721. 交换链表中的节点

- 小程序vant组件,未找到 van-dialog 节点,请确认 selector 及 context 是否正确

- ES集群状态、节点、索引等查看及根据字段、排序查询

- 如何诊断 11.2 集群节点驱逐问题 (文档 ID 1674872.1)

- 嵌入式操作系统内核原理和开发(基于链表节点的内存分配算法)

- 大数据成长之路-- hadoop集群的部署(3)HDFS新增节点

- ElasticSearch 单个节点监控

- 惭入佳境之布置双节点DATANODE及错误解决

- Openstack入门篇(十一)之neutron服务(控制节点)的部署与测试

- Openstack入门篇(十)之nova服务(计算节点)的部署与测试

- 【inode】Linux服务器inode索引节点用满原因以及解决方法