torch.optim.Adam() 函数用法

函数 用法 torch ADAM

2023-09-27 14:25:47 时间

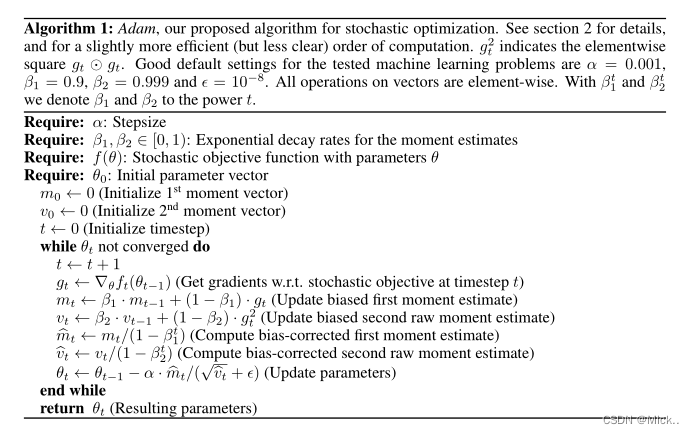

Adam: A method for stochastic optimization

Adam是通过梯度的一阶矩和二阶矩自适应的控制每个参数的学习率的大小。

adam的初始化

def __init__(self, params, lr=1e-3, betas=(0.9, 0.999), eps=1e-8,

weight_decay=0, amsgrad=False):Args:

params (iterable): iterable of parameters to optimize or dicts defining

parameter groups

lr (float, optional): learning rate (default: 1e-3)

betas (Tuple[float, float], optional): coefficients used for computing

running averages of gradient and its square (default: (0.9, 0.999))

eps (float, optional): term added to the denominator to improve

numerical stability (default: 1e-8)

weight_decay (float, optional): weight decay (

相关文章

- php 在函数内引用全局变量 讲解引用

- Numpy 和 random中的随机函数用法汇总

- Python 函数用法和底层分析

- 深度学习入门基础CNN系列——池化(Pooling)和Sigmoid、ReLU激活函数

- 【C/C++】assert()函数用法总结

- 深度学习-TensorFlow2 :构建DNN神经网络模型【构建方式:自定义函数、keras.Sequential、Compile&Fit、自定义Layer、自定义Model】

- Matlab中Rand()函数用法

- Perl Sort函数用法总结和使用实例

- python-day6 多个变量接受函数返回的结果&两个变量交换值

- C++空类产生哪些成员函数 || C++类可以自动生成的6个成员函数

- PyTorch中AdaptiveAvgPool函数用法及原理解析

- find_if 仿函数错误:cannot convert 'this' pointer from 'const CActTaskData' to 'CActTaskData &'

- python中的lambda函数用法

- jQuery中动画函数animate的用法详解【转】

- 【C语言】分段函数求值 控制输出格式 float精确到小数点后几位

- Python 函数的作用域

- 流畅的python第七章函数装饰器和闭包学习记录

- Oracle中nvl,nvl2,nullif,decode,coalesce函数

- 关于mapState和mapMutations和mapGetters 和mapActions辅助函数的用法及作用(一)-----mapState

- PostgreSQL 的日期函数用法举例

- 020 Г函数在正态分布数学期望及方差公式推导的应用;矩估计量、最大似然估计量习题;评价标准之无偏性

- SQL中CONVERT转化函数的用法

- accept函数

- gdb调试程序函数名为问号,什么原因?step by step解决方案

- Async Functions (异步函数)

- FFMPeg代码分析:AVPacket结构体和av_read_frame函数