HDFS 上文件块的副本数设置

2023-09-27 14:23:43 时间

一、使用 setrep 命令来设置

# 设置 /javafx-src.zip 的文件块只存三份 hadoop fs -setrep 3 /javafx-src.zip

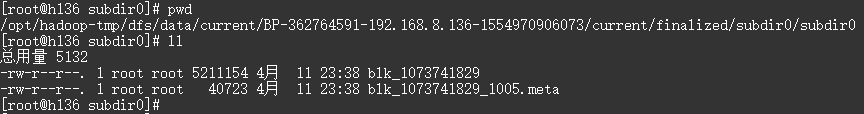

二、文件块在磁盘上的路径

# 设置的 hdfs 目录为

/opt/hadoop-tmp/ # hdfs 文件块的路径为 /opt/hadoop-tmp/dfs/data/current/BP-362764591-192.168.8.136-1554970906073/current/finalized/subdir0/subdir0

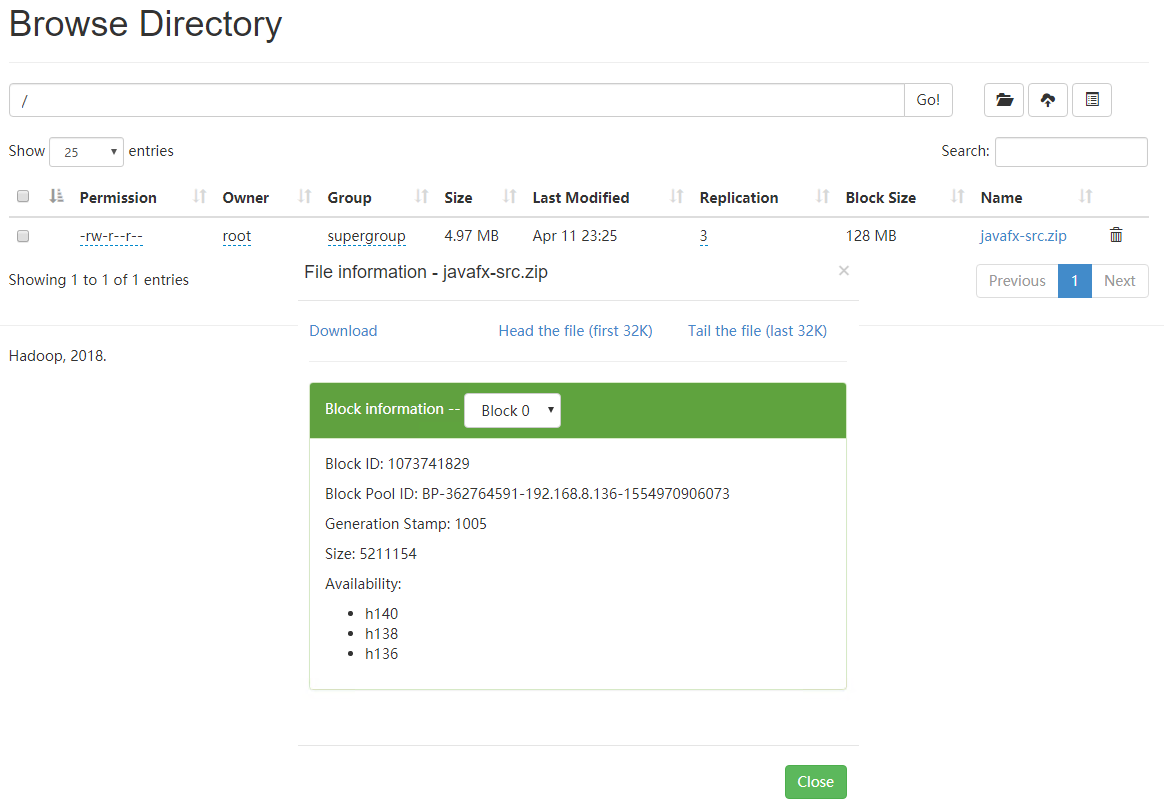

三、文件的分割

文件大小 < 块设定值,文件不会被切割,直接存放到 hdfs 上,占用磁盘的空间就是文件大小

文件大小 > 块设定值,文件被切割为块大小的 N 份文件,最后一份不够块大小也上面一样,只占用本身大小的磁盘空间

下图可以看到该文件副本为 3 份,分别存放在 h140、h138 和 h136 三台机器上

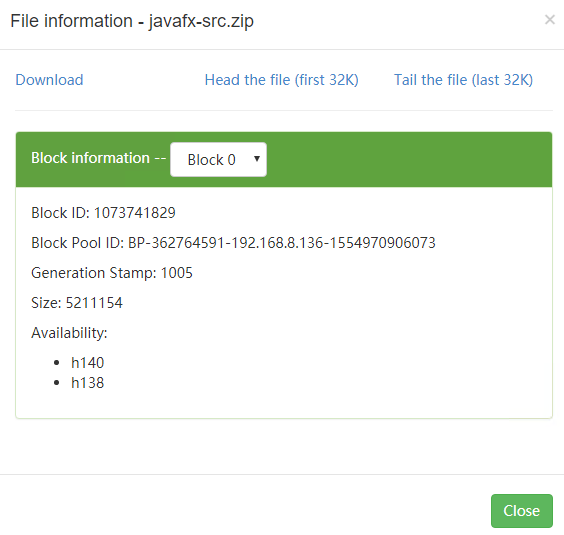

四、改变副本数后的文件的变化

# 减少,会随机删除一个机器上的文件块,这里是删除了 h136 上的 hadoop fs -setrep 2 /javafx-src.zip

# 增加,由于只配置了三台机器无法截图 # 分两种情况: # 机器数量 >= 副本数,会把所有文件块复制到新节点 # 机器数量 < 副本数,会等有新节点增加再执行复制操作,一直到达副本数为止 # 文件块的副本数储存在 NameNode 上 hadoop fs -setrep 5 /javafx-src.zip

http://hadoop.apache.org/docs/current/hadoop-project-dist/hadoop-hdfs/HdfsDesign.html

相关文章

- hadoop学习笔记(四):HDFS文件权限,安全模式,以及整体注意点总结

- 02、创建RDD(集合、本地文件、HDFS文件)

- HDFS 文件的上传与下载

- HDFS 开发中的文件配置优先级

- java读取XML文件的四种方法总结(必看篇)

- @PropertySouce注解 读取 properties文件

- git 本地文件里内容 操作记录

- 大数据IMF传奇 java开发hadoop wodcount和hdfs文件 !

- 第9.8节 Python使用writelines函数写入文件内容

- 通过虚拟机的hdfs读取本地mysql上的文件

- libcurl上传文件,添加自定义头

- 合并hive/hdfs小文件

- Hhadoop-2.7.0中HDFS写文件源码分析(二):客户端实现(1)

- HDFS读取文件失败Incorrect value for packet payload size