Python爬虫爬取美剧网站

一直有爱看美剧的习惯,一方面锻炼一下英语听力,一方面打发一下时间。之前是能在视频网站上面在线看的,可是自从广电总局的限制令之后,进口的美剧英剧等貌似就不在像以前一样同步更新了。但是,作为一个宅diao的我又怎甘心没剧追呢,所以网上随便查了一下就找到一个能用迅雷下载的美剧下载网站【天天美剧】,各种资源随便下载,最近迷上的BBC的高清纪录片,大自然美得不要不要的。

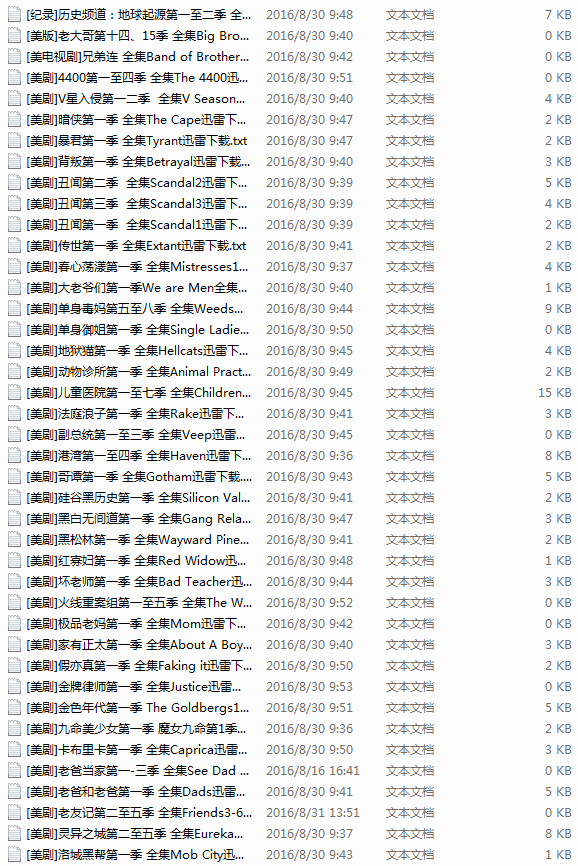

虽说找到了资源网站可以下载了,但是每次都要打开浏览器,输入网址,找到该美剧,然后点击链接才能下载。时间长了就觉得过程好繁琐,而且有时候网站链接还会打不开,会有点麻烦。正好一直在学习Python爬虫,所以今天就心血来潮来写了个爬虫,抓取该网站上所有美剧链接,并保存在文本文档中,想要哪部剧就直接打开复制链接到迅雷就可以下载啦。

其实一开始打算写那种发现一个url,使用requests打开抓取下载链接,从主页开始爬完全站。但是,好多重复链接,还有其网站的url不是我想的那么规则,写了半天也没有写出我想要的那种发散式的爬虫,也许是自己火候还不到吧,继续努力。。。

后来发现,其电视剧链接都是在文章里面,然后文章url后面有个数字编号,就像这样的http://cn163.net/archives/24016/,所以机智的我又用了之前写过的爬虫经验,解决方法就是自动生成url,其后面的数字不是可以变的吗,而且每部剧的都是唯一的,所以尝试了一下大概有多少篇文章,然后用range函数直接连续生成数来构造url。

但是很多url是不存在的,所以会直接挂掉,别担心,我们用的可是requests,其自带的status_code就是用来判断请求返回的状态的,所以只要是返回的状态码是404的我们都把它跳过,其他的都进去爬取链接,这就解决了url的问题了。

以下就是上述步骤的实现代码。

url=base_url+str(i)+/ if requests.get(url).status_code == 404: continue else: self.save_links(url) except Exception,e: pass

其余的就进行的很顺利了,网上找到前人写的类似的爬虫,但是只是爬取一篇文章的,所以借鉴了一下其正则表达式。自己用了BeautifulSoup还没有正则效果好,所以果断弃了,学海无涯啊。但是效果也不是那么理想,有一半左右的链接不能正确抓取,还需继续优化。

content=data.text link_pat="(ed2k://\|file\|[^"]+?\.(S\d+)(E\d+)[^"]+?1024X\d{3}[^"]+?)" name_pat=re.compile(r h2 (.*?) /h2 ,re.S) links = set(re.findall(link_pat,content)) name=re.findall(name_pat,content) links_dict = {} count=len(links) except Exception,e: pass for i in links: links_dict[int(i[1][1:3]) * 100 + int(i[2][1:3])] = i#把剧集按s和e提取编号 try: with open(name[0].replace(/, )+.txt,w) as f: print name[0] for i in sorted(list(links_dict.keys())):#按季数+集数排序顺序写入 f.write(links_dict[i][0] + \n) print "Get links ... ", name[0], count except Exception,e: pass def get_urls(self): try: for i in range(2015,25000): base_url=http://cn163.net/archives/ url=base_url+str(i)+/ if requests.get(url).status_code == 404: continue else: self.save_links(url) except Exception,e: pass def main(self): thread1=threading.Thread(target=self.get_urls()) thread1.start() thread1.join() if __name__ == __main__: start=time.time() a=Archives() a.main() end=time.time() print end-start

完整版代码,其中还用到了多线程,但是感觉没什么用,因为Python的GIL的缘故吧,看似有两万多部剧,本以为要很长时间才能抓取完成,但是除去url错误的和没匹配到的,总共抓取时间20分钟不到。搞得我本来还想使用Redis在两台Linux上爬取,但是折腾了一番之后感觉没必要,所以就这样吧,后面需要更大数据的时候再去弄。

还有过程中遇到一个很折磨我的问题是文件名的保存,必须在此抱怨一下,txt文本格式的文件名能有空格,但是不能有斜线、反斜线、括号等。就是这个问题,一早上的时间都花在这上面的,一开始我以为是抓取数据的错误,后面查了半天才发现是爬取的剧名中带有斜杠,这可把我坑苦了。

作者:肖豪

来源:51CTO

python实战爬取招聘网站职位数据 大家都知道金三银四是每年的求职高峰期,是中国招聘市场中最热门的季节之一。这段时间内,许多公司会发布大量的招聘信息,吸引大批求职者前来应聘。同时,也有许多人选择这个时候跳槽,因为这个时候找到新工作的机会相对较大。

电子商城网站(python+vue)毕业设计 电子商城网站(python+vue)毕业设计。给师弟做的毕业设计。平台采用B/S结构,后端采用主流的Python语言进行开发,前端采用主流的Vue.js进行开发。

在线图书借阅网站( Python +Vue 实现) 平台采用 B/S 结构,后端采用主流的 Python 语言进行开发,前端采用主流的 Vue.js 进行开发。本系统可拿来用于自我学习,也可以用于毕业设计。

利用基于Python的Pelican打造一个自己的个人纯静态网站 之前我曾经写过两篇相似的文章用来快速搭建个人网站,一款基于go lang:[利用基于Go Lang的Hugo配合nginx来打造属于自己的纯静态博客系统](https://v3u.cn/a_id_81)另外一款基于node.js:[使用Hexo建立一个轻量、简易、高逼格的博客](https://v3u.cn/a_id_93),这一次带来一款基于python的静态网页生成器Pelican,它是一位法国开发者开发的,非常好用,它的每一篇文章会事先渲染成HTML静态文件,访问速度非常快

相关文章

- Scrapy框架快速入门,以糗事百科为例进行说明【python爬虫入门进阶】(16)

- Python分布式爬虫框架Scrapy 打造搜索引擎(四) - 爬取博客网站

- 【python语言】基本语法记录

- Pyspider框架 —— Python爬虫实战之爬取 V2EX 网站帖子

- 一文3000字从0到1教你用python+selenium搭建UI自动化测试环境以及使用

- 2023年学习C语言还是学Python爬虫?

- 为什么要学习Python爬虫与数据可视化?

- python--logging库学习_第三波

- 【python爬虫】根据查询词爬取网站返回结果

- python 爬虫系列09-selenium+拉钩

- python 爬虫系列09-异步斗图来一波

- 【Python爬虫】经典案例代码测试

- 使用Python,OpenCV确定对象的颜色

- Python 列表(list)、字典(dict)、字符串(string)常用基本操作小结

- 【Python】常见的时间操作(时间区间、时间相加减、指定年月天数等。。。

- pytest 3.9在python 2.7下的一个bug

- PyQt(Python+Qt)学习随笔:Qt Designer中部件与国际化有关的设置translatable、 disambiguation和comment含义

- 第11.23节 Python 中re模块的搜索替换功能:sub及subn函数

- 第11.1节 Python正则表达式概述

- Python中使用eval执行下面函数的结果怎么是字符串'10020'?

- 利用Python进行数据分析——数据规整化:清理、转换、合并、重塑(七)(1)

- python爬虫CSDN文章抓取

- Python 删除list列表中出现的任何空列表的方法

- Python 安装pandas报错:ValueError: check_hostname requires server_hostname解决方法

- Python爬虫项目70例,附源码 70个Python爬虫练手实例

- 如何入门 Python 爬虫?

- Python爬虫采集CloudBlog网站的文章