机器学习笔记----最小二乘法

2023-09-27 14:20:14 时间

一,参考的博文

如何理解最小二乘法?_马同学图解数学的博客-CSDN博客_最小二乘法

什么是「最小二乘法」_remeber6666的博客-CSDN博客

二,什么是最小二乘法

最小二乘法主要用于解决函数模型最优解问题

最小二乘法,即:

使用下面的例子进行讲解:

最小二乘法是这样,要尽全力让这条直线最接近这些点

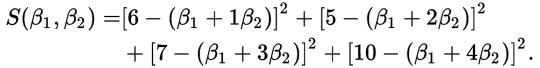

那么问题来了,怎么才叫做最接近呢?直觉告诉我们,这条直线在所有数据点中间穿过,让这些点到这条直线的误差之和越小越好。这里我们用方差来算更客观。也就是说,把每个点到直线的误差平方加起来:

(如果上面的四个方程都能满足,那么S的值显然为0,这是最完美的,但如果做不到完美,我们就让这个S越小越好)

接下来的问题就是,如何让这个S变得最小。这里有一个概念,就是求偏导数。这里我想提一下,在培训的过程中,我发现机器学习的数学基础课程当中,微积分是大家印象最深刻的,而且也最容易理解:比如导数就是求变化率,而偏导数则是当变量超过一个的时候,对其中一个变量求变化率。要让S取得最小值,那最好是对β1和β2分别求导(对β1求导的时候,把β2当常量所以叫求偏导),值为0:

很容易得出:

这个函数也就是我们要的直线,这条直线虽然不能把那些点串起来,但它能最大程度上接近这些点。也就是说5公里的时候,成本为3.5+1.4x5=10.5块,虽然不完美,但是很接近实际情况。

三,什么是高斯牛顿法

高斯牛顿法正是用于解决非线性最小二乘问题,达到数据拟合、参数估计和函数估计的目的。

参考的博文:

数值优化之高斯-牛顿法(Gauss-Newton)_图灵的猫i的博客-CSDN博客_gauss newton法

相关文章

- 神经网络与机器学习 笔记—卷积神经网络(CNN)

- 神经网络与机器学习 笔记—泛化和交叉验证

- 机器学习框架ML.NET学习笔记【1】基本概念与系列文章目录

- 机器学习笔记之正则化(三)权重衰减角度(偏差方向)

- 机器学习笔记之前馈神经网络(四)反向传播算法[数学推导过程]

- 机器学习笔记之狄利克雷过程(四)从概率图角度认识狄利克雷过程

- 机器学习笔记之狄利克雷过程(三)随机测度的生成过程(折棍子过程)

- 机器学习笔记之前馈神经网络(二)非线性问题

- 机器学习笔记之配分函数(二)——随机最大似然

- 机器学习笔记之概率图模型(九)最大乘积算法(Max-Product Algorithm)

- 机器学习笔记之马尔可夫链蒙特卡洛方法(一)蒙特卡洛方法介绍

- 机器学习笔记之隐马尔可夫模型(七)总结部分

- 机器学习笔记之EM算法(三)隐变量与EM算法的本质

- 机器学习笔记之线性分类——朴素贝叶斯分类器(Naive Bayes Classifier)

- 机器学习笔记之高斯分布(二)——基于参数预测的有偏估计与无偏估计

- Andrew Ng机器学习公开课笔记 -- Logistic Regression

- 吴恩达机器学习笔记 —— 19 应用举例:照片OCR(光学字符识别)

- 吴恩达机器学习笔记 —— 13 支持向量机

- 吴恩达机器学习笔记 —— 7 Logistic回归

- 吴恩达机器学习笔记 —— 8 正则化

- Andrew Ng-机器学习基础笔记-SVM

- 机器学习笔记——皮尔逊相关系数

- 机器学习笔记——贝叶斯学习

- 吴恩达机器学习笔记2--回归、分类问题(未看完)