基于DataIDE数据集成实现香港ECS上的MySQL数据同步到数加MaxCompute

最近有朋友问,客户在香港ECS上搭建的MySQl,大概有100GB以上的数据,能否通过MaxCompute做海量数据分析,我的回答是YES!

但客户担心香港与大陆之间数据连通性问题,我的回答依然是YES!

为了让更多个客户不再困扰,笔者做了一份教程,可以通过大数据开发套件中的经典网络进行同步数据,有图为证!

准备工作

1、注册并开通阿里云账号、Access id、Access Key;开通方法:https://help.aliyun.com/document_detail/47703.html?spm=5176.doc30266.6.544.NLgOin

2、购买并开通香港区域经典网络ECS;购买地址:https://ecs.console.aliyun.com/#/create/prepay/?data=eyJkYXRhIjp7InZtX3JlZ2lvbl9ubyI6ImNuLWhvbmdrb25nLWFtNC1jMDQifX0%3D

3、下载并搭建MySQL 5.7 ;下载地址:https://dev.mysql.com/downloads/windows/installer/5.7.html

4、购买并开通MaxCompute、大数据开发套件;开通方法:https://help.aliyun.com/document_detail/30263.html?spm=5176.doc30262.6.546.El4j9u

跨区域数据同步

1、设置ECS安全组

进入ECS管控台- ECS管理,设置安全组,添加外网3306 IP访问权限;

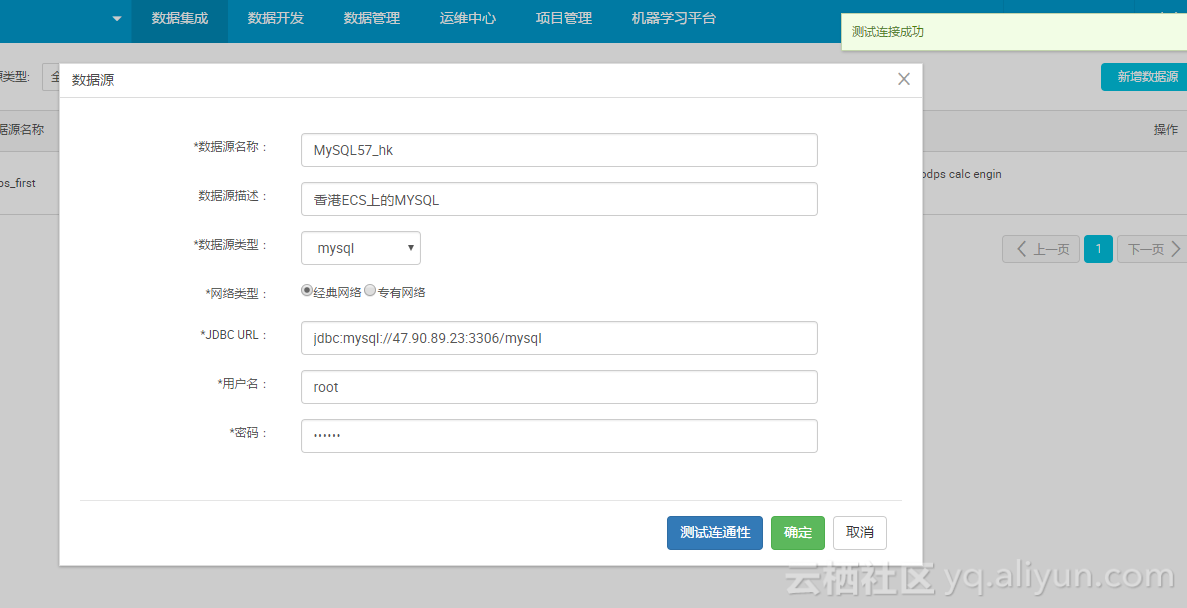

2、添加数据源

通过控制台进入大数据开发套件;

点击数据集成- 左侧列表"数据源"页面- 点击右上交“新增数据源”;

输入数据源MySQL57_hk,选择MySQL 经典网络,MySQL的JDBC地址、账号信息;

点击连通性验证网络;如果不通,请参照本文常见问题;

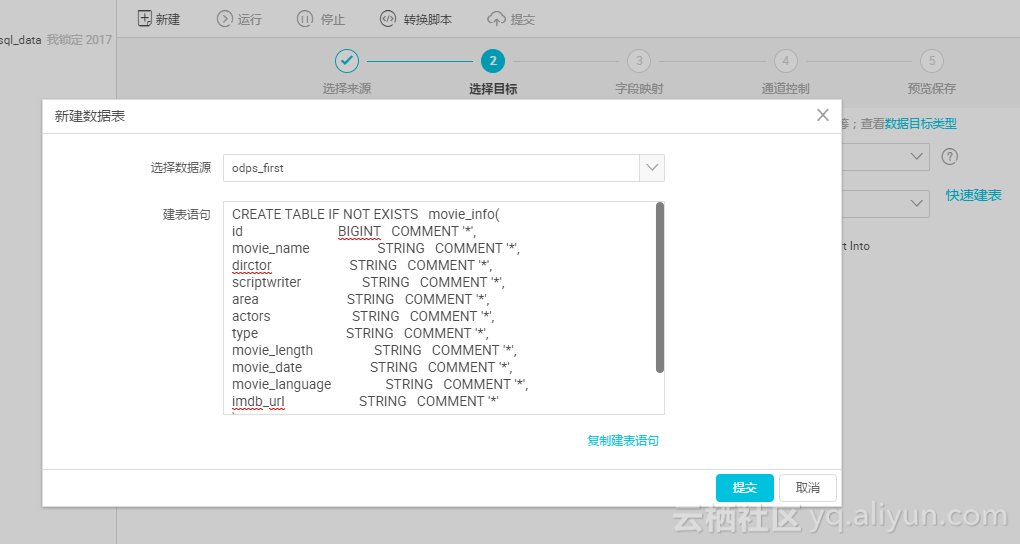

3、创建并设置同步任务

点击进入同步任务,选择需要导入的源表;

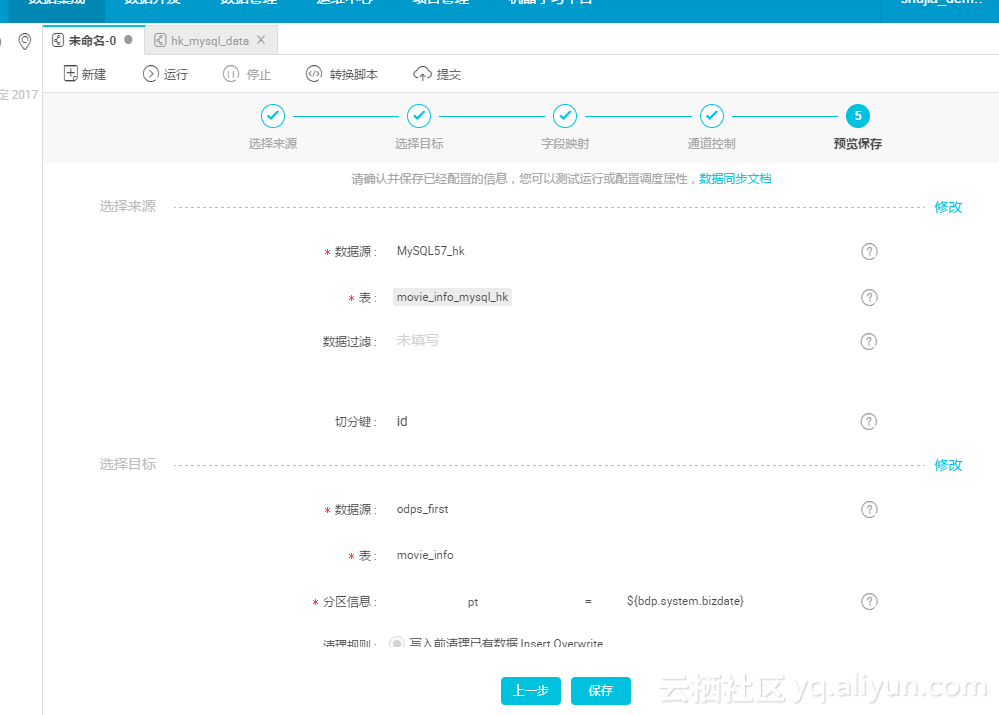

数据源MySQL57_hk,选择或通过搜索框查找"movie_info_mysql_hk",点击下一步;

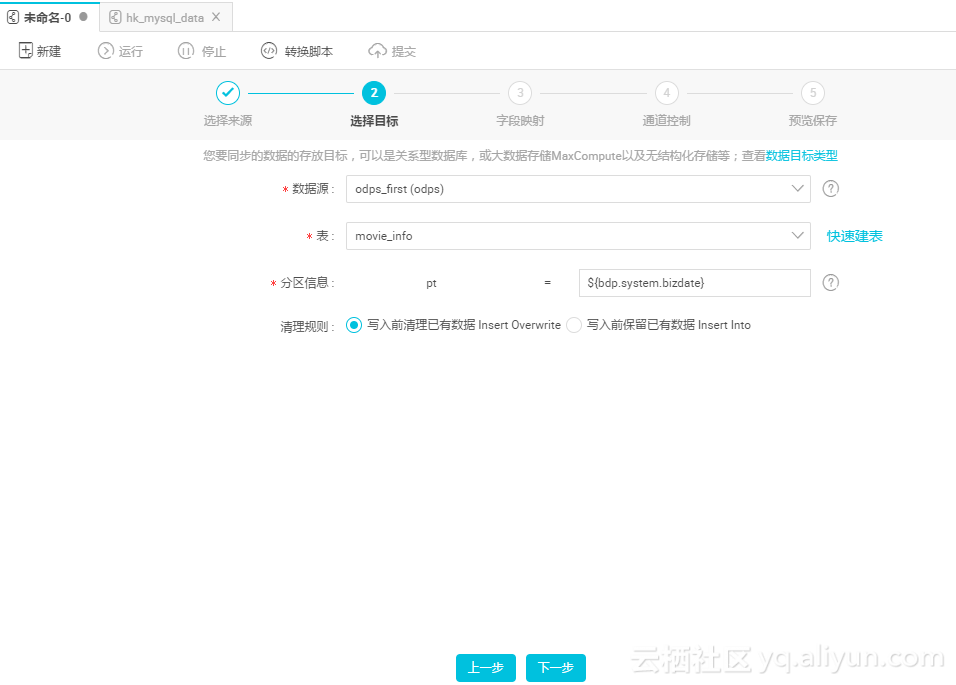

选择目标数据库opds_first,点击快速建表,同步表结构,修改脚本中的表名,改为movie_info,点击提交;

分区信息默认为时间变量,点下一步;

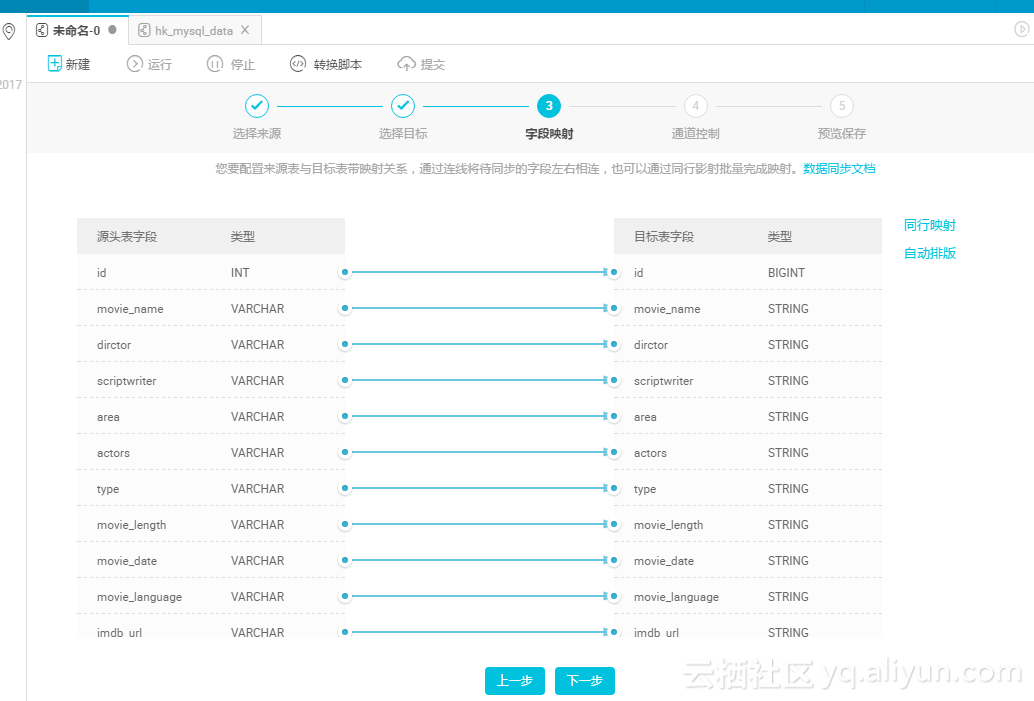

字段自动映射,跳过即可;

通道控制默认,点击下一步;

预览后,点击保存;

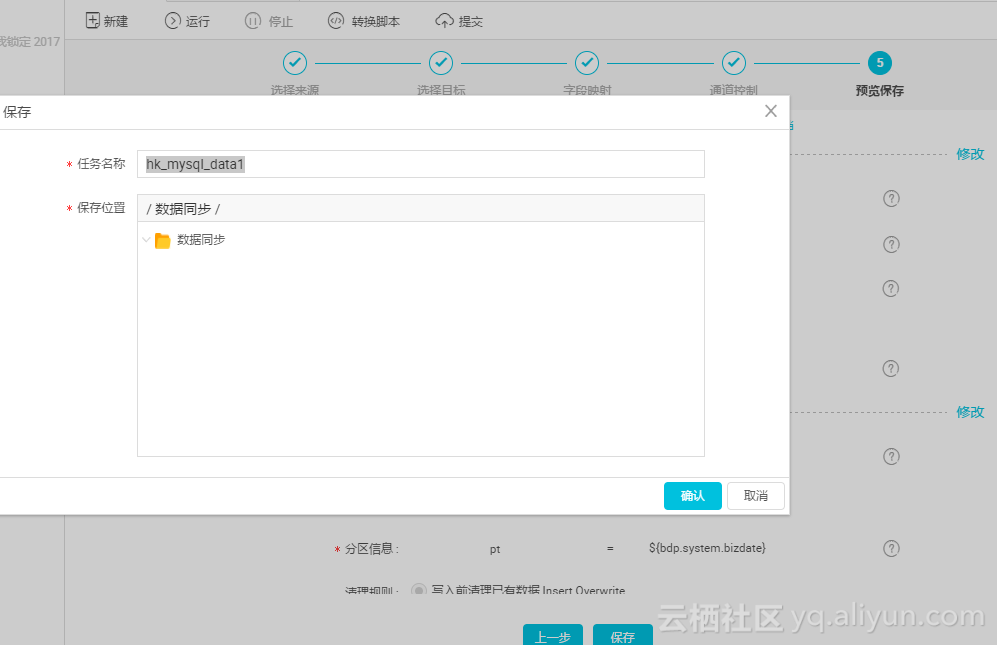

点击保存后,命名数据同步任务名称hk_mysql_data1;

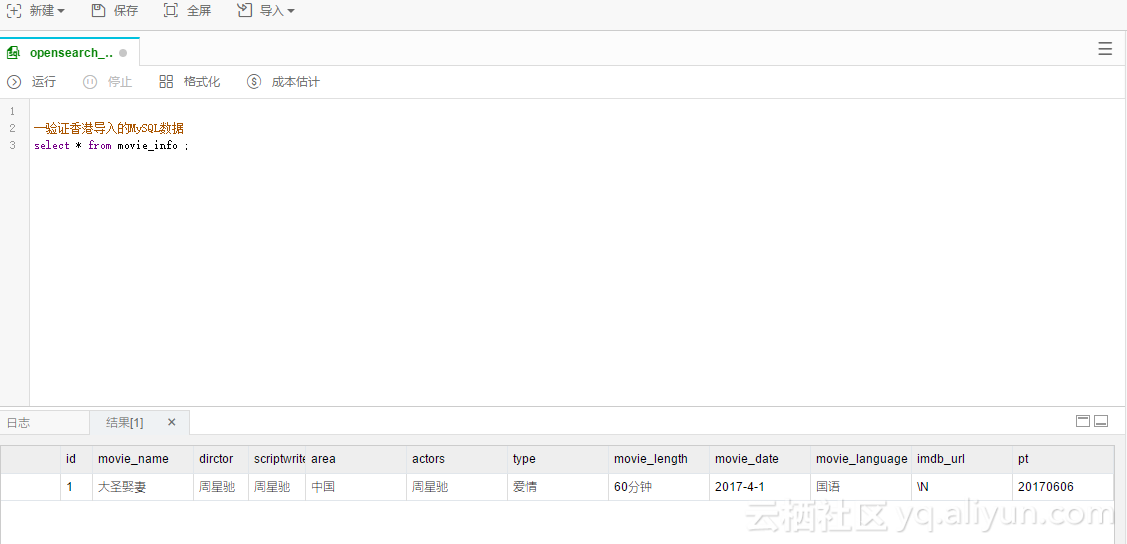

4、执行并验证数据

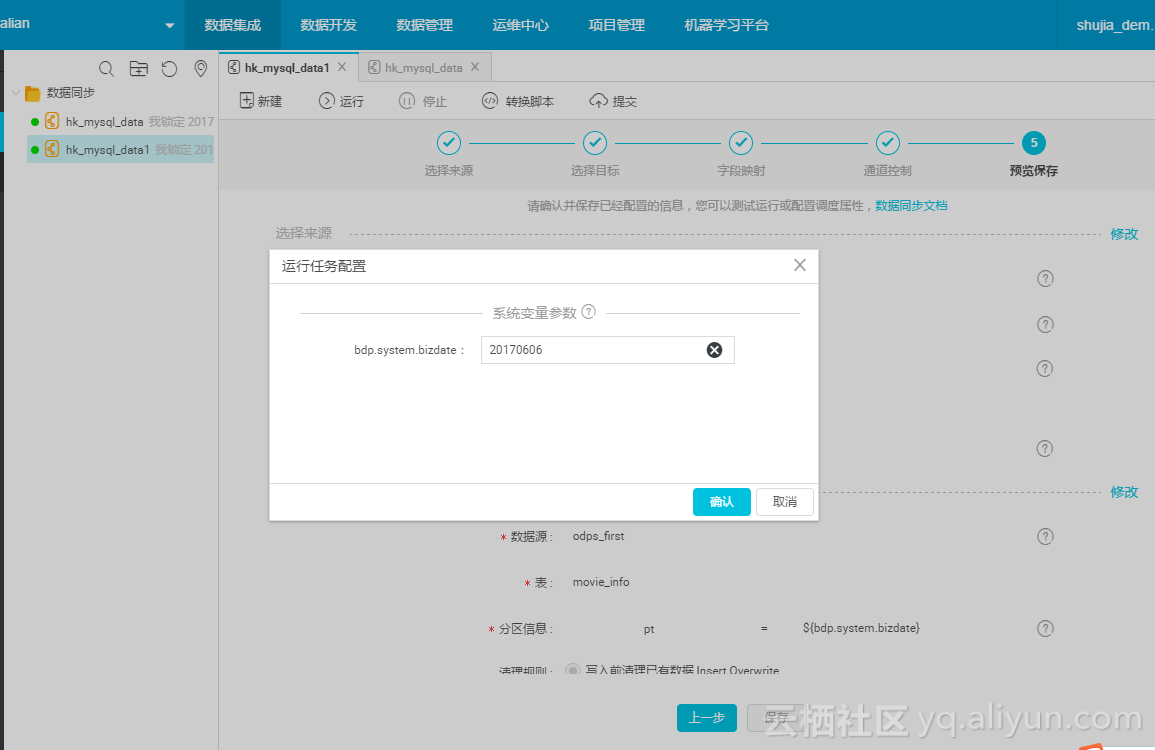

手动执行数据同步,点击运行,选择当天时间戳;

执行完成后,我们去验证一下数据;

进入大数据开发套件- 数据开发;

验证导入的数据;

实验遇到的问题

Q:大数据开发套件(数据集成)中连接不上ECS上的MySQL ,提示:测试连接失败,测试数据源连通性失败:连接数据库失败, 数据库连接串:jdbc:mysql://47.90.89.23:3306/MySQL57-hk, 用户名:root, 异常消息:Communications link failure The last packet sent successfully to the server was 0 milliseconds ago. The driver has not received any packets from the server.

A:进入ECS安全组规则- 设置网络入口访问权限,测试的话可以设置为0.0.0.0/0;

Q:大数据开发套件(数据集成)中连接不上ECS上的MySQL ,提示:测试连接失败,测试数据源连通性失败:连接数据库失败, 数据库连接串:jdbc:mysql://47.90.89.23:3306/mysql, 用户名:root, 异常消息:null, message from server: "Host 121.43.110.160 is not allowed to connect to this MySQL server"

A:MySQL设置远程访问权限,参照:http://kouss.com/aliyun-ecs-mysql-allow-navicat.html

数据集成模块中如何配置Mongo DB数据同步(2) MongoDB是面向文档的NoSQL(非关系型)数据库,它的数据结构由字段(Field)和值(Value)组成,类似于JSON对象。 数据集成的Mongodb输出组件提供了写入Mongodb数据库的能力。本文重点介绍如何配置Mongodb的加载策略。

数据集成模块中如何配置Mongo DB数据同步(1) MongoDB是面向文档的NoSQL(非关系型)数据库,它的数据结构由字段(Field)和值(Value)组成,类似于JSON对象。 数据集成的Mongodb输入组件提供了从mongodb数据库中全量和增量两种读取方式,并且能够对数据自动进行数据分片,从而可以并发的高校读取数据。

阿里云Dataworks数据集成工具实现:OTS - Maxcompute数据同步 数据集成主要用于离线(批量)数据同步。离线(批量)的数据通道通过定义数据来源和去向的数据源和数据集,提供一套抽象化的数据抽取插件(Reader)、数据写入插件(Writer),并基于此框架设计一套简化版的中间数据传输格式,从而实现任意结构化、半结构化数据源之间数据传输。结合用户在使用OTS数据源同步的时候容易出现问题,这里演示:OTS数据源同步数据到Maxcompute的具体实现步骤。

数据集成同步到mysql~小数点后面数据同步不过来 数据集成同步任务时候,用会出现这样一种现象:odps 表里的数据是 11490877.44 ,mysql数据源目标表字段类型float(16,2) 同步过来是11490877小数点后面数据没有同步过来。

数据集成到MaxCompute的N种最佳实践(持续更新) 本文汇总数据集成到MaxCompute的各种最佳实践,希望可以帮助到正在或者即将使用MaxCompute的企业和开发者们。 也欢迎您将有关MaxCompute数据集成的实践分享出来,分享方法可扫码加入钉钉群,联系钉钉群主即可。

MaxCompute/DataWorks 数据集成与开发实践 摘要:在2017杭州云栖大会阿里云数加DataWorks专场上,阿里云产品专家代俊峰(花名:普阳)为大家分享了如何借助阿里云数加DataWorks工具进行数据集成和开发,分享了如何借助DataWorks实现从数据处理手工作坊到数据加工工厂的跨越转变。

MaxCompute(原ODPS)是一项面向分析的大数据计算服务,它以Serverless架构提供快速、全托管的在线数据仓库服务,消除传统数据平台在资源扩展性和弹性方面的限制,最小化用户运维投入,使您经济并高效的分析处理海量数据。

隐林 阿里云大数据产品专家,擅长MaxCompute、机器学习、分布式、可视化、人工智能等大数据领域;

相关文章

- Mysql加锁过程详解(9)-innodb下的记录锁,间隙锁,next-key锁

- mysql索引总结(4)-MySQL索引失效的几种情况

- (转)Amoeba for MySQL 非常好用的mysql集群软件

- mysql高性能分页语句_如何优化Mysql千万级快速分页

- MySQL 用 BETWEEN AND 日期查询包含范围边界

- MySQL事务隔离

- 迄今最安全的MySQL?细数5.7那些惊艳与鸡肋的新特性(中)

- MySQL使用初步—mysql数据库的基本命令

- [转]mysql时报错:mysql: error while loading shared libraries: libncurses.so.5: cannot open shared object fil

- 【MySQL进阶-07】深入理解mysql性能优化以及解决慢查询问题

- Linux安装MySQL(只针对这个8.0版本其他版本的MYSQL不知道是不是也可以用可以自己尝试)

- mysql 查询昨天,今天、七天、30天的数据

- mysql数据库提示本地无法连接远程服务器(Host is not allowed to connect to this MySQL server)解决办法

- .NET/Mysql-petatoco连接mysql数据库

- 转 mysql spool_用MySQL实现类似Oracle SPOOL的功能

- 浅谈tidb事务与MySQL事务之间的区别

- Mysql命令mysql:连接Mysql数据库

- MYSQL高级之MYSQL的逻辑架构

- 有关Mysql的mysql_store_result函数返回NULL的情况以及其他注意事项

- mysql导入数据,涉及到时间转换,乱码问题解决