Redis进阶学习10---redis最佳实践

Redis进阶学习10---redis最佳实践

Redis最佳实践

优雅的key结构

Redis的Key虽然可以自定义,但最好遵循下面的几个最佳实践约定:

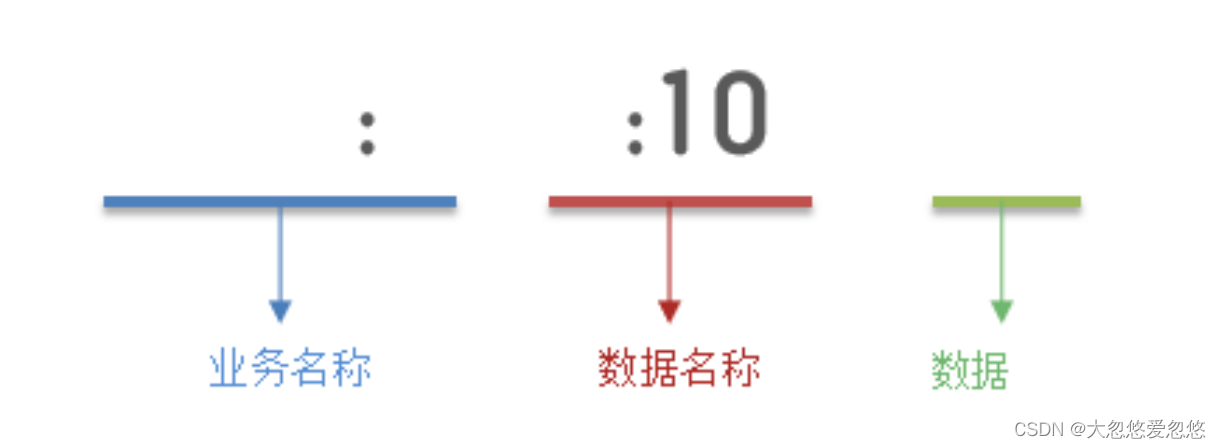

- 遵循基本格式:[业务名称]:[数据名]:[id]

- 长度不超过44字节

- 不包含特殊字符

例如:我们的登录业务,保存用户信息,其key是这样的:

优点:

- 可读性强

- 避免key冲突

- 方便管理

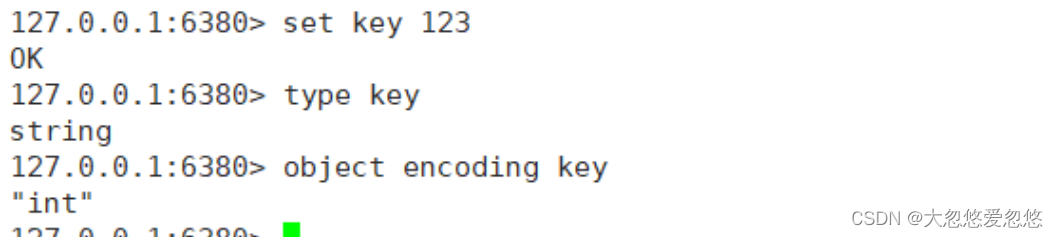

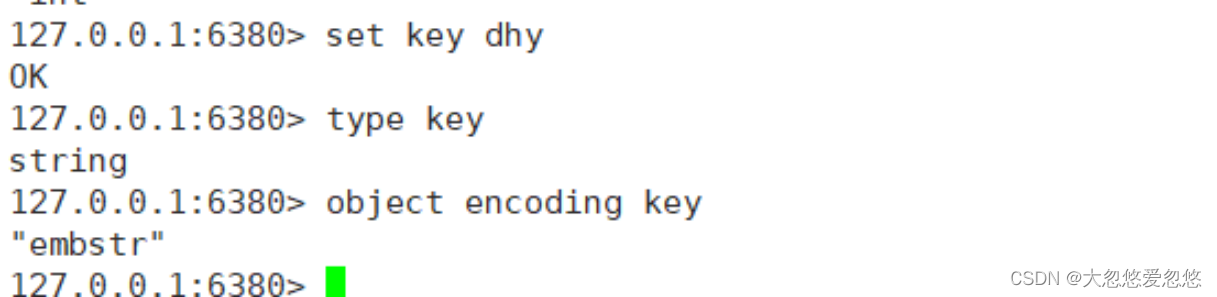

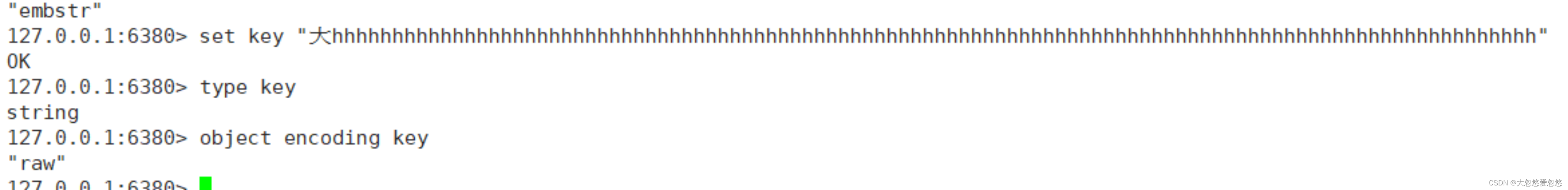

- 更节省内存: key是string类型,底层编码包含int、embstr和raw三种。embstr在小于44字节使用,采用连续内存空间,内存占用更小

当key可以转换为数字时,即key由数字组成,底层会编码为int,如果key长度小于44字节,采用embstr编码类型,否则采用非连续空间存储,为raw编码类型

BigKey问题

BigKey通常以Key的大小和Key中成员的数量来综合判定,例如:

- Key本身的数据量过大:虽然一个String类型的Key最大存储上限为512MB,但是如果该Key值为5 MB就已经算BigKey了,

- Key中的成员数过多:一个ZSET类型的Key,它的成员数量为10,000个。

- Key中成员的数据量过大:一个Hash类型的Key,它的成员数量虽然只有1,000个但这些成员的Value(值)总大小为100

MB。

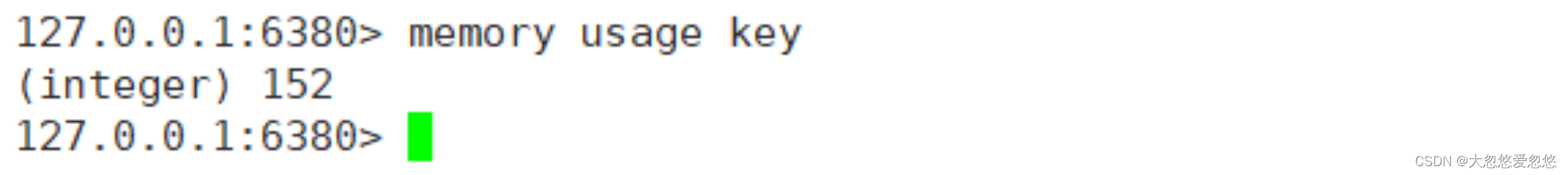

memory usage key,该命令可以查看某个key加其value占用内存大小,但是由于该命令比较消耗cpu资源,因此不太推荐使用

推荐值:

- 单个key的value小于10KB

- 对于集合类型的key,建议元素数量小于1000

BigKey的危害

网络阻塞

- 对BigKey执行读请求时,少量的QPS就可能导致带宽使用率被占满,导致Redis实例,乃至所在物理机变慢

数据倾斜

- BigKey所在的Redis实例内存使用率远超其他实例,无法使数据分片的内存资源达到均衡

Redis阻塞

- 对元素较多的hash、list、zset等做运算会耗时较旧,使主线程被阻塞

CPU压力

- 对BigKey的数据序列化和反序列化会导致CPU的使用率飙升,影响Redis实例和本机其它应用

如何发现BigKeys

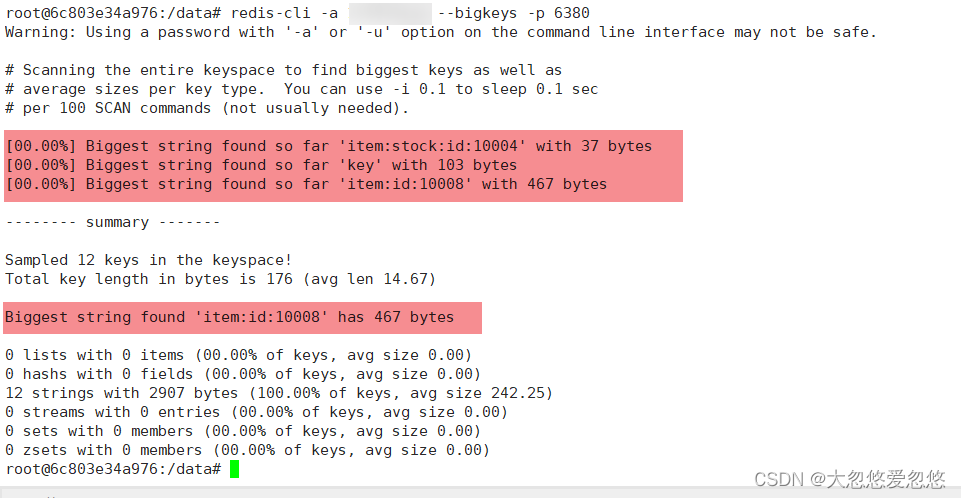

redis-cli --bigkeys

- 利用redis-cli提供的–bigkeys参数,可以遍历分析所有key,并返回Key的整体统计信息与每个数据类型的Top1的big key

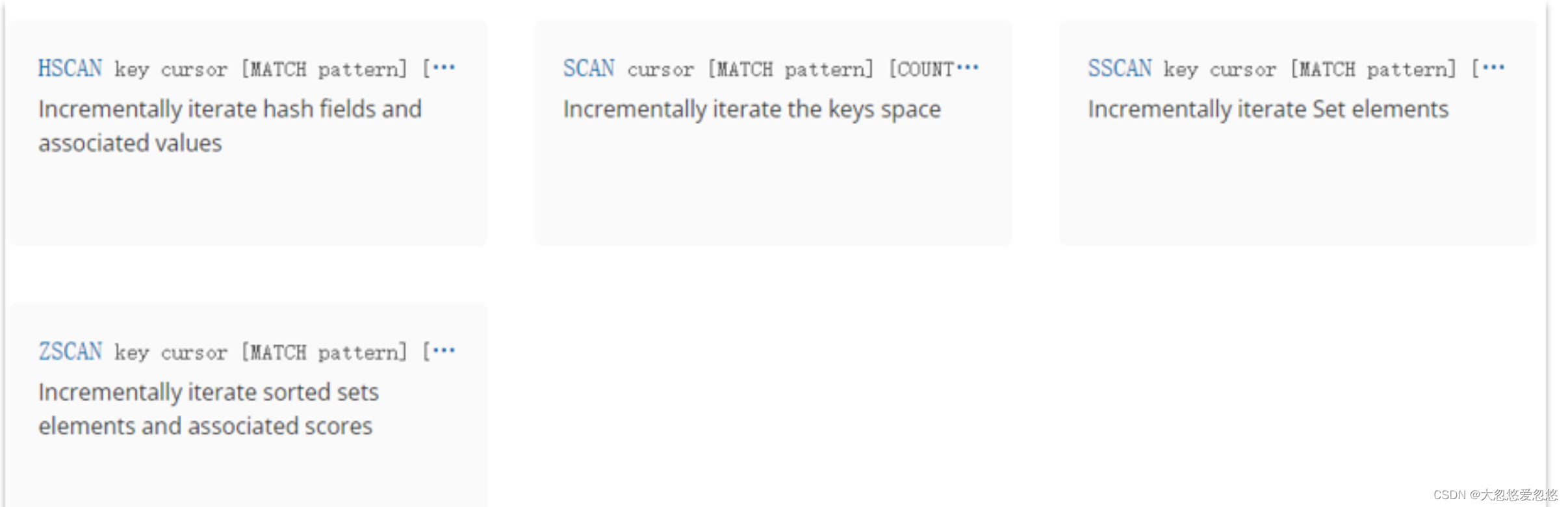

scan扫描

- 自己编程,利用scan扫描Redis中的所有key,利用strlen、hlen等命令判断key的长度(此处不建议使用MEMORY USAGE)

scan相比于keys*的好处在于不会扫描所有key,不会导致主线程阻塞

@Test

void testScan() {

int maxLen = 0;

long len = 0;

String cursor = "0";

do {

// 扫描并获取一部分key

ScanResult<String> result = jedis.scan(cursor);

// 记录cursor

cursor = result.getCursor();

List<String> list = result.getResult();

if (list == null || list.isEmpty()) {

break;

}

// 遍历

for (String key : list) {

// 判断key的类型

String type = jedis.type(key);

switch (type) {

case "string":

len = jedis.strlen(key);

maxLen = STR_MAX_LEN;

break;

case "hash":

len = jedis.hlen(key);

maxLen = HASH_MAX_LEN;

break;

case "list":

len = jedis.llen(key);

maxLen = HASH_MAX_LEN;

break;

case "set":

len = jedis.scard(key);

maxLen = HASH_MAX_LEN;

break;

case "zset":

len = jedis.zcard(key);

maxLen = HASH_MAX_LEN;

break;

default:

break;

}

if (len >= maxLen) {

System.out.printf("Found big key : %s, type: %s, length or size: %d %n", key, type, len);

}

}

} while (!cursor.equals("0"));

}

第三方工具

- 利用第三方工具,如 Redis-Rdb-Tools 分析RDB快照文件,全面分析内存使用情况

网络监控

- 自定义工具,监控进出Redis的网络数据,超出预警值时主动告警

如何删除bigKeys

BigKey内存占用较多,即便时删除这样的key也需要耗费很长时间,导致Redis主线程阻塞,引发一系列问题。

- redis 3.0 及以下版本

如果是集合类型,则遍历BigKey的元素,先逐个删除子元素,最后删除BigKey

删除集合中的子元素,也是推荐采用游标扫描的方式进行删除

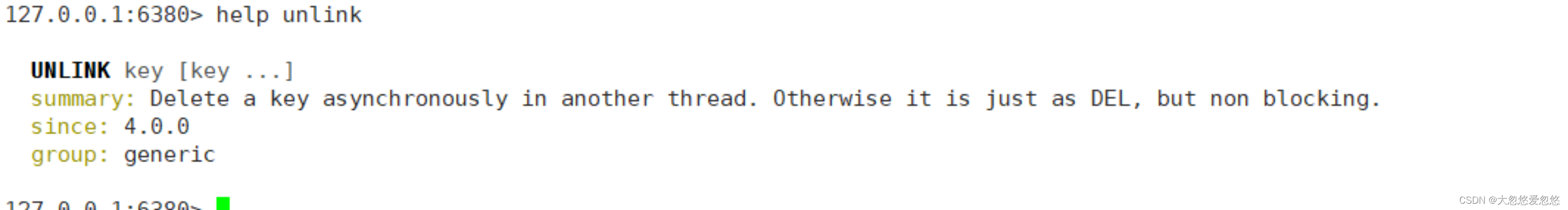

- Redis 4.0以后

Redis在4.0后提供了异步删除的命令:unlink

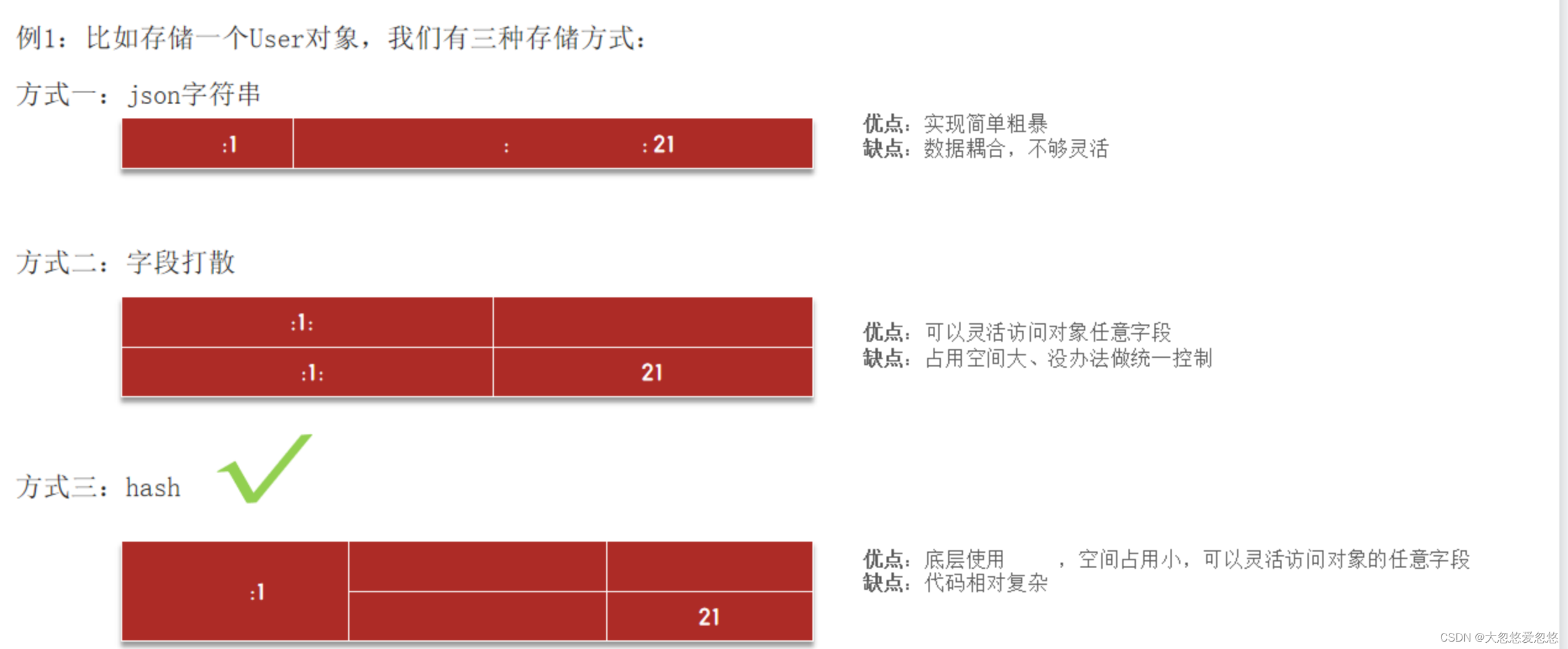

恰当的数据类型

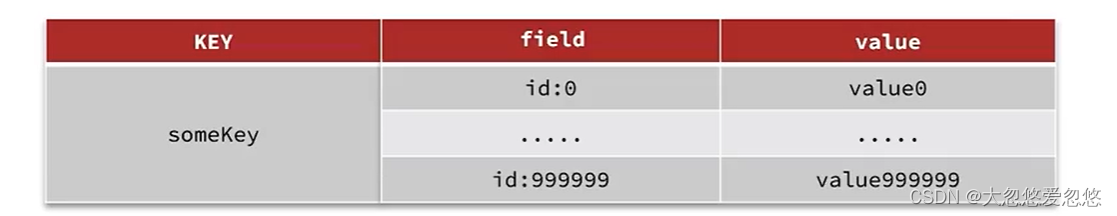

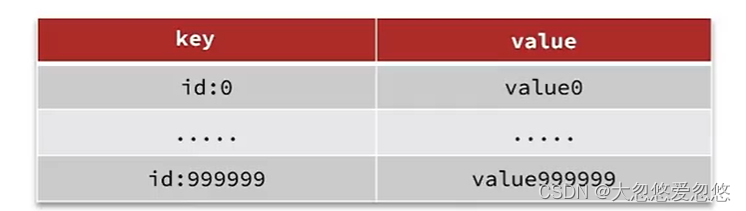

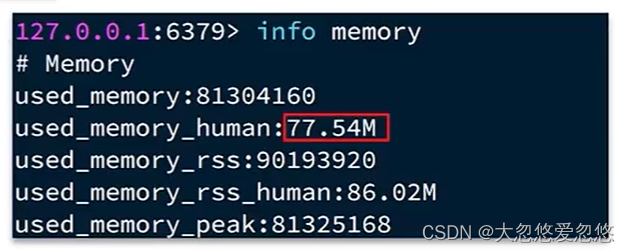

例2:假如有hash类型的key,其中有100万对field和value,field是自增id,这个key存在什么问题?如何优化?

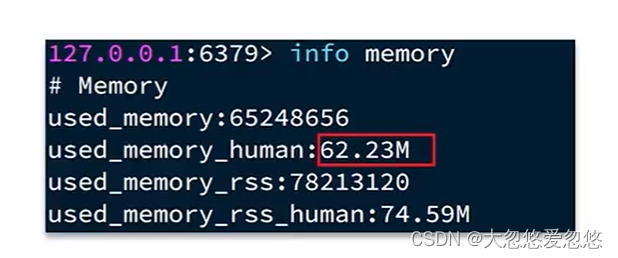

这是拥有100万个entries的hash占用大小

存在的问题:

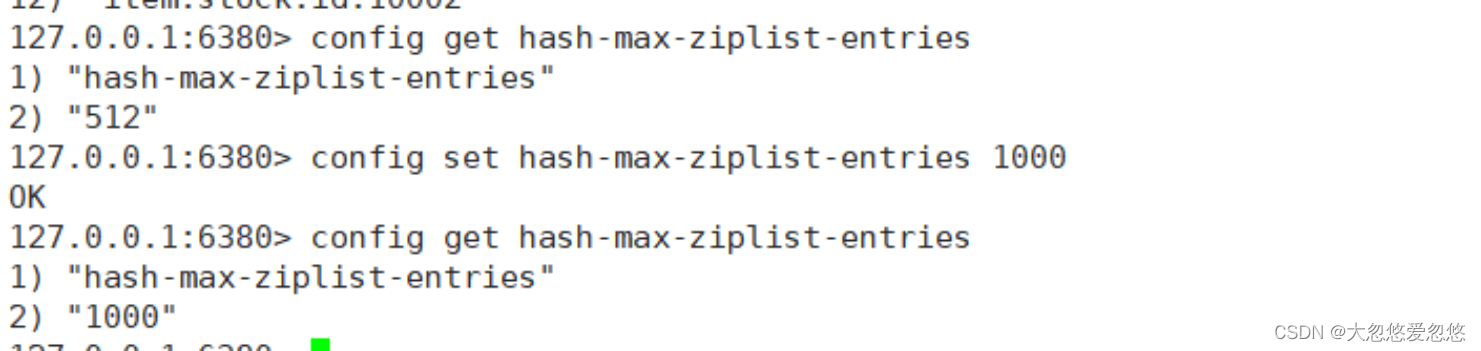

- hash的entry数量超过500时,会使用哈希表而不是ZipList,内存占用较多。

- 可以通过hash-max-ziplist-entries配置entry上限。但是如果entry过多就会导致BigKey问题

redis可以通过CONFIG命令查看或设置配置项

重启即失效

方案二:拆分为string类型:

存在的问题:

- string结构底层没有太多内存优化,内存占用较多。

- 想要批量获取这些数据比较麻烦

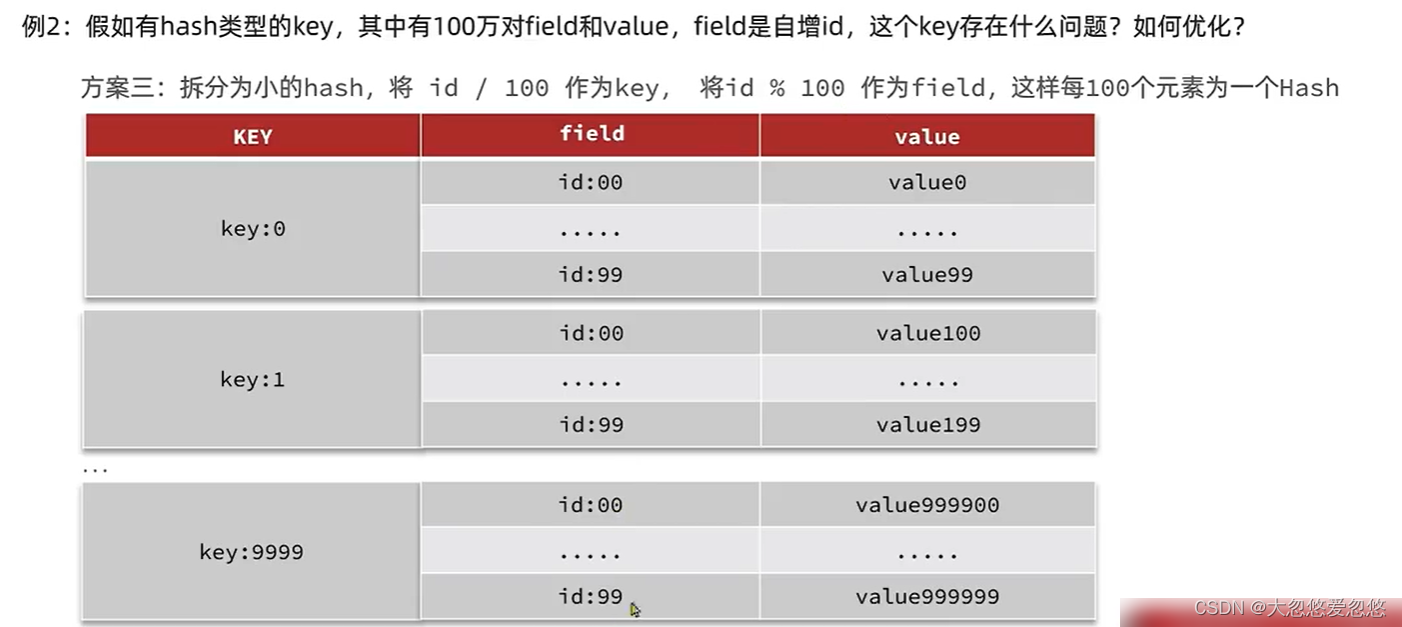

方案三:拆分为小的hash,将 id / 100 作为key, 将id % 100 作为field,这样每100个元素为一个Hash

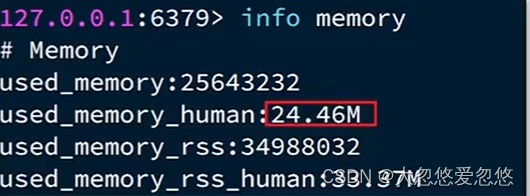

可以看到大hash分解为多个小hash占用的内存是最少的

因为,如果能确保每个小hash的entries数量不超过hash-max-ziplist-entries限制,底层就会使用ZipList进行存储,这样是最节约空间的

小总结

Key的最佳实践:

- 固定格式:[业务名]:[数据名]:[id]

- 足够简短:不超过44字节

- 不包含特殊字符

Value的最佳实践:

- 合理的拆分数据,拒绝BigKey

- 选择合适数据结构

- Hash结构的entry数量不要超过1000

- 设置合理的超时时间

批处理优化

Pipeline和原生命令

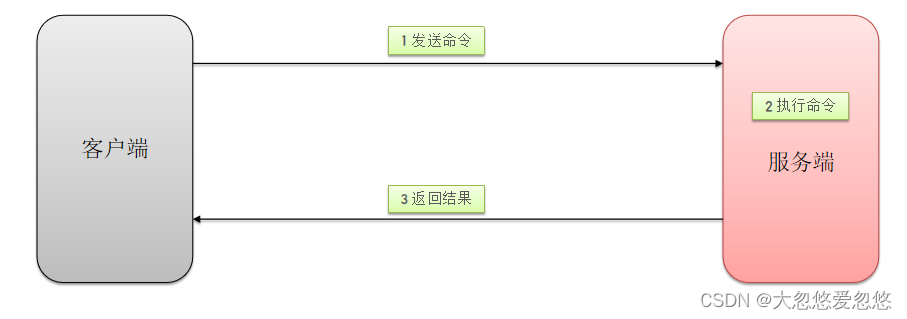

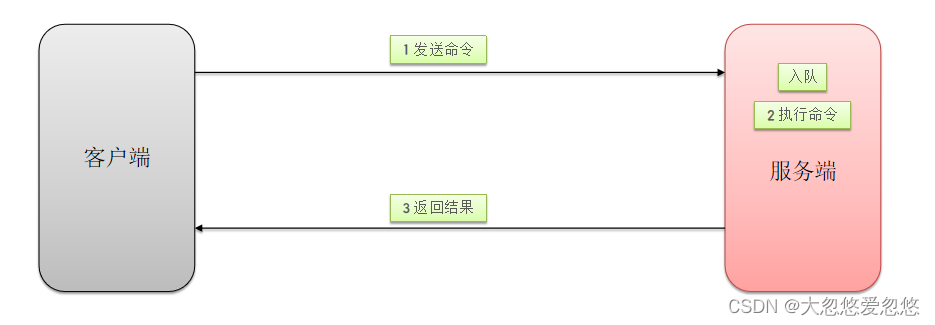

单个命令的执行流程

一次命令的响应时间 = 1次往返的网络传输耗时 + 1次Redis执行命令耗时

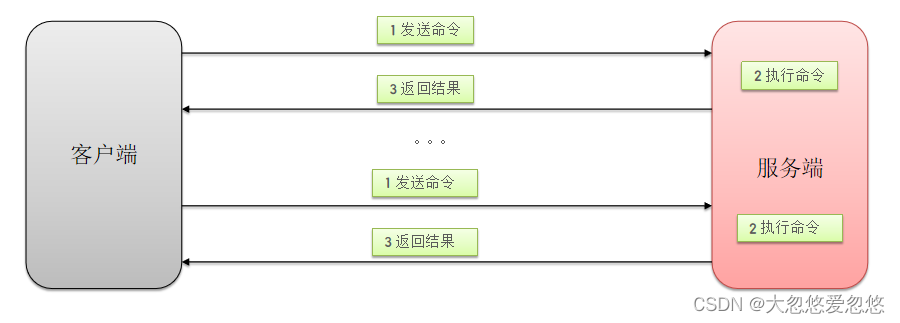

N条命令依次执行

N次命令的响应时间 = N次往返的网络传输耗时 + N次Redis执行命令耗时

其实网络的传输耗时一般都在毫秒级别,但是命令的执行是在微妙级别的,因此当redis客户端需要传入n次命令到redis服务器进行执行的时候,大部分时间是花费在了网络数据传输上面,命令执行耗时反而可以忽略不计,那么想要提高多条命令的执行速度,就可以采用一次性将多条命令通过网络进行传输的方式,减少网络传输次数

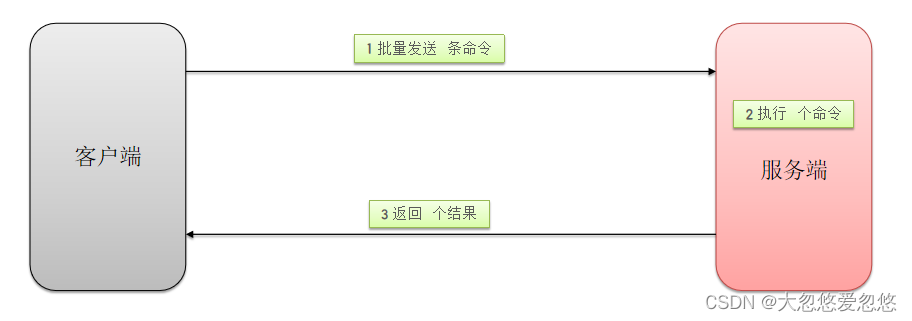

N条命令批量执行

N次命令的响应时间 = 1次往返的网络传输耗时 + N次Redis执行命令耗时

MSET

Redis提供了很多Mxxx这样的命令,可以实现批量插入数据,例如:

- mset

- hmset

利用mset批量插入10万条数据:

@Test

void testMxx() {

String[] arr = new String[2000];

int j;

long b = System.currentTimeMillis();

for (int i = 1; i <= 100000; i++) {

j = (i % 1000) << 1;

arr[j] = "test:key_" + i;

arr[j + 1] = "value_" + i;

if (j == 0) {

jedis.mset(arr);

}

}

long e = System.currentTimeMillis();

System.out.println("time: " + (e - b));

}

Pipeline

MSET虽然可以批处理,但是却只能操作部分数据类型,因此如果有对复杂数据类型的批处理需要,建议使用Pipeline功能:

Redis 管道技术可以在服务端未响应时,客户端可以继续向服务端发送请求,并最终一次性读取所有服务端的响应。

管道(pipeline)可以一次性发送多条命令并在执行完后一次性将结果返回,pipeline 通过减少客户端与 redis 的通信次数来实现降低往返延时时间,而且 Pipeline 实现的原理是队列,而队列的原理是时先进先出,这样就保证数据的顺序性。 Pipeline 的默认的同步的个数为53个,也就是说 arges 中累加到53条数据时会把数据提交。

通俗点:pipeline就是把一组命令进行打包,然后一次性通过网络发送到Redis。同时将执行的结果批量的返回回来

需要注意到是用 pipeline 方式打包命令发送,redis 必须在处理完所有命令前先缓存起所有命令的处理结果。打包的命令越多,缓存消耗内存也越多。所以并不是打包的命令越多越好。具体多少合适需要根据具体情况测试。

@Test

void testPipeline() {

// 创建管道

Pipeline pipeline = jedis.pipelined();

long b = System.currentTimeMillis();

for (int i = 1; i <= 100000; i++) {

// 放入命令到管道

pipeline.set("test:key_" + i, "value_" + i);

if (i % 1000 == 0) {

// 每放入1000条命令,批量执行

pipeline.sync();

}

}

long e = System.currentTimeMillis();

System.out.println("time: " + (e - b));

}

pipelined.sync()表示我一次性的异步发送到redis,不关注执行结果。

pipeline.syncAndReturnAll ();将返回执行过的命令返回的List列表结果

有些系统可能对可靠性要求很高,每次操作都需要立马知道这次操作是否成功,是否数据已经写进 redis 了,那这种场景就不适合。

还有的系统,可能是批量的将数据写入 redis,允许一定比例的写入失败,那么这种场景就可以使用了,比如10000条一下进入 redis,可能失败了2条无所谓,后期有补偿机制就行了,比如短信群发这种场景,如果一下群发10000条,按照第一种模式去实现,那这个请求过来,要很久才能给客户端响应,这个延迟就太长了,如果客户端请求设置了超时时间5秒,那肯定就抛出异常了,而且本身群发短信要求实时性也没那么高,这时候用 pipeline 最好了。

单机批处理小结

批量处理的方案:

- 原生的M操作

- Pipeline批处理

注意事项:

- 批处理时不建议一次携带太多命令

- Pipeline的多个命令之间不具备原子性

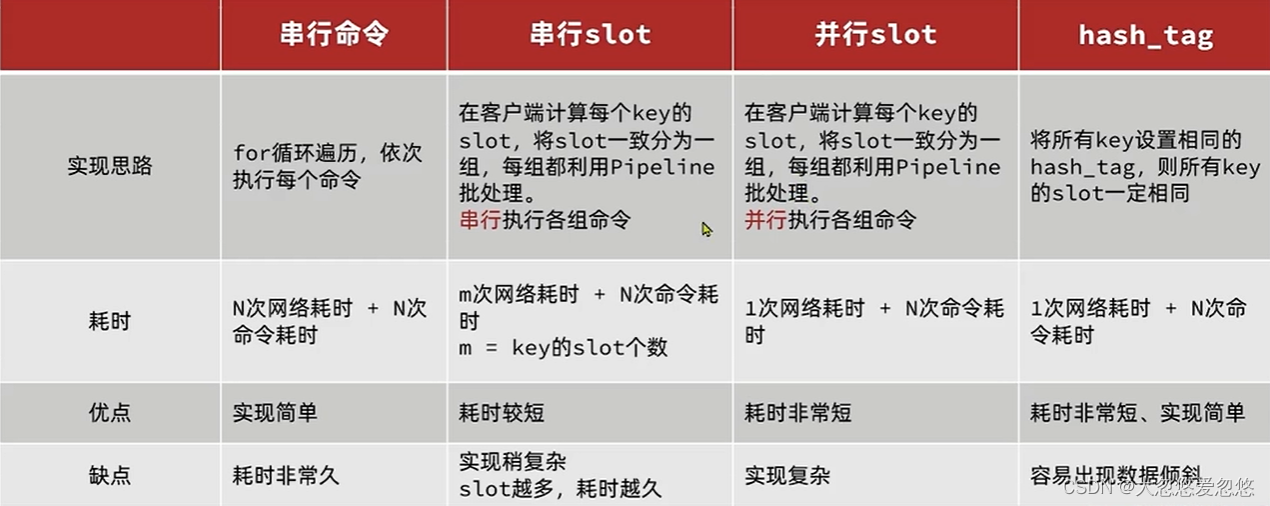

集群下的批处理

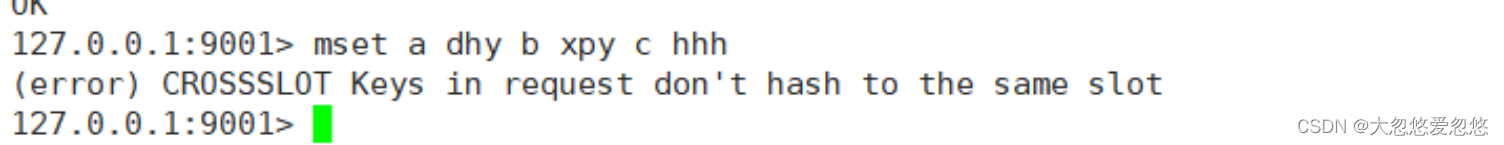

如MSET或Pipeline这样的批处理需要在一次请求中携带多条命令,而此时如果Redis是一个集群,那批处理命令的多个key必须落在一个插槽中,否则就会导致执行失败。

这里说的集群是分片集群

如果Redis是一个集群,那批处理命令的多个key必须落在一个插槽中,否则就会导致执行失败。

使用原生jedis提供的串行slot完成批处理优化

public class JedisClusterTest {

private JedisCluster jedisCluster;

@BeforeEach

void setUp() {

// 配置连接池

JedisPoolConfig poolConfig = new JedisPoolConfig();

poolConfig.setMaxTotal(8);

poolConfig.setMaxIdle(8);

poolConfig.setMinIdle(0);

poolConfig.setMaxWaitMillis(1000);

HashSet<HostAndPort> nodes = new HashSet<>();

nodes.add(new HostAndPort("192.168.150.101", 7001));

nodes.add(new HostAndPort("192.168.150.101", 7002));

nodes.add(new HostAndPort("192.168.150.101", 7003));

nodes.add(new HostAndPort("192.168.150.101", 8001));

nodes.add(new HostAndPort("192.168.150.101", 8002));

nodes.add(new HostAndPort("192.168.150.101", 8003));

jedisCluster = new JedisCluster(nodes, poolConfig);

}

@Test

void testMSet() {

jedisCluster.mset("name", "Jack", "age", "21", "sex", "male");

}

//串行slot

@Test

void testMSet2() {

Map<String, String> map = new HashMap<>(3);

map.put("name", "Jack");

map.put("age", "21");

map.put("sex", "Male");

//将相同插槽值的元素放在一个list集合中

Map<Integer, List<Map.Entry<String, String>>> result = map.entrySet()

.stream()

.collect(Collectors.groupingBy(

//将元素按照key的插槽值进行分组

entry -> ClusterSlotHashUtil.calculateSlot(entry.getKey()))

);

//一次性刷新一组插槽

for (List<Map.Entry<String, String>> list : result.values()) {

String[] arr = new String[list.size() * 2];

int j = 0;

for (int i = 0; i < list.size(); i++) {

j = i<<2;

Map.Entry<String, String> e = list.get(0);

arr[j] = e.getKey();

arr[j + 1] = e.getValue();

}

jedisCluster.mset(arr);

}

}

@AfterEach

void tearDown() {

if (jedisCluster != null) {

jedisCluster.close();

}

}

}

我们使用的是串行slot完成的批处理优化,spirng为我们提供了并行slot方案,一起来看看吧

使用spring提供的并行slot完成批处理优化

@Test

void testMSetInCluster(){

HashMap<String, String> hashMap = new HashMap<>();

hashMap.put("name","Rose");

hashMap.put("age","21");

hashMap.put("sex","Female");

redisTemplate.opsForValue().multiSet(hashMap);

List<String> strings = redisTemplate.opsForValue().multiGet(Arrays.asList("name", "age", "sex"));

strings.forEach(System.out::println);

}

multiset一个简单方法调用真的能够完成并行slot吗,让我们来看看他的实现吧:

直接看最终真正执行调用的方法实现即可:

public RedisFuture<String> mset(Map<K, V> map) {

//进行插槽分类

Map<Integer, List<K>> partitioned = SlotHash.partition(this.codec, map.keySet());

if (partitioned.size() < 2) {

return super.mset(map);

} else {

Map<Integer, RedisFuture<String>> executions = new HashMap();

Iterator var4 = partitioned.entrySet().iterator();

while(var4.hasNext()) {

Entry<Integer, List<K>> entry = (Entry)var4.next();

Map<K, V> op = new HashMap();

((List)entry.getValue()).forEach((k) -> {

op.put(k, map.get(k));

});

//super.mset的返回值为RedisFuture说明是异步执行,从这里可以看出执行方式为并行slot

RedisFuture<String> mset = super.mset(op);

executions.put(entry.getKey(), mset);

}

return MultiNodeExecution.firstOfAsync(executions);

}

}

持久化配置

Redis的持久化虽然可以保证数据安全,但也会带来很多额外的开销,因此持久化请遵循下列建议:

- 用来做缓存的Redis实例尽量不要开启持久化功能

- 建议关闭RDB持久化功能,使用AOF持久化

- 利用脚本定期在slave节点做RDB,实现数据备份,因为RDB的文件体积较小

- 设置合理的rewrite阈值,避免频繁的bgrewrite

- 配置no-appendfsync-on-rewrite = yes,禁止在rewrite期间做aof,避免因AOF引起的阻塞

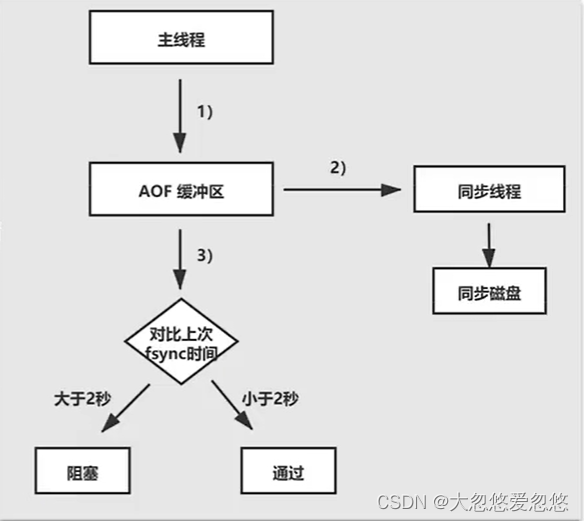

Redis虽然会异步执行aof刷盘动作,但是redis主线程在将命令记录到aof缓存区后,会等待两秒,如果两秒内还没有刷盘完成,那么为了数据一致性安全,会阻塞等待,直到刷盘结束。

因为rewrite的过程比较慢,因此不建议在rewrite期间去做aof,否则大概率导致主线程阻塞。

部署有关建议:

- Redis实例的物理机要预留足够内存,应对fork和rewrite

- 单个Redis实例内存上限不要太大,例如4G或8G。可以加快fork的速度、减少主从同步、数据迁移压力

- 不要与CPU密集型应用部署在一起

- 不要与高硬盘负载应用一起部署。例如:数据库、消息队列

慢查询

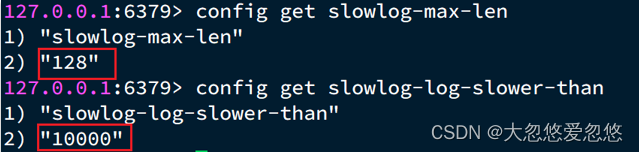

慢查询:在Redis执行时耗时超过某个阈值的命令,称为慢查询。

慢查询的阈值可以通过配置指定:

- slowlog-log-slower-than:慢查询阈值,单位是微秒。默认是10000,建议1000

Redis一般命令执行时间都在几十微妙左右,而默认慢查询阈值为10毫秒,建议改小一点

慢查询会被放入慢查询日志中,日志的长度有上限,可以通过配置指定:

- slowlog-max-len:慢查询日志(本质是一个队列)的长度。默认是128,建议1000

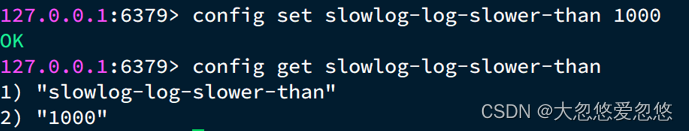

改这两个配置可以使用:config set命令:

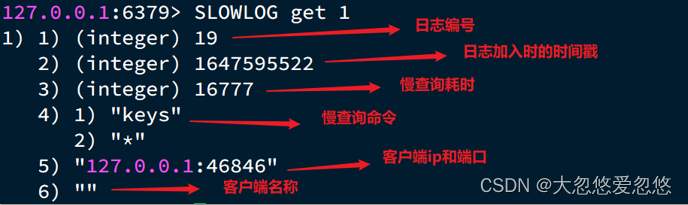

查看慢查询日志列表:

- slowlog len:查询慢查询日志长度

- slowlog get [n]:读取n条慢查询日志

- slowlog reset:清空慢查询列表

命令及安全配置

Redis会绑定在0.0.0.0:6379,这样将会将Redis服务暴露到公网上,而Redis如果没有做身份认证,会出现严重的安全漏洞.

漏洞重现方式:https://cloud.tencent.com/developer/article/1039000

漏洞出现的核心的原因有以下几点:

- Redis未设置密码

- 利用了Redis的config set命令动态修改Redis配置

- 使用了Root账号权限启动Redis,因为需要把.ssh文件放入到root目录下面需要root权限

为了避免这样的漏洞,这里给出一些建议:

- Redis一定要设置密码

- 禁止线上使用下面命令:keys、flushall、flushdb、config,set等命令。可以利用rename-command禁用。‘

- bind:限制网卡,禁止外网网卡访问

- 开启防火墙

- 不要使用Root账户启动Redis

- 尽量不是有默认的端口

内存配置

当Redis内存不足时,可能导致Key频繁被删除、响应时间变长、QPS不稳定等问题。当内存使用率达到90%以上时就需要我们警惕,并快速定位到内存占用的原因。

数据内存的问题

Redis提供了一些命令,可以查看到Redis目前的内存分配状态:

- info memory

- memory xxx

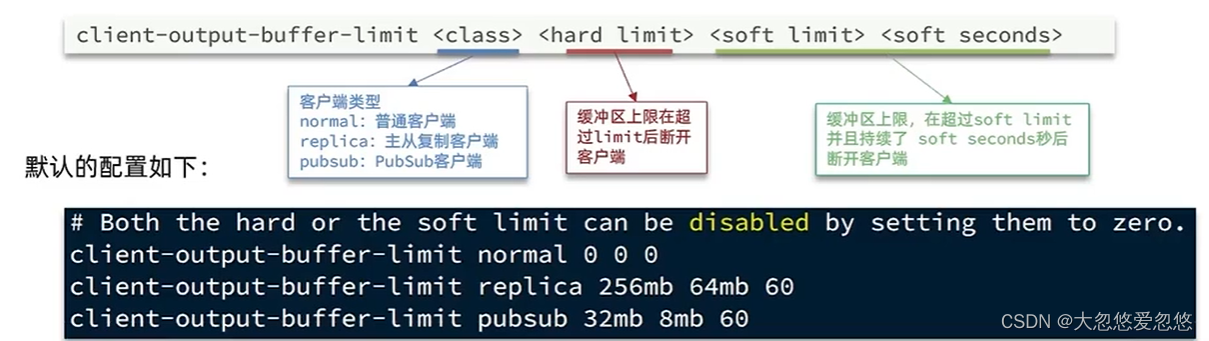

内存缓冲区配置

内存缓冲区常见的有三种:

- 复制缓冲区:主从复制的repl_backlog_buf,如果太小可能导致频繁的全量复制,影响性能。通过repl-backlog-size来设置,默认1mb

- AOF缓冲区:AOF刷盘之前的缓存区域,AOF执行rewrite的缓冲区。无法设置容量上限

- 客户端缓冲区:分为输入缓冲区和输出缓冲区,输入缓冲区最大1G且不能设置。输出缓冲区可以设置

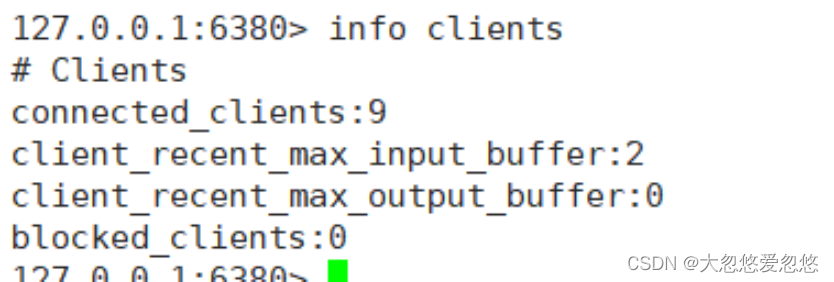

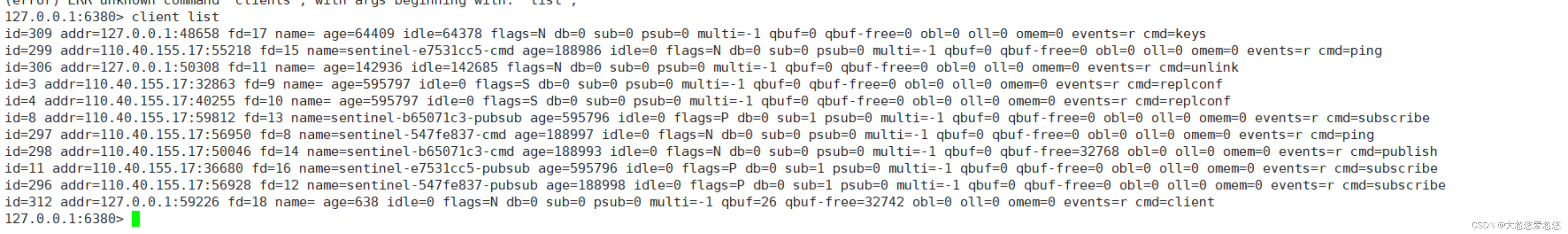

info clients查看连接客户端全局信息

clients list查看连接客户端列表

如果客户端输出缓冲区溢出,那么omem的值会很大

集群最佳实践

集群虽然具备高可用特性,能实现自动故障恢复,但是如果使用不当,也会存在一些问题:

- 集群完整性问题

- 集群带宽问题

- 数据倾斜问题

- 客户端性能问题

- 命令的集群兼容性问题

- lua和事务问题

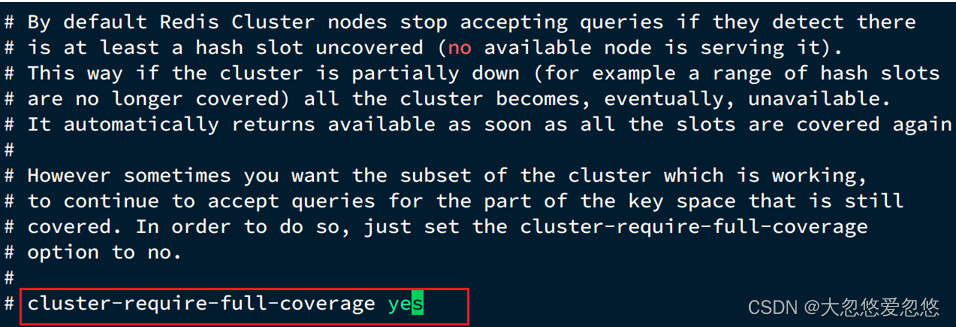

集群完整性问题

在Redis的默认配置中,如果发现任意一个插槽不可用,则整个集群都会停止对外服务:

为了保证高可用特性,这里建议将 cluster-require-full-coverage配置为false

集群带宽问题

集群节点之间会不断的互相Ping来确定集群中其它节点的状态。每次Ping携带的信息至少包括:

- 插槽信息

- 集群状态信息

集群中节点越多,集群状态信息数据量也越大,10个节点的相关信息可能达到1kb,此时每次集群互通需要的带宽会非常高。

解决途径:

- 避免大集群,集群节点数不要太多,最好少于1000,如果业务庞大,则建立多个集群。

- 避免在单个物理机中运行太多Redis实例

- 配置合适的cluster-node-timeout值,如果这个值太小,那么ping探测频率会变高,太大那么集群故障恢复速度会变慢

集群还是主从

集群虽然具备高可用特性,能实现自动故障恢复,但是如果使用不当,也会存在一些问题:

- 集群完整性问题

- 集群带宽问题

- 数据倾斜问题

- 客户端性能问题

- 命令的集群兼容性问题

- lua和事务问题

相关文章

- 完整阿里云Redis开发规范

- Redis事务

- Redis安装完后redis-cli无法使用(redis-cli: command not found)

- 【Docker】docker安装redis

- Redis学习(3)-redis启动

- redis集群之REDIS CLUSTER

- redis 学习笔记三(队列功能)

- Redis学习笔记

- redis数据库-django操作redis

- Redis 切片集群:数据增多了,是该加内存还是加实例?

- Docker搭建Redis高可用集群(基于redis-sentinel)

- Lua 脚本内部执行 Redis 命令

- Redis缓存穿透、缓存雪崩、redis并发问题 并发竞争key的解决方案 (阿里)

- Atitit redis使用 attilax 艾提拉总结 1.1. Redis默认有16个库,默认连接的是 index=0 的那一个。解决与原来不方便查询查看的问题1 1.2. redis不是现

- 上手测试GaussDB(for Redis) 和开源 Redis,只为推荐质优价廉的Redis

- linux下 redis 启动

- 【高并发】Redis如何助力高并发秒杀系统,看完这篇我彻底懂了!!

- 002-redis-数据类型(string(字符串),hash(哈希),list(列表),set(集合)及zset(sorted set:有序集合))

- redis_05 _ 内存快照:宕机后,Redis如何实现快速恢复

- redis_02 _ 数据结构:快速的Redis有哪些慢操作?

- Redis进阶学习07--分布式缓存--下

- Docker学习笔记17:docker实例之安装 Node.js、PHP、MySQL、Tomcat、Python、Redis、MongoDB、Apache

- 【redis源码学习】传说中,redis使用的是单线程?

- 【redis源码学习】simple dynamic strings(简单动态字符串 sds)