爬虫日记(63):Scrapy的设置参数-日志

2023-09-14 09:10:04 时间

在开发Scrapy爬虫的应用时,通常使用这些设置来对程序进行一些分析,比如通过输出日志、统计和Telnet工具提供性能和调试信息。

可以参考下面的连接:

https://docs.scrapy.org/en/latest/topics/settings.html#std-setting-LOG_LEVEL

日志

Scrapy制定了日志的等级,可以根据发生问题的严重程度,把日志分为:CRITICAL, ERROR, WARNING, INFO, DEBUG。当爬虫要发布上线稳定之后,只要输出CRITICAL级的日志就可以了,如果是刚上线的系统,设置为DEBUG,这样可以获得更多出错的信息,更加方便开发人员来查找出错的原因。因为有可能一些问题,出现的几率很低,偶尔才会出现,如果输出的日志信息太少,导致很难查找。当然这样做会导致服务器运行的效率降低,但是这样做才能找到问题并把系统改稳定。除此之外,还有一个NOTSET等级,使用这个等级就会输出所有日志。

相关文章

- 【Python3网络爬虫开发实战】1.5.1-PyMySQL的安装

- 第三百五十三节,Python分布式爬虫打造搜索引擎Scrapy精讲—scrapy的暂停与重启

- 第三百四十五节,Python分布式爬虫打造搜索引擎Scrapy精讲—爬虫和反爬的对抗过程以及策略—scrapy架构源码分析图

- 第三百二十六节,web爬虫,scrapy模块,解决重复ur——自动递归url

- 爬虫部署-2,基于Docker的Scrapy+Scrapyd+Scrapydweb部署

- Python - 网络爬虫(Web Scraping)

- 小白学 Python 爬虫(4):前置准备(三)Docker基础入门

- 小白学 Python 爬虫(1):开篇

- 爬虫部署-3,爬虫管理平台,Crawlab、Gerapy、Scrapydweb,SpiderKeeper,scrapyd,基于上述平台,构思自己的爬虫管理平台

- 基于scrapy的分布式爬虫抓取新浪微博个人信息和微博内容存入MySQL

- Python爬虫:scrapy从项目创建到部署可视化定时任务运行

- python爬虫:scrapy-redis实现分布式爬虫

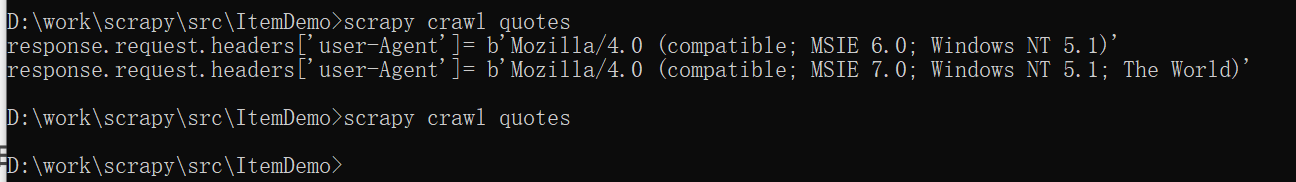

- Python爬虫:scrapy防止爬虫被禁的策略

- Python爬虫:scrapy查看Cookie值

- Python爬虫:js加密实例-有道翻译

- Python爬虫:Scrapy中间件Middleware和Pipeline

- Python爬虫:滤网架构处理爬虫数据

- 爬虫日记(66):Scrapy的设置参数-抓取风格

- 爬虫日记(62):Scrapy的合约测试

- Crawler/ML:爬虫技术(基于urllib.request库从网页获取图片)+HierarchicalClustering层次聚类算法,实现自动从网页获取图片然后根据图片色调自动分类

- Crawler之Scrapy:基于scrapy框架实现爬虫两个网址下载网页内容信息之详细攻略

- Scrapy爬虫框架详解