爬虫日记(83):Scrapy的CrawlerProcess类(一)

2023-09-14 09:10:04 时间

前面学习了Twisted的基础知识了,接着回过头来再看整个Scrapy程序,在执行 Scrapy 命令时,主要经过以下几步:

1)调用 cmdline.py 的 execute 方法

2)找到对应的命令实例解析命令行

3)构建 CrawlerProcess 实例,调用 crawl 和 start 方法开始抓取

而 crawl 方法最终是调用了 Cralwer 实例的 crawl,这个方法最终把控制权交给了Engine,而 start 方法注册好协程池,就开始异步调度执行了。

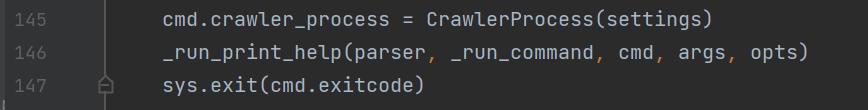

在 cmdline.py有execute方法里进行如下创建:

调用时CrawlerProcess(settings)来创建一个对象保存到cmd.crawler_process变量,这个CrawlerProcess对象才是我们需要关注的对象,因为它接管了execute的执行权,而要理解CrawlerProcess对象,就得理解CrawlerProcess类,它是在文件scrapy\crawler.py里,crawler.py文件里只有三个类,如下图:

相关文章

- [Python 爬虫]煎蛋网 OOXX 妹子图爬虫(1)——解密图片地址

- Screaming Frog SEO Spider Mac激活版(尖叫青蛙网络爬虫软件)

- python爬虫的4个实例

- 写爬虫如何让Headers一键格式化

- Python爬虫:逆向分析某酷音乐请求参数

- Scrapy 爬虫完整案例—从小白到大神(银行网点信息为例)

- 一个Scrapy爬虫实例

- python scrapy 爬虫实例_scrapy爬虫完整实例

- python3+Scrapy爬虫实战(一)—— 初识Scrapy

- scrapy的爬虫案例

- Python: “股票数据Scrapy爬虫”实例

- Scrapy爬虫入门

- python爬虫scrapy框架_python主流爬虫框架

- Scrapy爬虫框架_nodejs爬虫框架对比

- Scrapy 爬虫框架[通俗易懂]

- Python分布式爬虫框架Scrapy 打造搜索引擎(四) - 爬取博客网站

- Python爬虫之scrapy框架学习

- Go语言网络爬虫中的基本数据结构

- python爬虫的基本抓取

- 运维学python之爬虫基础篇(三)urllib模块高级用法

- 借助爬虫技术爬取Redis命令(爬虫爬取redis命令)

- 零基础写python爬虫之爬虫框架Scrapy安装配置