2016年杭州第四次spark meetup见闻

Spark 2016 杭州 MeetUp 第四次

2023-09-14 09:03:12 时间

spark发展非常快,2.0都快要发布了。在不同的城市都会有一些交流聚会,杭州有很多互联网企业,创业的氛围也非常好。大家每隔一段时间的交流还是必须的。不过最好还是时间上密集点,最好重点在于大家讨论,互相交流。

这次是挖财网的时金魁同学主办的,感谢时金魁同学,演讲稿下载链接

期待2.0发布,最近E-MapReduce团队在做benchmark,找时间单独对比下1.6与2.0之间的性能差距。

有4场次的分享,分别为:

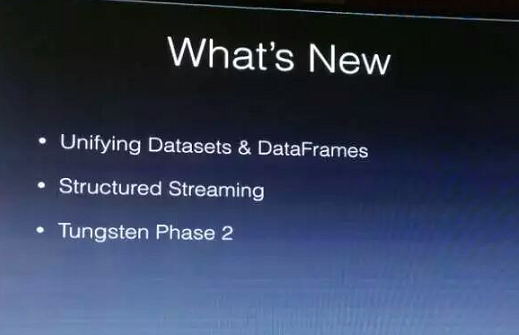

《Spark 2.0介绍》来自七牛的陈超大致介绍了spark2.0的一些新的功能,包括Dataset、Structured Streaming、Tungsten Phase2。记得最清楚就是 陈超说: 目前Structured Streaming还不成熟,吹了很多牛,大家得等到2.x版本吧,不管怎么搞还是基于batch,想跟flink一样估计到3.0,不过hadoop 3.0还没有发布,那spark也不知道啥时间了。

笔者路上堵车了,所以也只听到了一半。PS:陈超 别怪我写的不多,下面的图是借过来的。

现在网上分析2.0的文章比较多,笔者就不细讲了。

这个笔者是剧中人,还是比较熟悉的,经历过太多辛酸苦辣。念钧同学讲的比较好,从13年到16年虽然几度变化,但是还是在mllib上摸索。 此次讲了阿里mllib从13年到16年的一些事情,比如:机器学习算法平台的建设(可以拖的图形化界面,把算法包装好),在mllib踩过的一些坑(基本是数据量大以后的事情),MPI跟mllib的对比(mpi性能高,灵活性稳定性不够)。目前大数据方面,会有越来越多人从事大数据分析、数据挖掘上,这是一个热点。

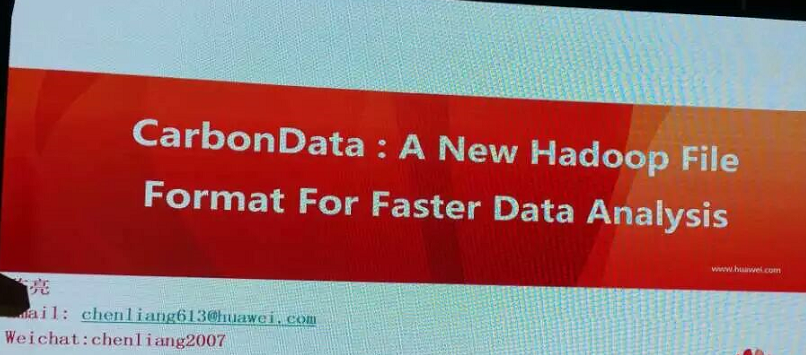

《Spark+CarbonData(New File Format For Faster Data Analysis》来自华为陈亮,spark作为分析引擎可以基于CarbonData获取更快的查询性能。CarbonData是一个新的存储格式,跟parquet、orcfile比较类似。大致就是在列式存储的基础上加上编码、倒排等index的技术。看了 陈亮的演示,在100w条数据下,CarbonData比parquet快数倍的。不过现场有很多的问题,比如:写的性能怎么样?对于中文支持怎么样?cpu等有没有额外的开销? 目前没有这方面的数据,最近进入了apache孵化器,期待后续有更加详细的数据。架构在于平衡,有利必有弊的。CarbonData 确实是一个很好的尝试,把传统DB的思想用来做大数据的数据存储格式也是很好的。 详细的信息见:CarbonData 《Spark Streaming简要图解》来自挖财网时金魁(现场照图片,比较可惜,补一张pdf里面封面,请时金魁见谅),介绍了挖财网用了spark+mesos+kafka+elasticsearch+kibana+Hbase,提到了Hbase作为数据存储服务扛不住sparkStreaming的压力,后开启了Hbase的反压,选择了mesos原因是在做隔离方面更好及Marathon对长服务支持更好,kibana对于展示metric比较好,最后图解了 Spark Streaming,看源码这样画一个图还是很方便理解的,比较赞成说代码写的比较乱,这快笔者也看过。

《Spark Streaming简要图解》来自挖财网时金魁(现场照图片,比较可惜,补一张pdf里面封面,请时金魁见谅),介绍了挖财网用了spark+mesos+kafka+elasticsearch+kibana+Hbase,提到了Hbase作为数据存储服务扛不住sparkStreaming的压力,后开启了Hbase的反压,选择了mesos原因是在做隔离方面更好及Marathon对长服务支持更好,kibana对于展示metric比较好,最后图解了 Spark Streaming,看源码这样画一个图还是很方便理解的,比较赞成说代码写的比较乱,这快笔者也看过。

Apache Spark Meetup China 第1期 最全资料下载 活动时间:2018年12月16日13:30-17:00 活动地点:杭州市余杭区文一西路998号未来科技城海创园4幢801C 主办单位:阿里云、袋鼠云、云栖社区 主题介绍: 主题一、Spark优化实践-13:30 - 14:30阿里云E-MapReduce-王道远介绍阿里云EMR中Spark计算引擎所包含的一系列额外优化工作,包括SmartShuffle、file skip index等。

HADOOP MapReduce 处理 Spark 抽取的 Hive 数据【解决方案一】 今天咱先说问题,经过几天测试题的练习,我们有从某题库中找到了新题型,并且成功把我们干趴下,昨天今天就干了一件事,站起来。 java mapeduce 清洗 hive 中的数据 ,清晰之后将driver代码 进行截图提交。

Storm与Spark、Hadoop三种框架对比 Storm与Spark、Hadoop这三种框架,各有各的优点,每个框架都有自己的最佳应用场景。所以,在不同的应用场景下,应该选择不同的框架。

大数据Spark企业级实战与Hadoop实战&PDF和PPT 今天给大家分享的是《大数据Spark企业级实战》与《Hadoop实战》《大数据处理系统·Hadoop源代码情景分析》《50个大厂大数据算法教程》等销量排行前10名的大数据技术书籍(文末领取PDF版)。这些书籍具有以下几个优点:易读、实践性强,对解决工作中遇到的业务问题具有一定启发性。

封神 封神 09年加入阿里巴巴,阿里云高级技术专家、架构师;专注在大数据、分布式数据库领域,10年分布式研发经验;参与研发万台大数据Hadoop离线计算平台;负责研发多款阿里云一级大数据及数据库产品,如云Cassandra

相关文章

- spark flatmap

- Spark SQL报错:org.apache.spark.sql.catalyst.errors.package$TreeNodeException 排查记录

- Spark集群基础概念 与 spark架构原理详解大数据

- Spark入门实战系列–9.Spark图计算GraphX介绍及实例详解大数据

- Map-Reduce和Spark详解大数据

- Spark-Sql源码解析之一 引言详解大数据

- 基于Kafka的实时计算引擎如何选择Flink or Spark详解大数据

- Spark MLlib线性回归代码实现及结果展示详解编程语言

- 探索大数据宝藏:使用Linux与Spark实现高效分析(linuxspark)

- 作为缓存Spark利用Redis缓冲数据的应用(spark需要redis)

- 使用Spark进行Redis数据读取(spark 读redis)

- Spark高效消费Redis中数据(spark消费redis)

- 使用Spark和Redis提升计算性能(spark和redis)

- Spark在Redis中的火花开启高性能数据处理(spark 写redis)

- 利用Spark解锁Redis发挥新实力(spark与redis)