《Progressive Growing of GANs for Improved Quality, Stability, and Variation》-论文阅读笔记(一)

《Progressive Growing of GANs for Improved Quality, Stability, and Variation》-论文阅读笔记

论文结构

1.Introduction

2.Progressive growing of GANs

3.Increasing variation using

minibatch standard deviation

4.Normalization in generator and

discriminator

4.1 Equalized learning rate

4.2 Pixelwise feature vector

normalization in generator

5.Multi-scale statistical similarity

for assessing GAN results

6.Experiments

6.1 Importance of individual contributions in

terms of statistical similarity

6.2 Convergence and training speed

6.3 High-resolution image generation using

CelebA-HQ dataset

6.4 LSUN results

6.5 CIFAR10 inception scores

7.Discussion

摘要

原文

We describe a new training methodology for generative adversarial networks. The key idea is to grow both the generator and discriminator progressively: starting from a low resolution, we add new layers that model increasingly fine details as training progresses. This both speeds the training up and greatly stabilizes it, allowing us to produce images of unprecedented quality, e.g., CelebA images at 1024^2. We also propose a simple way to increase the variation in generated images, and achieve a record inception score of 8.80 in unsupervised CIFAR10. Additionally, we describe several implementation details that are important for discouraging unhealthy competition between the generator and discriminator. Finally, we suggest a new metric for evaluating GAN results, both in terms of image quality and variation. As an additional contribution, we construct a higher-quality version of the CelebA dataset.

总结

1.使用渐进的方式来训练生成器和判别器:先从生成低分辨率图像开始,然后不断增加模型层数来提升生成图像的细节

2.这个方法能加速模型训练并大幅提升训练稳定性,生成前所未有的的高质量图像(1024*1024)

3.提出了一种简单的方法来增加生成图像的多样性

4.介绍了几种限制生成器和判别器之间不健康竞争的技巧

5.提出了一种评价GAN生成效果的新方法,包括对生成质量和多样性的衡量

6.构建了一个CELEBA数据集的高清版本

研究背景

Research background

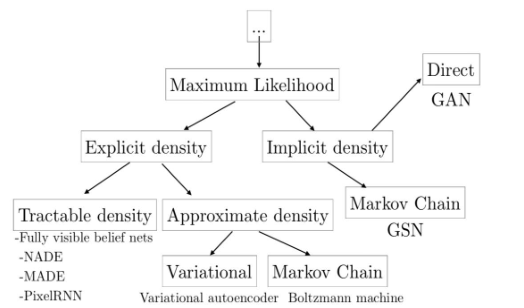

生成式模型的类别

•显性密度模型

易解显性模型:定义一个方便计算的密度分布,主要的模型是Fully visible belief nets,简称FVBN,也被称作Auto-Regressive Network

近似显性模型:可以定义任意的密度分布,使用近似方法来求解

隐性密度模型

GAN

• 神经自回归网络(PixelRNN/CNN)

通过链式法则把联合概率分布分解为条件概率分布的乘积使用神经网络来参数化每个P

PixelRNN逐像素生成,效率很低,PixelCNN效果不如PixelRNN

• VAE-GAN

编码器:使P(z|x)逼近分布P(z),比如标准正态分布,同时最小化生成器(解码器)和输入x的差距

解码器:最小化输出和输入x的差距,同时要骗过判别器

判别器:给真实样本高分,给重建样本和生成样本低分

图像生成的评价指标

• 可以评价生成样本的质量

• 可以评价生成样本的多样性,能发现过拟合、模式缺失、模式崩溃、直接记忆样本的问题

• 有界性,即输出的数值具有明确的上下界

• 给出的结果应当与人类感知一致

• 计算评价指标不应需要过多的样本

• 计算复杂度尽量低

相关文章

- 如何在Ubuntu 13.04, 13.10上安装Sublime Text 3

- 禁用Ubuntu 13.10的Amazon及远程内容获取

- 通过PPA在Ubuntu中安装qBittorrent 3.1.0

- ttyrec & ttyplay - Linux记录播放终端会话

- 每日Ubuntu小技巧-改变登陆窗口背景

- 安装Ubuntu13.10后必做的10件事

- 如何使用LibreOffice把DOCX,DOC,RTF,ODT转换成PDF

- 每日Ubuntu小技巧 - 改变Ubuntu Unity启动器尺寸

- 如何在Ubuntu 13.10中给菜单添加图标

- Ubuntu每日小技巧:通过PPA升级你的LibreOffice

- 5个有趣且能提高效率的超酷Unix操作

- ncdu-基于Ncurses的磁盘实用工具

- 在2018年最值得去学习的编程语言

- 直男 or Gay?看看你的DNA标记!

- 可以快速保存、访问和粘贴文本片段的Unity漂亮工具

- 上传你的大脑:会有那么一天吗?

- 如何在Ubuntu13.10中安装最新版的NVIDIA 331.20驱动

- 为啥套娃?聊聊 Babel、Jscodeshift 和阿里妈妈的 Gogocode

- 未来:手机将植入大脑......

- Acme框架真香!用过一次后 伦敦博士撰文大赞DeepMind强化学习框架