论文阅读:AM-GCN Adaptive Multi-channel Graph Convolutional Networks

ABSTRACT

图卷积网络(GCNs)在处理各种图和网络数据的分析任务中得到了广泛的应用,但最近的一些研究提出了GCNs能否在信息丰富的复杂图中最优地集成节点特征和拓扑结构的问题。在本文中,我们首先进行了实验研究。令人惊讶的是,我们的实验结果清楚地表明,最新的GCNs融合节点特征和拓扑结构的能力远远不是最优的,甚至不是令人满意的。由于GCNs可能不能自适应地学习拓扑结构与节点特征之间的一些深层关联信息,这一弱点可能会严重阻碍GCNs在某些分类任务中的能力。我们能不能弥补这一弱点,设计一种新型的GCNs,既能保留现有GCNs的优点,又能大大增强其融合拓扑结构和节点特征的能力?针对这一挑战,我们撞击提出了一种用于半监督分类的自适应多通道图卷积网络(AM-GCN)。其核心思想是同时从节点特征、拓扑结构和它们的组合中提取特定的和共同的嵌入信息,并使用注意机制来学习嵌入信息的自适应重要性权重。我们在基准数据集上的大量实验表明,AM-GCN从节点特征和拓扑结构中提取了相关性最强的信息,并在很大程度上提高了分类精度。

1 引言

GCN的巨大成功部分归功于GCN提供了一种基于拓扑结构和节点特征的融合策略来学习节点嵌入,融合过程由端到端学习框架监督。

然而,最近的一些研究揭示了最先进的GCNs在融合结点特征和拓扑结构方面的某些缺陷。例如Li等[15]表明,GCNs实际上对节点特征进行了拉普拉斯平滑,使嵌入到整个网络中的节点逐渐收敛。Nt和Maehara[20]和Wu等[30]证明了特征信息在网络拓扑结构上传播时,拓扑结构对节点特征起到低通滤波的作用。Gao等人[8]在GCN中设计了一个条件随机场(CRF)层来显式地保持节点之间的连通性。

GCNs真正从拓扑结构和节点特征中学习和融合哪些信息?这是一个基本问题,因为GCNs经常被用作端到端学习框架。对这个问题的详尽回答可以帮助我们以原则性的方式理解GCNs的能力和局限性。这立即激发了我们学习的动力。

作为本研究的第一个贡献,我们提出了实验评估GCNs融合拓扑结构和节点特征的能力。令人惊讶的是,我们的实验清楚地表明,GCNs对网络拓扑结构和节点特征的融合能力明显离最佳甚至令人满意还差得远。即使在一些简单的情况下,节点之间的关联特性/拓扑节点标签是非常明确的,GCN仍不能充分融合节点特性和拓扑结构提取最相关的信息(见第二节)。疲软可能严重阻碍之下的能力在某些分类任务,因为GCNs可能不能自适应地学习拓扑结构和节点特征之间的一些相关信息。

既然明确了现有最先进GCN的缺陷,一个自然的问题是:我们能否弥补这一缺陷,设计一种新型的GCNs,在保留现有GCNs优势的同时,大幅增强拓扑结构和节点特征的融合能力?

一个良好的融合能力的GCNs基本上需要提取和融合最相关的信息用于分类任务,但现实中最大的障碍是网络数据和分类任务之间的相关性通常是非常复杂和不可知的。分类可以与拓扑、节点特征或它们的组合相关联。本文提出了一种自适应多通道图卷积半监督分类网络(AM-GCN)。其核心思想是我们同时根据节点的特征、拓扑结构和它们的组合来学习节点嵌入。其基本原理是特征之间的相似性与拓扑结构推断的相似性是互补的,可以自适应地融合以获得用于分类任务更深层的相关信息。

在技术上,为了充分利用特征空间中的信息,我们把从节点特征生成的k-最近邻图中作为特征结构图。利用特征图和拓扑图,在拓扑空间和特征空间上传播节点特征,通过两个特定的卷积模块在这两个空间中提取出两个特定的嵌入。考虑到两个空间之间的共同特征,我们设计了一个具有参数共享策略的公共卷积模块来提取它们共享的公共嵌入。我们进一步利用注意机制自动学习不同嵌入的重要权重,从而自适应融合它们。这样,节点标签可以监督学习过程,自适应调整权重,提取相关度最高的信息。此外,我们设计了一致性和视差约束,以确保学习到的嵌入的一致性和视差。

AM-GCN: THE PROPOSED MODEL

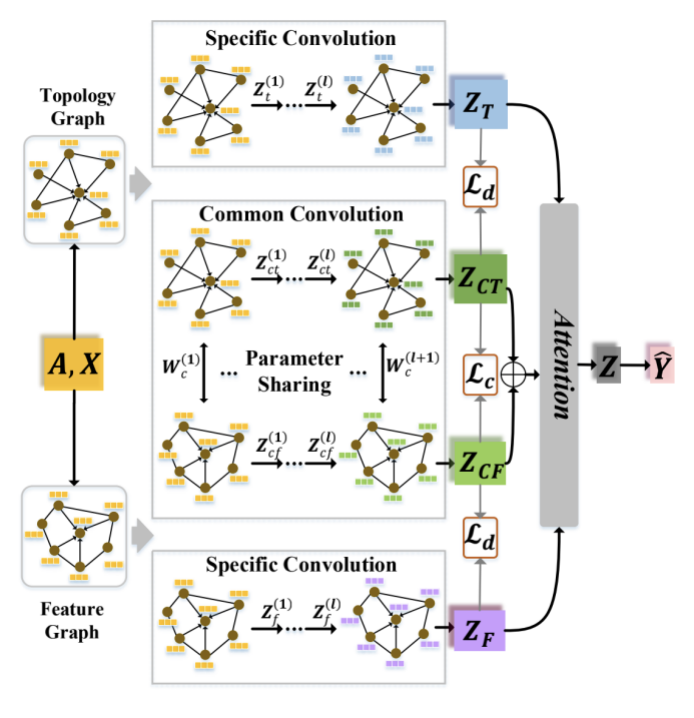

AM-GCN的模型结构如上图,由三部分组成,分别是拓扑空间(原先的网络拓扑结构)、特征空间(由节点特征构建的图)、拓扑空间和特征空间参数共享的卷积模块。在属性图上学到表征ZF,在拓扑图上学到表征ZT,在参数共享的common convolution module学到表征ZCF和ZCT,约束项Lc使ZCF与ZCT更加相似,约束项Ld使ZF与ZCF以及ZT和ZCT更加不相似。最后使用attention机制,来结合各个embedding。

Specific Convolution Module

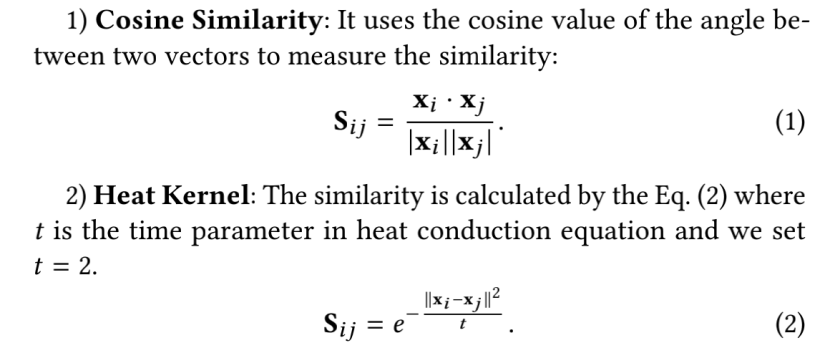

属性图采用的是节点属性的KNN图。KNN图的距离可以有多种度量方式,文中举了两个例子

之后选择每个节点的top k neighbor来构建KNN graph。

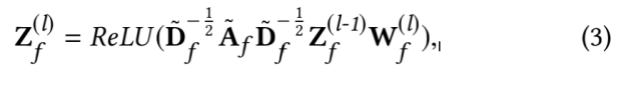

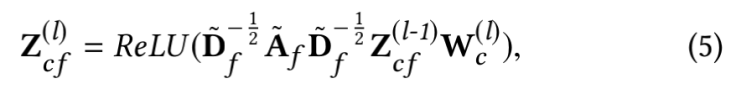

之后的GCN就是一个标准的GCN操作,

可以得到ZF和ZT。

Common Convolution Module

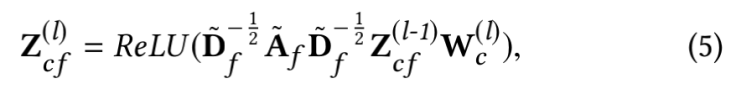

为了捕捉属性空间和拓扑空间之间的联系,文中使用参数共享的GCN来得到两个空间共享的embedding。其实就是使用共享的参数矩阵W再属性图和拓扑图上分别做GCN

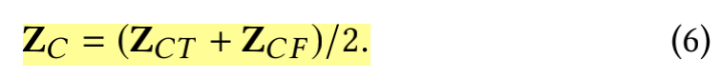

得到ZCT和ZCF后,两个空间的common embedding ZC为

Attention Mechanism

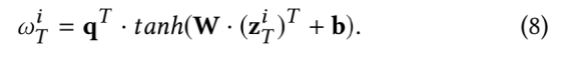

使用attention机制来学习ZT、ZF、ZC的重要性。以node i的ZT为例,attention weight的计算方式如下:

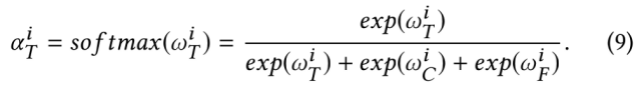

最后,对三个attention weight用softmax做归一化。

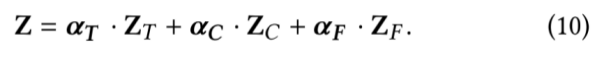

最终的embedding Z为

Objective Function

Consistency Constraint

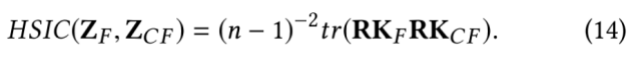

ZCT与ZCF虽然共享了参数矩阵W,文中加入了约束项来进一步确保它们的一致性。

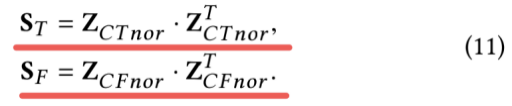

对embedding matrix做L2-norm得到ZCTnor和ZCFnor,从而可以得到相似度矩阵ST和SF

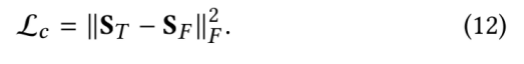

通过ST和SF的相似来约束两者embedding matrix的一致性。具体的约束项为

Disparity Constraint

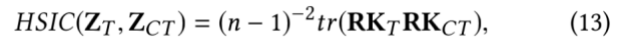

为了确保ZT和ZCT能够捕捉不同的信息,加入了差异约束。(符号的具体含义可见原论文)

同理,对于ZF和ZCF,有约束项

最终的disparity constraint为

Optimization Objective

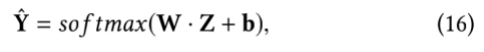

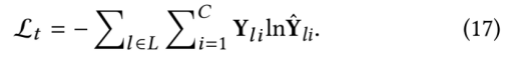

最终对embedding Z做softmax得到预测值,节点分类任务的loss用cross-entropy

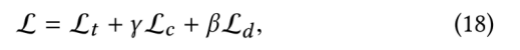

最终的目标函数为(加上约束项)

γ和β为超参数。

6 Conclusion

在本文中,我们重新思考了GCN中网络拓扑和节点特征的融合机制,并惊奇地发现它并不是最优的。基于这一基本问题,研究了如何从拓扑和节点特征中自适应地学习相关性最强的信息,并对其进行充分融合进行分类,提出了一种能够在融合拓扑和节点特征信息时学习适当重要性权重的多通道模型AM-GCN。大量的实验表明,该模型在真实数据集上的性能优于最先进的模型

相关链接

KDD20 | AM-GCN:自适应多通道图卷积网络 - 云+社区 - 腾讯云 (tencent.com)

[AM-GCN: Adaptive Multi-channel Graph Convolutional Networks 阅读笔记 | NYSDY](http://nysdy.com/post/Adaptive Multi-channel Graph Convolutional Networks/)

AM-GCN: Adaptive Multi-channel Graph Convolutional Networks KDD2020_哔哩哔哩_bilibili

AM-GCN: Adaptive Multi-channel Graph Convolutional Networks(论文解析)_Struggle~的博客-CSDN博客

AM-GCN 文章简述_欧神仙crossover的博客-CSDN博客

论文笔记之AM-GCN: Adaptive Multi-channel Graph Convolutional Networks - 简书 (jianshu.com)

M-GCN: Adaptive Multi-channel Graph Convolutional Networks - 简书 (jianshu.com)](https://www.jianshu.com/p/71b181a57cf1)

相关文章

- 发现 Linux SpaceFM 文件管理器的威力

- 夯实数据智能底座 共筑数字经济发展“新基石”

- 五分钟教你使用console.log发布公司的招聘信息

- 微软发布 Windows 11 Beta 预览版 Build 22621.1250 和 22623.1250 (KB5023008)

- Windows 11 学院:在 Windows 11 Build 25290 上如何为文件管理器启用标签页拖拽支持

- 微软Windows 11 Dev 预览版 Build 25290 发布:带来新的开始菜单提醒角标

- 微软正用全屏通知提醒 Windows 10 用户免费升级 Windows 11,要点击 5 次才能退出

- Linux Mint 21.2 将于 6 月发布:改进登录屏幕,优化 Pix 图像管理程序等等

- 字节面试也会问SPI机制?

- 微软正式停售 Windows 10 产品密钥 / 许可证:继续提供 ISO 镜像下载,推荐用户升级 Windows 11

- 用复古电脑程序 Toy CPU 学习低级编程

- Windows 11 新功能泄露:现代音量合成器、实验工具和新的文件管理器

- 微软 Windows 11 文件资源管理器全新设计曝光:UI 迎来大修,整合 Microsoft 365

- 对比Pandas,学习PySpark大数据处理

- 微软宣布为Windows 11 21H2设备开启自动更新到22H2版本

- 互联网都在说降本增效,小红书技术团队是怎么做的?

- 微软将继续提供 Windows 10 ISO 镜像下载,即将停售产品密钥 / 许可证

- 微软宣布为Windows 11 21H2 设备开启自动更新到 22H2 版本

- 面试突击:Properties和Yml有什么区别?

- 微软 Windows 11 Beta 预览版 22621.1245 和 22623.1245 (KB5022358) 发布