四款有针对大数据的数据处理系统

2023-03-14 10:15:42 时间

为了从大数据中挖掘出有价值的信息,需要有针对大数据的数据处理系统。目前,一些大型的互联网企业,例如谷歌、Facebook 等企业都研发了针对大数据的数据处理系统。

1)批量数据处理系统:

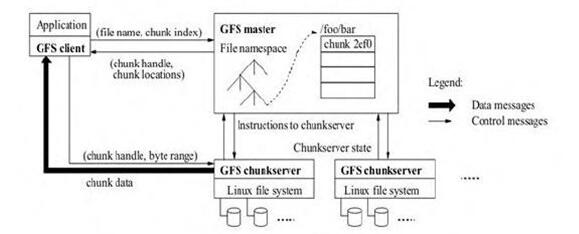

这种系统是对互联网中产生的海量的静态的数据进行处理。例如对客户在网站中的点击量和网页的浏览量等数据进行处理,从而或者客户对哪些商品比较偏爱。谷歌公司研发的 GFS(Google File System,即大规模分散文件系统)和 Map Reduce(大规模分散 Frame Work)系统就是典型的批量数据处理系统。

2)流式数据处理系统:

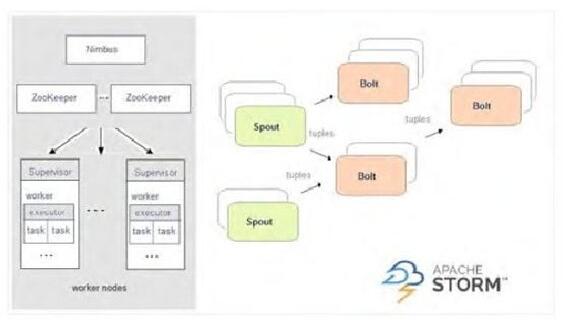

这种系统是对互联网中大量的在线数据进行实时处理。这些在线数据具有复杂的格式,并且数据是连续不断地来源于众多的渠道,该种系统需要对这些实时的数据进行实时的、快速的处理。例如生物体中传感器的数据、商场人流量数据、定位系统的数据都需要高效地实时处理。Storm系统是典型的流式数据处理系统,Twitter、Spotify、雅虎等公司都使用该系统。

3)交互式数据处理:

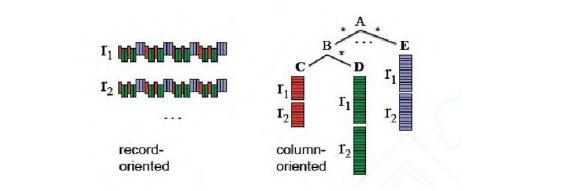

这种数据处理系统可以用人机交互的方式实现数据的处理。例如互联网搜索引擎。Dremel 系统是典型的交互式数据处理系统。

4)图数据处理系统:

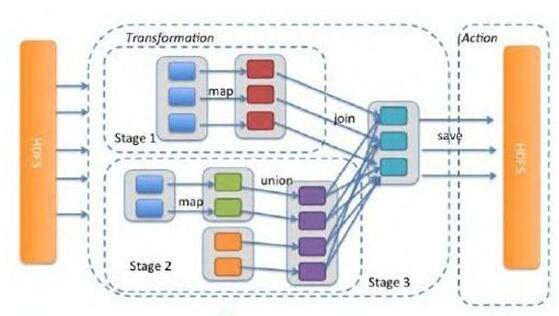

该种系统用于处理大数据中的图数据。例如社交网络中人与人之间的社会关系图数据。Spark系统是典型的图数据处理系统。

随着社交网络的发展、传感器的广泛应用、物联网的不断扩展,大数据已经深入我们生活的方方面面,针对大数据的处理也越来越深入,如何更高效的挖掘大数据中蕴藏的价值需要不断地研究和改进。

相关文章

- 深入理解Spark:核心思想与源码分析. 3.1 SparkContext概述

- Linux集群和自动化维2.7 小结

- Ceph分布式存储实战 1.1 Ceph概述

- 深入理解Spark:核心思想与源码分析. 3.2 创建执行环境SparkEnv

- 深入理解Spark:核心思想与源码分析. 3.3 创建metadataCleaner

- Linux集群和自动化维3.5 Python(x,y)介绍

- Linux集群和自动化维3.6 轻量级自动化运维工具Fabric介绍

- Linux集群和自动化维3.6.1 Fabric的安装

- 深入理解Spark:核心思想与源码分析. 3.4 SparkUI详解

- Linux集群和自动化维3.6.2 命令行入口fab命令详解

- Linux集群和自动化维3.6.3 Fabric的核心API

- 深入理解Spark:核心思想与源码分析. 3.5 Hadoop相关配置及Executor环境变量

- Linux集群和自动化维3.7.1 开发环境中的Fabric应用实例

- Linux集群和自动化维3.7.2 线上环境中的Fabric应用实例

- 深入理解Spark:核心思想与源码分析. 3.6 创建任务调度器TaskScheduler

- Linux集群和自动化维3.8 小结

- 深入理解Spark:核心思想与源码分析. 3.7 创建和启动DAGScheduler

- 深入理解Spark:核心思想与源码分析. 3.8 TaskScheduler的启动

- 深入理解Spark:核心思想与源码分析. 3.10 创建和启动ExecutorAllocationManager

- 深入理解Spark:核心思想与源码分析. 3.11 ContextCleaner的创建与启动