GPT-1论文阅读

简介

题目:Improving Language Understanding by Generative Pre-Training

翻译:改善语言理解通过生成式预训练

点击下载pdf

概要:

自然语言理解包含很多问题:文本蕴含、问答、语义相似度评估、文献分类。大量的无标签文本语料库是丰富的,打标签语料库是匮乏的,分别去训练模型很难有良好效果。该论文证明了:先使用无标签语料库进行生成式预训练,再针对不同任务做微调,这样效果很好。

介绍

从无标记文本中学习文本表征是有意义的,就像之前的词嵌入预训练一样。现有的预训练方法存在的问题是:模型需要根据任务调整、复杂的学习方法、需辅助目标函数。总结:麻烦。

本文探索一种半监督方法用于语言理解任务:无监督预训练+有监督微调。

目标是学习一种普遍的表征,只需要很少的改变就可用于宽泛范围的任务。

模型是Transformer,对比RNN,Transformer优点是可建立文本的长依赖关系,对不同任务更加鲁棒。

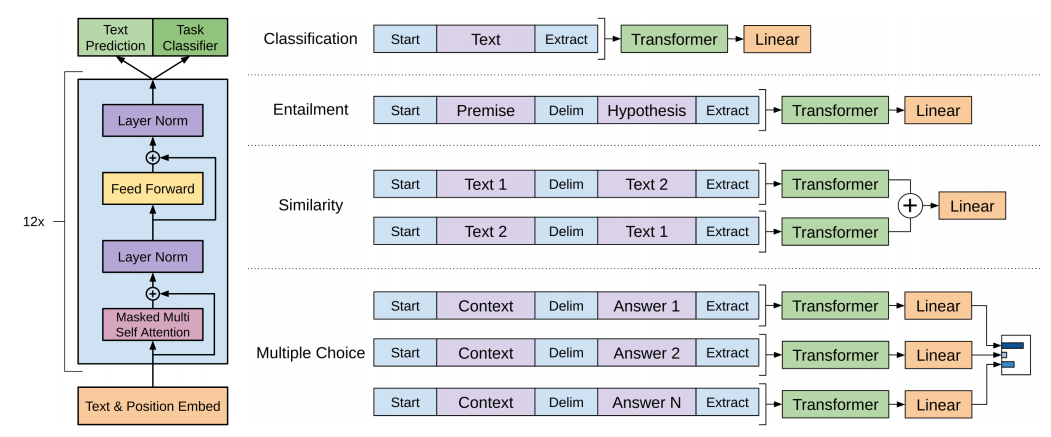

验证实验使用四种任务:自然语言推断、问答、语义相似、文本分类

无监督预训练

训练数据是无标签的语料token:

训练目标函数是最大化下面的式子

这里的目标可以理解为:根据前k个语料token,预测下一个token。

例如,给定U=“今天天气真好”,模型需要有如下预测能力:

给定句子“今”,下一个预测“天”

给定句子“今天”,下一个预测“天”

给定句子“今天天”,下一个预测“气”

给定句子“今天天气”,下一个预测“真“

给定句子“今天天气真”,下一个预测“好”

目标函数中的

θ

heta

θ是模型的参数,所以这个式子就是找到最合适的

θ

heta

θ,让

L

1

(

U

)

L_{1}(U)

L1(U)最大。训练方法是随机梯度下降。

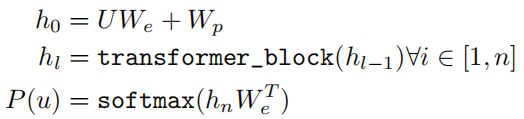

模型选择的是多层Transformer解码器,

模型整体计算流程如下:

W

e

W_{e}

We是token embedding,把词映射为向量的矩阵。

W

p

W_{p}

Wp是position embedding,把位置映射为向量的矩阵。

有监督微调

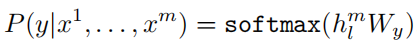

使用有标签的数据集C,其中每个实例有序列输入tokens:

x

1

,

.

.

.

,

x

m

x^{1},...,x^{m}

x1,...,xm,对应的标签y。

h

l

m

h_{l}^{m}

hlm是transformer_block最后一层的输出,额外增加一个新的线性层

W

y

W_{y}

Wy,然后使用softmax分类得到最终结果。

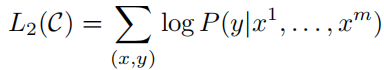

微调阶段的目标是最大化:

实际中发现使用混合类型的目标函数效果更好:(1)让模型进一步学习无监督预测的能力(2)帮助收敛

token设计如下图所示:

相关文章

- 值得思考,机器学习模型做出的决策是你想要的吗?

- 一套完整的基于随机森林的机器学习流程(特征选择、交叉验证、模型评估))

- 论文导读:Masked Autoencoders Are Scalable Vision Learners

- 【2021GTC】帮助四足机器人学习具有挑战性的任务:从模拟到现实

- 论文推荐:使用三维卷积进行自监督的3D点云预测

- 聊聊一行读研时最成功的投资

- 华人博士用强化学习回收了SpaceX火箭 | 开源

- dispatchEvent 学习笔记

- 2021全球高被引学者榜单出炉:中科院蝉联第二,南京工业大学超过武大北航

- AlphaFold和RoseTTAFold双剑合璧,成功预测蛋白质复合体结构,北大校友领衔登上Science

- 腾讯再次注资元宇宙,联合领投国际隔空触觉技术公司,D轮融资超5.2亿元

- 消息推送平台的设计

- 【技术种草】双十一活动的尾巴,来盘一下消息推送服务套餐有多优惠!

- 学习fetch,从这里开始!

- 中通大数据平台在大促中的进化

- 几个高效做事的法则,让你的一天有 25 小时

- 低代码开发平台

- 【腾讯云智能客服智囊团活动·第一期】——“调戏”智能客服拿好礼~

- 数商云原材料行业供应链平台数字化转型解决方案

- 第一章(1.3)机器学习概念图谱