谷歌AI认错人,同事工程师竟成「连环杀人魔」

莫名奇怪!

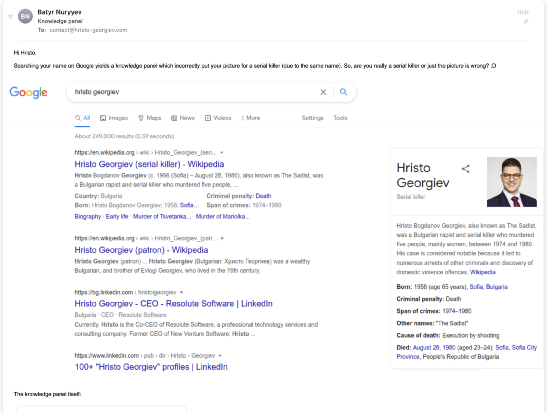

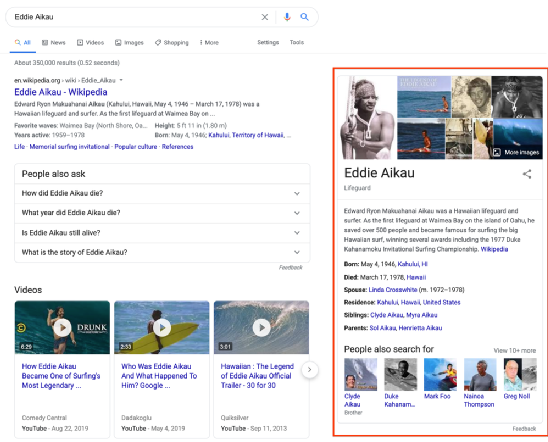

我朋友跟我说,在谷歌搜索我的名字会产生一张照片,而链接到维基百科上,居然是一篇与我同名的连环杀手的文章!

刚开始我还不信,但在好奇心的驱使下,我打开谷歌浏览器并输入我的名字。

我的照片下果然被安插在了一个杀手的描述之中!

描述里写道,「Hristo Bogdanov Georgiev, 1956 年- 1980 年 8 月 28 日,是一名保加利亚强奸犯和连环杀手,在 1974 年至 1980 年期间谋杀了五人,主要是女性。他的案件被认为是值得注意的,因为它导致许多其他罪犯被捕并发现家庭暴力罪行。他于1980 年 8 月 28 日被行刑队处决。」

我一良好公民,明明有着正当职业——软件工程师,啥子时候成了臭名昭著的连环杀人犯了??

我要上诉!

工程师秒变「连环杀手」,连维基百科都作证的那种

事情的主角是一名来自瑞士的工程师,名为Hristo Georgiev。

没错,与上世纪保加利亚一名凶手同名。

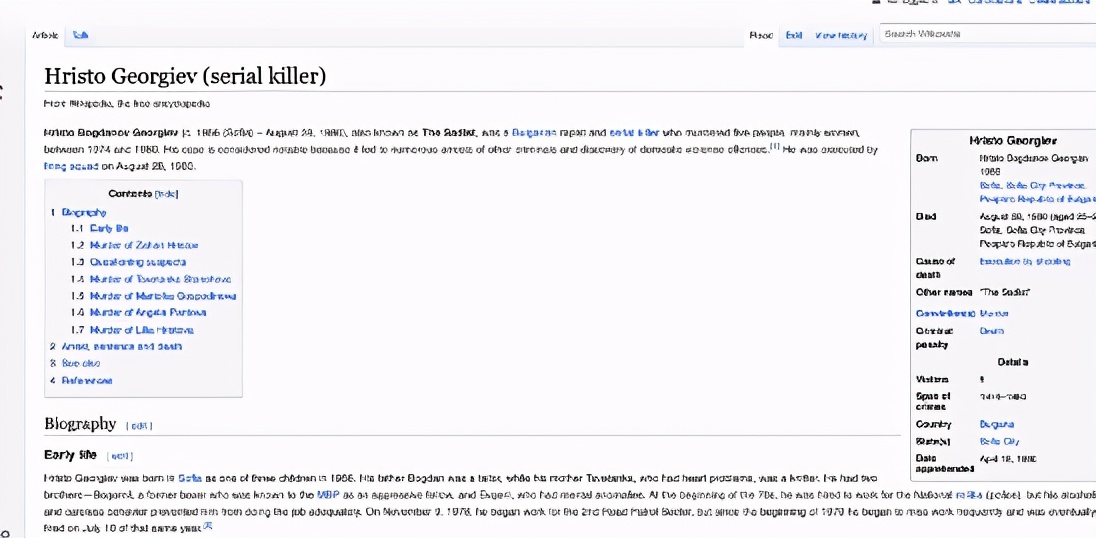

「我的第一反应是有人对我进行精心策划的恶作剧,但在打开维基百科文章后,发现那里根本没有我的照片。」Georgiev在一篇博客文章中说。

打开的wiki图片

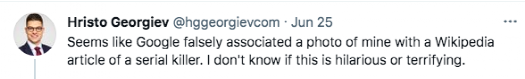

对此他还表示,「这让我哭笑不得。」

知识图谱来源信息不匹配,当事人:已「上诉」

很显然,这是由谷歌的知识图谱错配引起的,知识图谱会在搜索结果旁边生成信息框,谷歌把将他的照片与同名杀手的维基百科条目匹配上了。

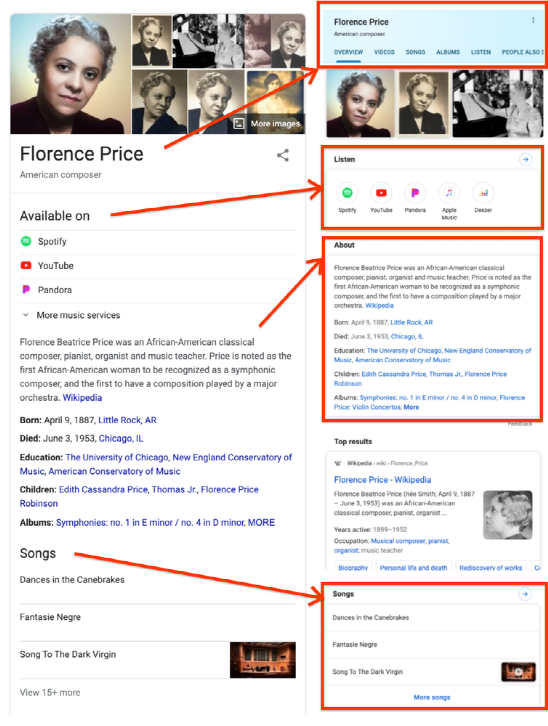

谷歌搜索会显示一些特殊的方框,其中有关于人、地方和事物的信息,这是知识面板。

进行桌面搜索的人可以轻松识别知识面板,并显示在搜索结果的右侧:

其中的信息来自我们的「知识图谱」,它就像一个巨大的虚拟事实百科全书。它是一个系统,可以从网络上共享的材料以及开源和许可数据库中了解有关的事实和信息。

但知识图谱中的错误时而发生。

这次工程师成连环杀手就是由于两个不同来源的信息不匹配产生的。

该公司已经推出了一个系统,供组织和人员与谷歌核实他们的身份,以便他们能够更容易地向谷歌提供直接反馈。

不过在本次Georgiev 的案例中,他在向谷歌报告这个错误后,该公司从凶手的信息框中删除了他的照片。

白宫、黑人都中招,网友:可长点心吧!

然而,被知识图谱乱扣帽子的远不止Georgiev一人。

该算法先前将演员保罗·坎贝尔 (Paul Campbell) 注册为已故纳粹。

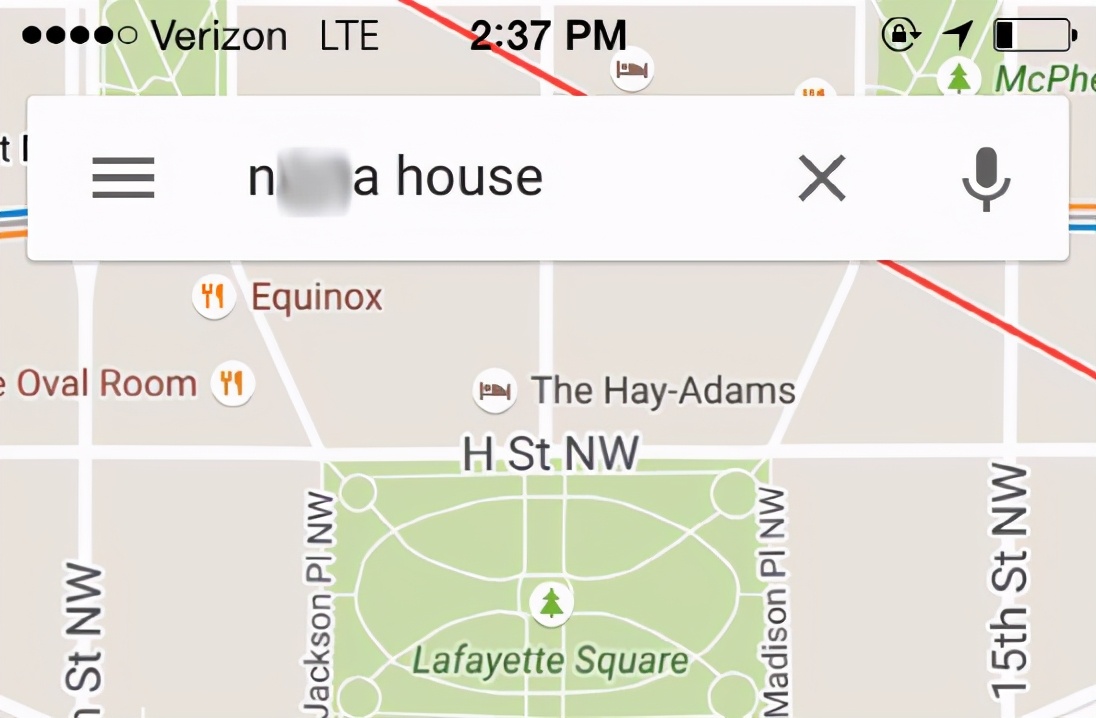

还有此前,在谷歌地图上输入种族主义短语,白宫就会出现;

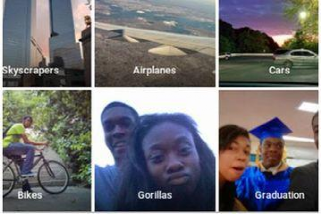

谷歌的人工智能照片标记系统甚至将一些黑人归类为大猩猩。

还有网友抱怨表示:

「我已经在营业时间上被误导了两次,一次是我当地的银行,一次是一家便利店,每次开车过去,都发现那里已经关门了。在这两种情况下,正确的营业时间都张贴在该企业的网站上。我还见过关于医疗状况的糟糕结果,列出错误的症状或将容易治疗的疾病描述为 "无法治愈"。」

「在我们的知识图中组织数十亿个实体,需要我们使用自动化系统,这些系统通常运行良好,但并不完美,」谷歌发言人说,「我们为这种混淆造成的任何问题感到遗憾。」

谷歌有一个正式的程序来标记和删除其知识面板中不准确的信息,但它在很大程度上依赖于用户在出现错误时进行捕捉。这让用户有责任注意到,谷歌是否在其顶级搜索结果中显示了关于他们的错误信息,然后将错误报告给搜索平台。

不过,过去的人抱怨说,从这些面板中删除虚假信息是一个繁琐的过程,其他人则表示,这可能需要数月甚至数年的时间。

谷歌发言人表示,该公司定期审查对其知识图结果的反馈,但没有评论该公司收到更改请求的频率。

谷歌的知识图谱可以通过连接来自网络周围的关于某个特定的人、地点或事物的信息片段来工作,特别是对于名人、地点和事物。

这比仅仅基于关键字来显示结果更先进和更具体

但是,还是长点心吧!

相关文章

- 【技术种草】cdn+轻量服务器+hugo=让博客“云原生”一下

- CLB运维&运营最佳实践 ---访问日志大洞察

- vnc方式登陆服务器

- 轻松学排序算法:眼睛直观感受几种常用排序算法

- 十二个经典的大数据项目

- 为什么使用 CDN 内容分发网络?

- 大数据——大数据默认端口号列表

- Weld 1.1.5.Final,JSR-299 的框架

- JavaFX 2012:彻底开源

- 提升as3程序性能的十大要点

- 通过凸面几何学进行独立于边际的在线多类学习

- 利用行动影响的规律性和部分已知的模型进行离线强化学习

- ModelLight:基于模型的交通信号控制的元强化学习

- 浅谈Visual Source Safe项目分支

- 基于先验知识的递归卡尔曼滤波的代理人联合状态和输入估计

- 结合网络结构和非线性恢复来提高声誉评估的性能

- 最佳实践丨云开发CloudBase多环境管理实践

- TimeVAE:用于生成多变量时间序列的变异自动编码器

- 具有线性阈值激活的神经网络:结构和算法

- 内网渗透之横向移动 -- 从域外向域内进行密码喷洒攻击